Transformers ที่ได้รับการฝึกฝนไว้ล่วงหน้าสำหรับข้อมูลอนุกรมเวลาหัวใจ: ลิงก์ไปยังกระดาษ

ใน repo นี้มีไฟล์โมเดลที่ผ่านการฝึกอบรมทั้งสำหรับรุ่นที่ผ่านการฝึกอบรมมาก่อน ECGPT และ PPGPT และรุ่นที่ปรับแต่งสำหรับ arrythmias และการตรวจจับจังหวะ นอกจากนี้ยังมี GUIs ที่ออกแบบมาสำหรับรุ่นการตีความและการใช้งานแบบจำลองที่ปรับแต่งได้

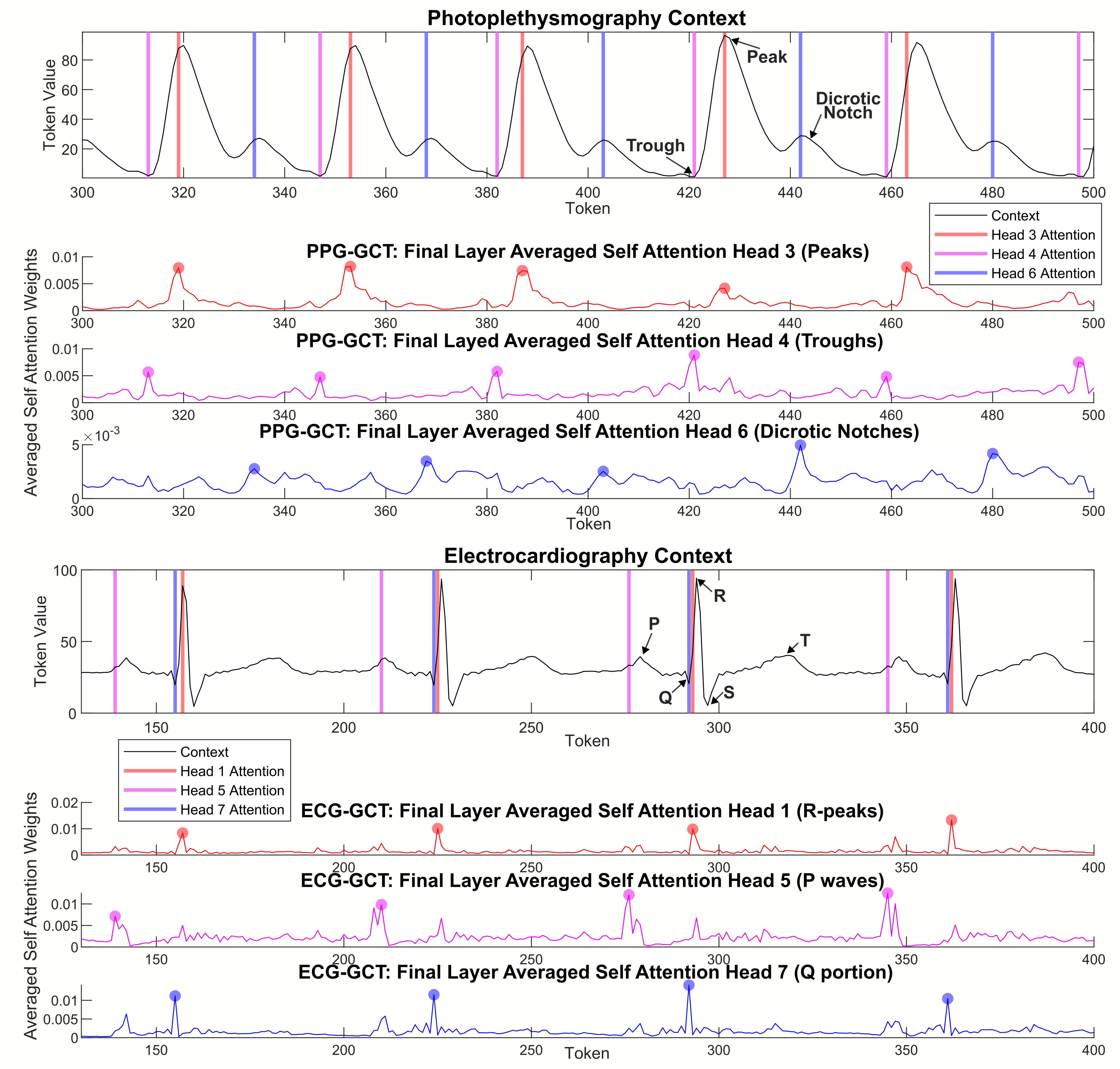

ในงานนี้เราใช้เฟรมเวิร์ก Transformer (GPT) ที่ผ่านการฝึกอบรมมาแล้วกับข้อมูลอนุกรมเวลาหัวใจเป็นระยะเพื่อสร้างโมเดลการเต้นของหัวใจที่ได้รับการฝึกฝนมาก่อนสองแบบคือ PPG-PT และ ECG-PT แบบจำลองมีความสามารถในการปรับแต่งสำหรับงานที่เกี่ยวข้องกับการเต้นของหัวใจหลายอย่างเช่นการคัดกรองสำหรับ arrythmias Enphasis ขนาดใหญ่ของงานนี้แสดงให้เห็นว่าโมเดลที่ผ่านการฝึกอบรมมาก่อนสามารถตีความได้อย่างสมบูรณ์และความสามารถในการตีความนี้นำไปสู่งานปรับแต่ง หม้อแปลงที่ผ่านการฝึกอบรมมาก่อนสามารถตีความได้ในรูปแบบต่อไปนี้ -

แผนที่ความสนใจโดยรวม แสดงให้เห็นว่าแบบจำลองมุ่งเน้นไปที่จุดที่คล้ายกันในรอบการเต้นของหัวใจก่อนหน้าเพื่อทำการคาดการณ์และค่อยๆขยายความสนใจในชั้นลึก:

โทเค็นที่มีค่าเท่ากัน (อนุกรมเวลาเทียบเท่ากับ homonym ) ที่เกิดขึ้นในจุดที่แตกต่างกันในวงจร ECG และ PPG แยกกลุ่มแยกต่างหากในพื้นที่มิติสูงขึ้นอยู่กับตำแหน่งของพวกเขาในวัฏจักรการเต้นของหัวใจ

หัวความสนใจของแต่ละบุคคลตอบสนองต่อคุณสมบัติที่เกี่ยวข้องทางสรีรวิทยาเฉพาะ เช่น dicrotic notch ใน PPG และ P-wave ใน ECG

งานนี้ได้รับแรงบันดาลใจจากบทช่วยสอนที่สร้างขึ้นโดย Andrej Karpathy

Heart_pt_generate.py เป็นสคริปต์ Python ซึ่งโหลดในตัวอย่างบริบทของ ECG หรือ PPG และใช้โมเดลที่เหมาะสมเพื่อสร้างขั้นตอนเวลาในอนาคต

ไฟล์โมเดล pytorch ที่ผ่านการฝึกอบรมมาก่อนอยู่ในโฟลเดอร์ ZIP ( ECGPT_560K_ITERS และ PPGPT_500K_ITERS )

ตัวอย่างคำจำกัดความของโมเดลปรับแต่งการปรับแต่งมีให้ใน "heart_pt_finetune.py" พร้อมกับวิธีการแช่แข็งเลเยอร์ที่แตกต่างกัน