repo นี้คือ

(1) ห้องสมุด Pytorch ที่ให้อัลกอริทึมการกลั่นความรู้แบบคลาสสิกบนเกณฑ์มาตรฐาน CV หลัก

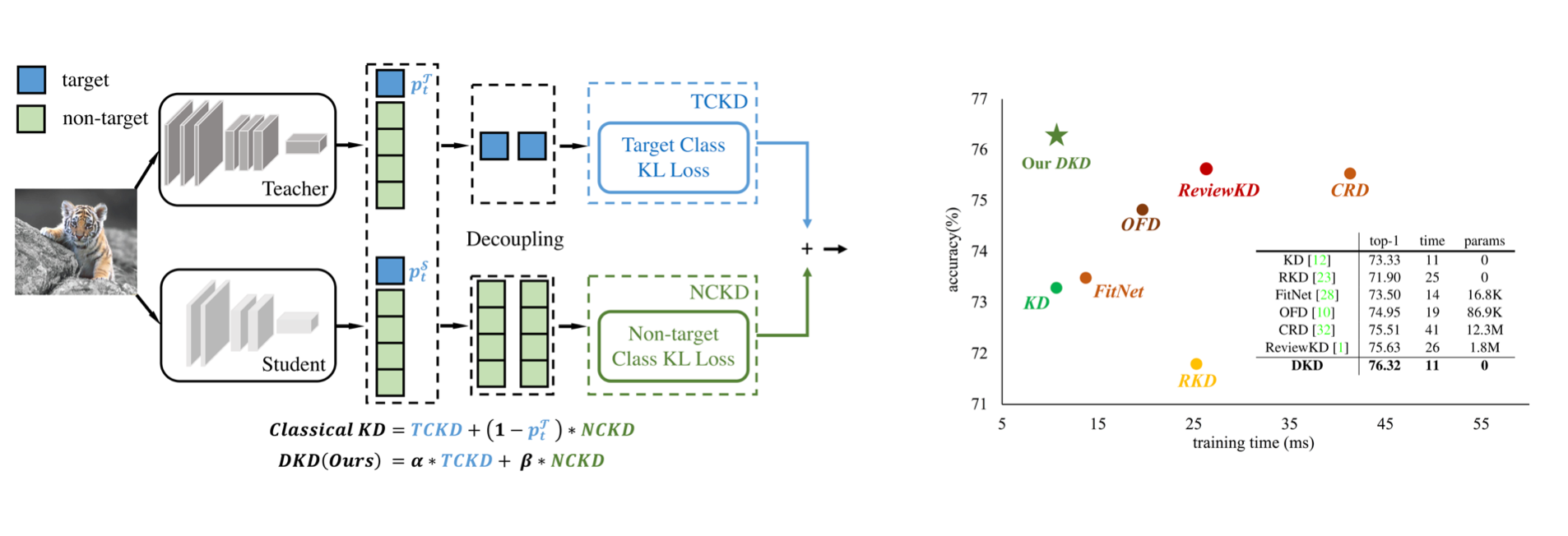

(2) การดำเนินการอย่างเป็นทางการของกระดาษ CVPR-20122: แยกความรู้การกลั่น

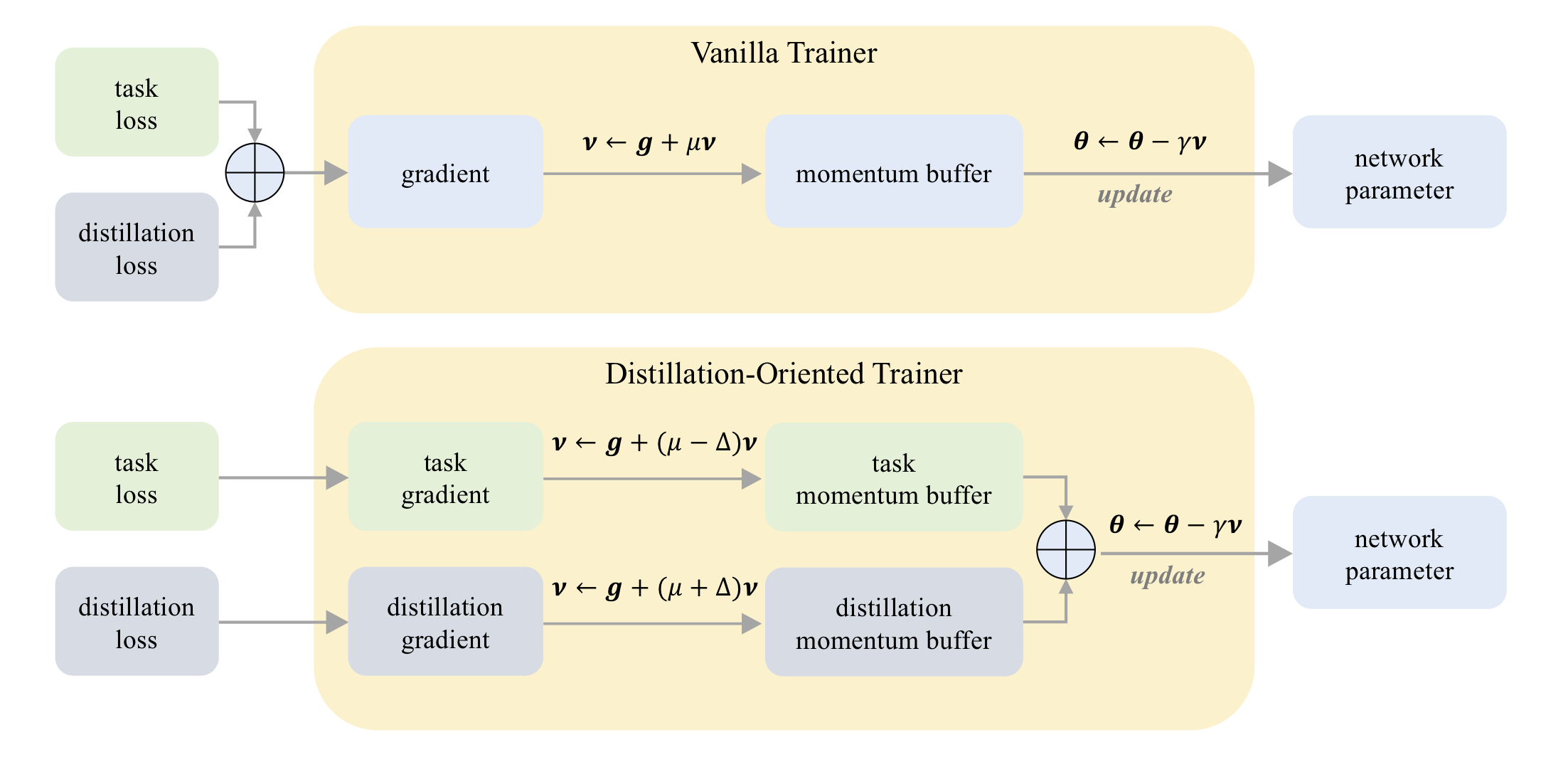

(3) การดำเนินการอย่างเป็นทางการของกระดาษ ICCV-20123: DOT: ผู้ฝึกสอนที่เน้นการกลั่น

บน CIFAR-100:

| ครู นักเรียน | resnet32x4 resnet8x4 | VGG13 VGG8 | resnet32x4 Shufflenet-V2 |

|---|---|---|---|

| KD | 73.33 | 72.98 | 74.45 |

| KD+DOT | 75.12 | 73.77 | 75.55 |

บน Tiny-Imagenet:

| ครู นักเรียน | resnet18 mobilenet-v2 | resnet18 Shufflenet-V2 |

|---|---|---|

| KD | 58.35 | 62.26 |

| KD+DOT | 64.01 | 65.75 |

บน Imagenet:

| ครู นักเรียน | resnet34 resnet18 | resnet50 Mobilenet-V1 |

|---|---|---|

| KD | 71.03 | 70.50 |

| KD+DOT | 71.72 | 73.09 |

บน CIFAR-100:

| ครู นักเรียน | Resnet56 resnet20 | resnet110 resnet32 | resnet32x4 resnet8x4 | WRN-40-2 WRN-16-2 | WRN-40-2 WRN-40-1 | VGG13 VGG8 |

|---|---|---|---|---|---|---|

| KD | 70.66 | 73.08 | 73.33 | 74.92 | 73.54 | 72.98 |

| DKD | 71.97 | 74.11 | 76.32 | 76.23 | 74.81 | 74.68 |

| ครู นักเรียน | resnet32x4 Shufflenet-V1 | WRN-40-2 Shufflenet-V1 | VGG13 mobilenet-v2 | resnet50 mobilenet-v2 | resnet32x4 mobilenet-v2 |

|---|---|---|---|---|---|

| KD | 74.07 | 74.83 | 67.37 | 67.35 | 74.45 |

| DKD | 76.45 | 76.70 | 69.71 | 70.35 | 77.07 |

บน Imagenet:

| ครู นักเรียน | resnet34 resnet18 | resnet50 Mobilenet-V1 |

|---|---|---|

| KD | 71.03 | 70.50 |

| DKD | 71.70 | 72.05 |

Mdistiller รองรับวิธีการกลั่นต่อไปนี้ใน CIFAR-100, Imagenet และ MS-COCO:

| วิธี | ลิงค์กระดาษ | CIFAR-100 | ImageNet | MS-COCO |

|---|---|---|---|---|

| KD | https://arxiv.org/abs/1503.02531 | |||

| Fitnet | https://arxiv.org/abs/1412.6550 | |||

| ที่ | https://arxiv.org/abs/1612.03928 | |||

| nst | https://arxiv.org/abs/1707.01219 | |||

| PKT | https://arxiv.org/abs/1803.10837 | |||

| KDSVD | https://arxiv.org/abs/1807.06819 | |||

| OFD | https://arxiv.org/abs/1904.01866 | |||

| RKD | https://arxiv.org/abs/1904.05068 | |||

| VID | https://arxiv.org/abs/1904.05835 | |||

| SP | https://arxiv.org/abs/1907.09682 | |||

| CRD | https://arxiv.org/abs/1910.10699 | |||

| รีวิว | https://arxiv.org/abs/2104.09044 | |||

| DKD | https://arxiv.org/abs/2203.08679 |

สภาพแวดล้อม:

ติดตั้งแพ็คเกจ:

sudo pip3 install -r requirements.txt

sudo python3 setup.py develop

CFG.LOG.WANDB เป็น False ที่ mdistiller/engine/cfg.pyคุณสามารถประเมินประสิทธิภาพของโมเดลหรือโมเดลของเราที่ได้รับการฝึกฝนด้วยตัวเอง

โมเดลของเราอยู่ที่ https://github.com/megvii-research/mdistiller/releases/tag/checkpoints โปรดดาวน์โหลดจุดตรวจสอบไปที่ ./download_ckpts download_ckpts

หากทดสอบโมเดลใน ImageNet โปรดดาวน์โหลดชุดข้อมูลที่ https://image-net.org/ และนำไปที่ ./data/imagenet

# evaluate teachers

python3 tools/eval.py -m resnet32x4 # resnet32x4 on cifar100

python3 tools/eval.py -m ResNet34 -d imagenet # ResNet34 on imagenet

# evaluate students

python3 tools/eval.p -m resnet8x4 -c download_ckpts/dkd_resnet8x4 # dkd-resnet8x4 on cifar100

python3 tools/eval.p -m MobileNetV1 -c download_ckpts/imgnet_dkd_mv1 -d imagenet # dkd-mv1 on imagenet

python3 tools/eval.p -m model_name -c output/your_exp/student_best # your checkpoints ดาวน์โหลด cifar_teachers.tar ที่ https://github.com/megvii-research/mdistiller/releases/tag/checkpoints และ untar ไปที่ ./download_ckpts download_ckpts ผ่าน tar xvf cifar_teachers.tar

# for instance, our DKD method.

python3 tools/train.py --cfg configs/cifar100/dkd/res32x4_res8x4.yaml

# you can also change settings at command line

python3 tools/train.py --cfg configs/cifar100/dkd/res32x4_res8x4.yaml SOLVER.BATCH_SIZE 128 SOLVER.LR 0.1 ดาวน์โหลดชุดข้อมูลได้ที่ https://image-net.org/ และนำไปที่ ./data/imagenet imagenet

# for instance, our DKD method.

python3 tools/train.py --cfg configs/imagenet/r34_r18/dkd.yamlmdistiller/distillers/ และกำหนดเครื่องกลั่น from . _base import Distiller

class MyDistiller ( Distiller ):

def __init__ ( self , student , teacher , cfg ):

super ( MyDistiller , self ). __init__ ( student , teacher )

self . hyper1 = cfg . MyDistiller . hyper1

...

def forward_train ( self , image , target , ** kwargs ):

# return the output logits and a Dict of losses

...

# rewrite the get_learnable_parameters function if there are more nn modules for distillation.

# rewrite the get_extra_parameters if you want to obtain the extra cost.

... ลงทะเบียนผู้กลั่นใน distiller_dict ที่ mdistiller/distillers/__init__.py

ลงทะเบียนพารามิเตอร์ไฮเปอร์ที่สอดคล้องกันที่ mdistiller/engines/cfg.py

สร้างไฟล์กำหนดค่าใหม่และทดสอบ

หาก repo นี้มีประโยชน์สำหรับการวิจัยของคุณโปรดพิจารณาอ้างถึงกระดาษ:

@article { zhao2022dkd ,

title = { Decoupled Knowledge Distillation } ,

author = { Zhao, Borui and Cui, Quan and Song, Renjie and Qiu, Yiyu and Liang, Jiajun } ,

journal = { arXiv preprint arXiv:2203.08679 } ,

year = { 2022 }

}

@article { zhao2023dot ,

title = { DOT: A Distillation-Oriented Trainer } ,

author = { Zhao, Borui and Cui, Quan and Song, Renjie and Liang, Jiajun } ,

journal = { arXiv preprint arXiv:2307.08436 } ,

year = { 2023 }

}Mdistiller ได้รับการปล่อยตัวภายใต้ใบอนุญาต MIT ดูใบอนุญาตสำหรับรายละเอียด

ขอบคุณสำหรับ CRD และ ReviewKd เราสร้างห้องสมุดนี้ตาม codebase ของ CRD และ codebase ของ ReviewKd

ขอบคุณ Yiyu Qiu และ Yi Shi สำหรับการสนับสนุนรหัสระหว่างการฝึกงานในเทคโนโลยี Megvii

ขอบคุณซินจินสำหรับการอภิปรายเกี่ยวกับ DKD