Это репо есть

(1) Библиотека Pytorch, которая предоставляет классические алгоритмы дистилляции знаний на основных критериях CV,

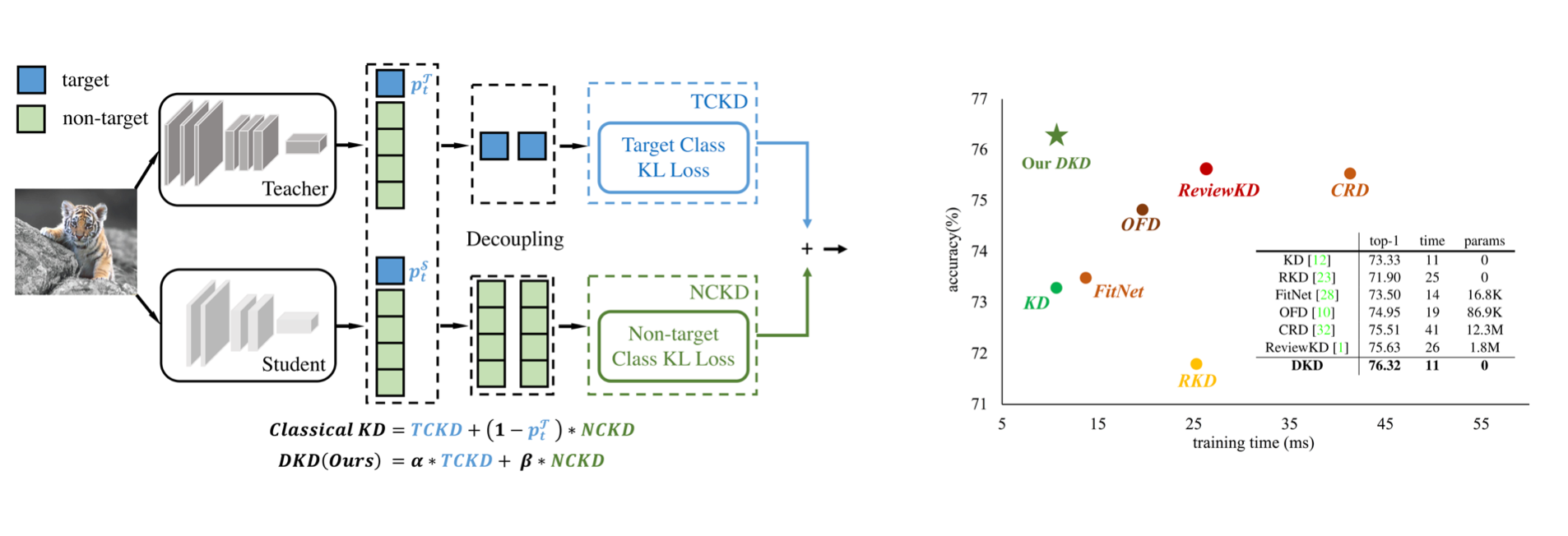

(2) Официальная реализация бумаги CVPR-2022: развязка дистилляции знаний.

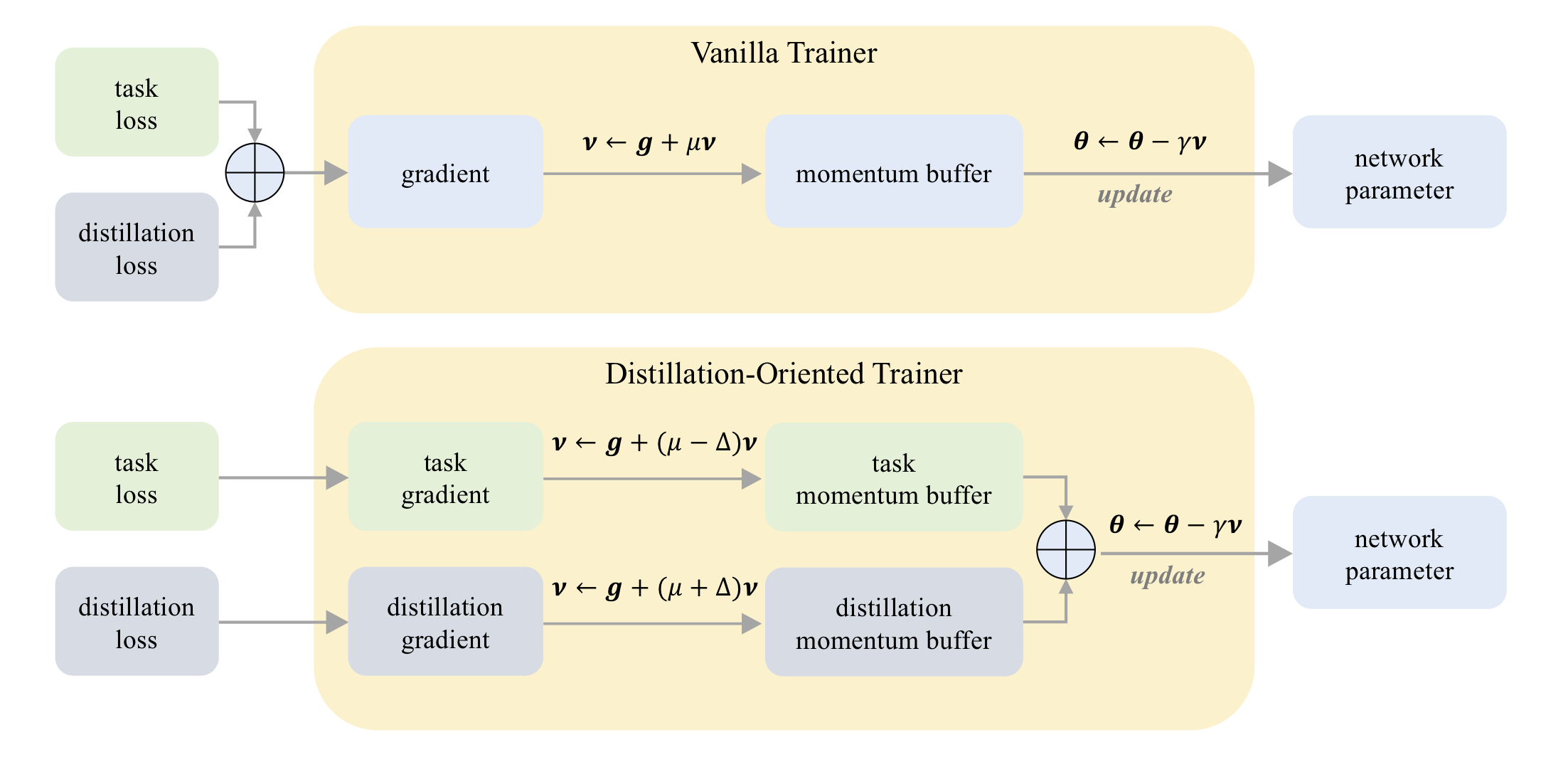

(3) Официальная реализация ICCV-2023 Paper: Dot: Тренер, ориентированный на дистилляцию.

На Cifar-100:

| Учитель Студент | Resnet32x4 Resnet8x4 | VGG13 VGG8 | Resnet32x4 Shufflenet-V2 |

|---|---|---|---|

| Дольдо | 73,33 | 72,98 | 74,45 |

| KD+DOT | 75.12 | 73,77 | 75,55 |

На крошечном Imagenet:

| Учитель Студент | Resnet18 Mobilenet-V2 | Resnet18 Shufflenet-V2 |

|---|---|---|

| Дольдо | 58.35 | 62,26 |

| KD+DOT | 64.01 | 65,75 |

На ImageNet:

| Учитель Студент | Resnet34 Resnet18 | Resnet50 Mobilenet-V1 |

|---|---|---|

| Дольдо | 71.03 | 70.50 |

| KD+DOT | 71.72 | 73,09 |

На Cifar-100:

| Учитель Студент | Resnet56 Resnet20 | Resnet110 Resnet32 | Resnet32x4 Resnet8x4 | WRN-40-2 WRN-16-2 | WRN-40-2 WRN-40-1 | VGG13 VGG8 |

|---|---|---|---|---|---|---|

| Дольдо | 70.66 | 73.08 | 73,33 | 74,92 | 73,54 | 72,98 |

| DKD | 71.97 | 74.11 | 76.32 | 76.23 | 74,81 | 74,68 |

| Учитель Студент | Resnet32x4 Shufflenet-V1 | WRN-40-2 Shufflenet-V1 | VGG13 Mobilenet-V2 | Resnet50 Mobilenet-V2 | Resnet32x4 Mobilenet-V2 |

|---|---|---|---|---|---|

| Дольдо | 74.07 | 74,83 | 67.37 | 67.35 | 74,45 |

| DKD | 76.45 | 76.70 | 69,71 | 70.35 | 77.07 |

На ImageNet:

| Учитель Студент | Resnet34 Resnet18 | Resnet50 Mobilenet-V1 |

|---|---|---|

| Дольдо | 71.03 | 70.50 |

| DKD | 71.70 | 72,05 |

Mdistiller поддерживает следующие методы дистилляции на CIFAR-100, ImageNet и MS-COCO:

| Метод | Бумажная ссылка | CIFAR-100 | ImageNet | MS-COCO |

|---|---|---|---|---|

| Дольдо | https://arxiv.org/abs/1503.02531 | ✓ | ✓ | |

| Fitnet | https://arxiv.org/abs/1412.6550 | ✓ | ||

| В | https://arxiv.org/abs/1612.03928 | ✓ | ✓ | |

| Нст | https://arxiv.org/abs/1707.01219 | ✓ | ||

| Пкт | https://arxiv.org/abs/1803.10837 | ✓ | ||

| KDSVD | https://arxiv.org/abs/1807.06819 | ✓ | ||

| Оф | https://arxiv.org/abs/1904.01866 | ✓ | ✓ | |

| РКД | https://arxiv.org/abs/1904.05068 | ✓ | ||

| Видео | https://arxiv.org/abs/1904.05835 | ✓ | ||

| Шрифт | https://arxiv.org/abs/1907.09682 | ✓ | ||

| CRD | https://arxiv.org/abs/1910.10699 | ✓ | ✓ | |

| Reviewkd | https://arxiv.org/abs/2104.09044 | ✓ | ✓ | ✓ |

| DKD | https://arxiv.org/abs/2203.08679 | ✓ | ✓ | ✓ |

Среда:

Установите пакет:

sudo pip3 install -r requirements.txt

sudo python3 setup.py develop

CFG.LOG.WANDB как False в mdistiller/engine/cfg.py .Вы можете оценить производительность наших моделей или моделей, обученных сами.

Наши модели по адресу https://github.com/megvii-research/mdistiller/releases/tag/checkpoints, пожалуйста, загрузите контрольные точки на ./download_ckpts

Если протестируйте модели на ImageNet, пожалуйста, загрузите набор данных по адресу https://image-net.org/ и поместите его в ./data/imagenet

# evaluate teachers

python3 tools/eval.py -m resnet32x4 # resnet32x4 on cifar100

python3 tools/eval.py -m ResNet34 -d imagenet # ResNet34 on imagenet

# evaluate students

python3 tools/eval.p -m resnet8x4 -c download_ckpts/dkd_resnet8x4 # dkd-resnet8x4 on cifar100

python3 tools/eval.p -m MobileNetV1 -c download_ckpts/imgnet_dkd_mv1 -d imagenet # dkd-mv1 on imagenet

python3 tools/eval.p -m model_name -c output/your_exp/student_best # your checkpoints Загрузите cifar_teachers.tar tar xvf cifar_teachers.tar адресу https://github.com/megvii-research/mdistiller/releases/tag/checkpoints и не допустить ./download_ckpts

# for instance, our DKD method.

python3 tools/train.py --cfg configs/cifar100/dkd/res32x4_res8x4.yaml

# you can also change settings at command line

python3 tools/train.py --cfg configs/cifar100/dkd/res32x4_res8x4.yaml SOLVER.BATCH_SIZE 128 SOLVER.LR 0.1 Загрузите набор данных по адресу https://image-net.org/ и поместите их на ./data/imagenet

# for instance, our DKD method.

python3 tools/train.py --cfg configs/imagenet/r34_r18/dkd.yamlmdistiller/distillers/ и определите дистиллятор from . _base import Distiller

class MyDistiller ( Distiller ):

def __init__ ( self , student , teacher , cfg ):

super ( MyDistiller , self ). __init__ ( student , teacher )

self . hyper1 = cfg . MyDistiller . hyper1

...

def forward_train ( self , image , target , ** kwargs ):

# return the output logits and a Dict of losses

...

# rewrite the get_learnable_parameters function if there are more nn modules for distillation.

# rewrite the get_extra_parameters if you want to obtain the extra cost.

... Regist The Distiller в distiller_dict в mdistiller/distillers/__init__.py

Регист-соответствующие гиперпараметры в mdistiller/engines/cfg.py

Создайте новый файл конфигурации и протестируйте его.

Если этот репо полезен для вашего исследования, пожалуйста, рассмотрите возможность ссылаться на статью:

@article { zhao2022dkd ,

title = { Decoupled Knowledge Distillation } ,

author = { Zhao, Borui and Cui, Quan and Song, Renjie and Qiu, Yiyu and Liang, Jiajun } ,

journal = { arXiv preprint arXiv:2203.08679 } ,

year = { 2022 }

}

@article { zhao2023dot ,

title = { DOT: A Distillation-Oriented Trainer } ,

author = { Zhao, Borui and Cui, Quan and Song, Renjie and Liang, Jiajun } ,

journal = { arXiv preprint arXiv:2307.08436 } ,

year = { 2023 }

}Mdistiller выпускается по лицензии MIT. Смотрите лицензию для деталей.

Спасибо за CRD и ReviewKD. Мы строим эту библиотеку на основе кодовой базы CRD и кодовой базы ReviewKd.

Спасибо Yiyu Qiu и Yi Shi за вклад кодекса во время их стажировки в технологии Megvii.

Спасибо Синь Джин за обсуждение DKD.