هذا الريبو هو

(1) مكتبة Pytorch التي توفر خوارزميات تقطير المعرفة الكلاسيكية على معايير السيرة الذاتية السائدة ،

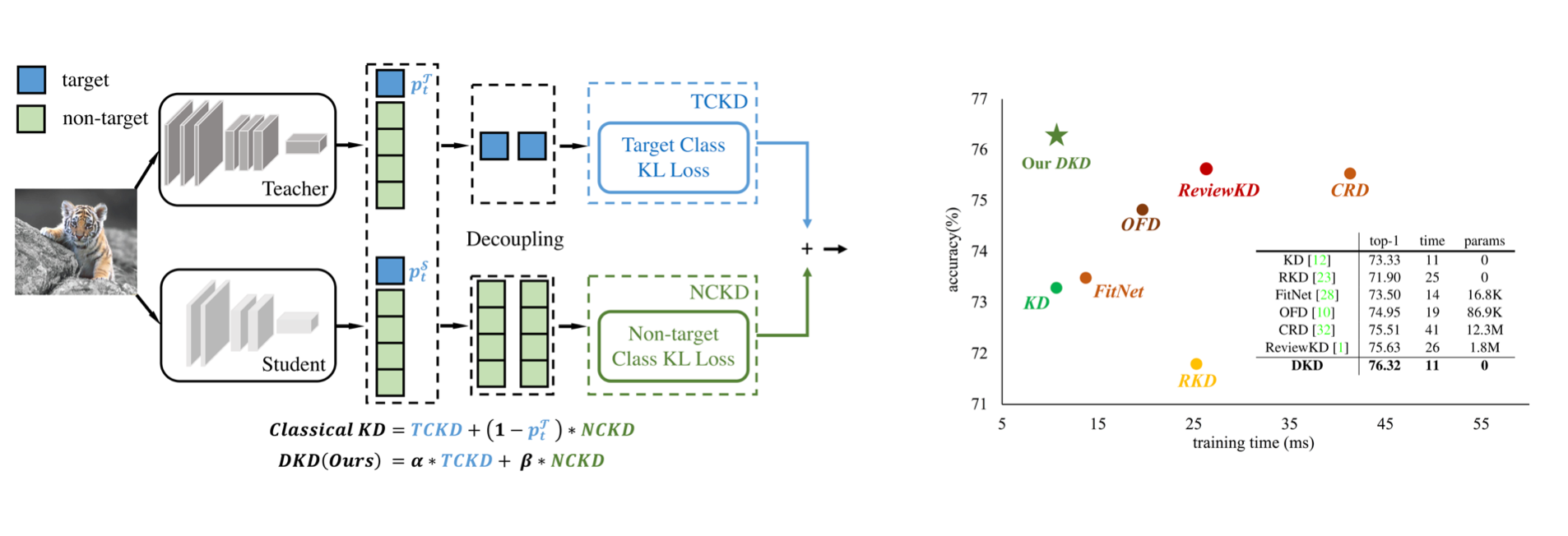

(2) التنفيذ الرسمي لورقة CVPR-2022: تقطير المعرفة المنفصل.

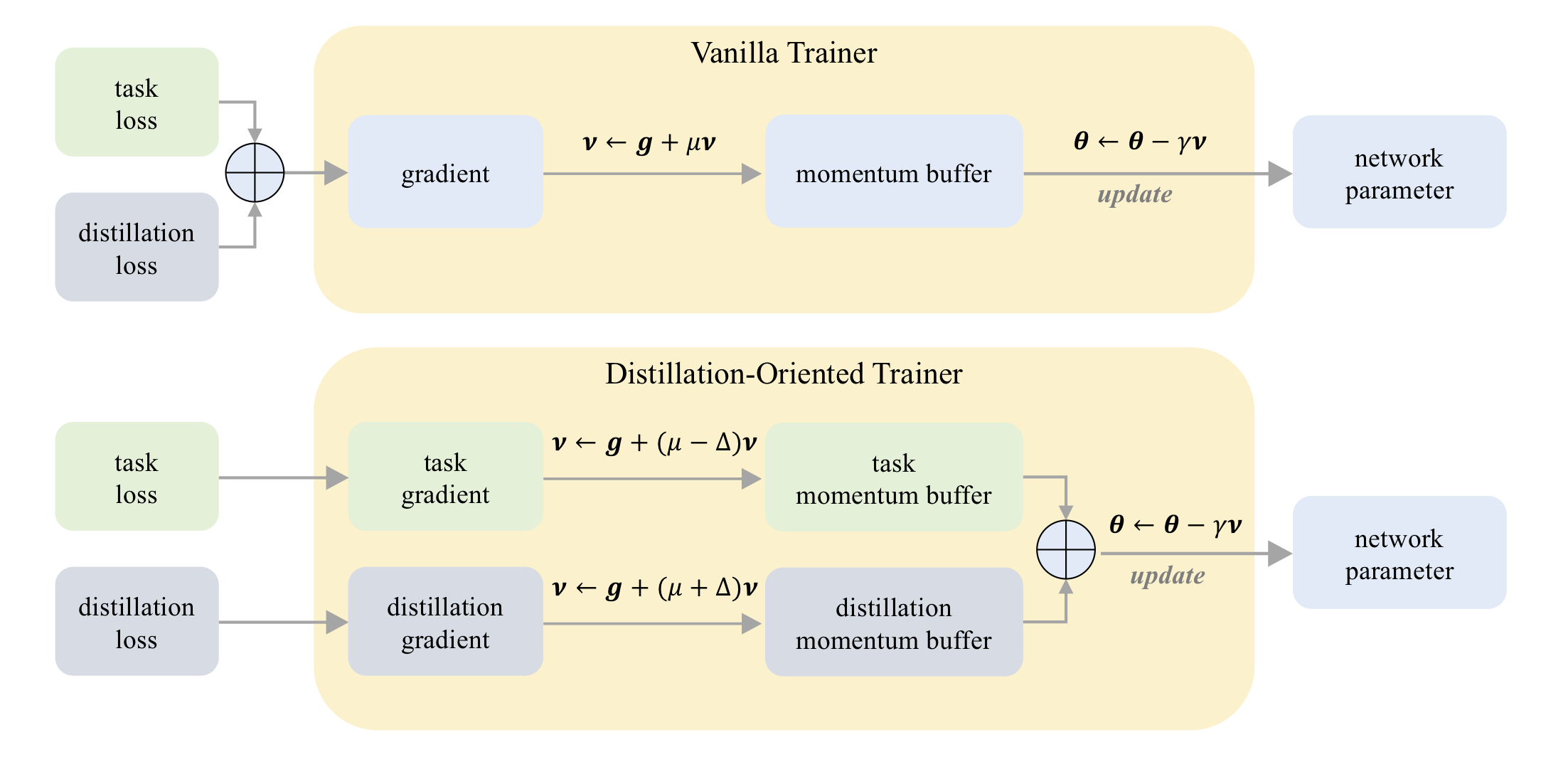

(3) التنفيذ الرسمي لورقة ICCV-2023: DOT: مدرب موجه التقطير.

على CIFAR-100:

| مدرس طالب | resnet32x4 resnet8x4 | VGG13 VGG8 | resnet32x4 Shufflenet-V2 |

|---|---|---|---|

| KD | 73.33 | 72.98 | 74.45 |

| KD+DOT | 75.12 | 73.77 | 75.55 |

على الإخلاص الصغير:

| مدرس طالب | RESNET18 Mobilenet-V2 | RESNET18 Shufflenet-V2 |

|---|---|---|

| KD | 58.35 | 62.26 |

| KD+DOT | 64.01 | 65.75 |

على ImageNet:

| مدرس طالب | resnet34 RESNET18 | RESNET50 Mobilenet-V1 |

|---|---|---|

| KD | 71.03 | 70.50 |

| KD+DOT | 71.72 | 73.09 |

على CIFAR-100:

| مدرس طالب | RESNET56 RESNET20 | RESNET110 RESNET32 | resnet32x4 resnet8x4 | WRN-40-2 WRN-16-2 | WRN-40-2 WRN-40-1 | VGG13 VGG8 |

|---|---|---|---|---|---|---|

| KD | 70.66 | 73.08 | 73.33 | 74.92 | 73.54 | 72.98 |

| DKD | 71.97 | 74.11 | 76.32 | 76.23 | 74.81 | 74.68 |

| مدرس طالب | resnet32x4 Shufflenet-V1 | WRN-40-2 Shufflenet-V1 | VGG13 Mobilenet-V2 | RESNET50 Mobilenet-V2 | resnet32x4 Mobilenet-V2 |

|---|---|---|---|---|---|

| KD | 74.07 | 74.83 | 67.37 | 67.35 | 74.45 |

| DKD | 76.45 | 76.70 | 69.71 | 70.35 | 77.07 |

على ImageNet:

| مدرس طالب | resnet34 RESNET18 | RESNET50 Mobilenet-V1 |

|---|---|---|

| KD | 71.03 | 70.50 |

| DKD | 71.70 | 72.05 |

يدعم Mdistiller طرق التقطير التالية على CIFAR-100 و ImageNet و MS-COCO:

| طريقة | رابط الورق | CIFAR-100 | ImageNet | MS-COCO |

|---|---|---|---|---|

| KD | https://arxiv.org/abs/1503.02531 | ✓ | ✓ | |

| fitnet | https://arxiv.org/abs/1412.6550 | ✓ | ||

| في | https://arxiv.org/abs/1612.03928 | ✓ | ✓ | |

| nst | https://arxiv.org/abs/1707.01219 | ✓ | ||

| PKT | https://arxiv.org/abs/1803.10837 | ✓ | ||

| KDSVD | https://arxiv.org/abs/1807.06819 | ✓ | ||

| OFD | https://arxiv.org/abs/1904.01866 | ✓ | ✓ | |

| RKD | https://arxiv.org/abs/1904.05068 | ✓ | ||

| فيد | https://arxiv.org/abs/1904.05835 | ✓ | ||

| sp | https://arxiv.org/abs/1907.09682 | ✓ | ||

| CRD | https://arxiv.org/abs/1910.10699 | ✓ | ✓ | |

| RepareKd | https://arxiv.org/abs/2104.09044 | ✓ | ✓ | ✓ |

| DKD | https://arxiv.org/abs/2203.08679 | ✓ | ✓ | ✓ |

البيئات:

تثبيت الحزمة:

sudo pip3 install -r requirements.txt

sudo python3 setup.py develop

CFG.LOG.WANDB False في mdistiller/engine/cfg.py .يمكنك تقييم أداء نماذجنا أو نماذجنا المدربة بنفسك.

نماذجنا ./download_ckpts في https://github.com/megvii-research

إذا اختبر النماذج الموجودة على ImageNet ، يرجى تنزيل مجموعة البيانات على https://image-net.org/ ووضعها على ./data/imagenet

# evaluate teachers

python3 tools/eval.py -m resnet32x4 # resnet32x4 on cifar100

python3 tools/eval.py -m ResNet34 -d imagenet # ResNet34 on imagenet

# evaluate students

python3 tools/eval.p -m resnet8x4 -c download_ckpts/dkd_resnet8x4 # dkd-resnet8x4 on cifar100

python3 tools/eval.p -m MobileNetV1 -c download_ckpts/imgnet_dkd_mv1 -d imagenet # dkd-mv1 on imagenet

python3 tools/eval.p -m model_name -c output/your_exp/student_best # your checkpoints قم بتنزيل cifar_teachers.tar على https://github.com/megvii- research/mdistiller/release/tag/checkpoints و untar it to ./download_ckpts عبر tar xvf cifar_teachers.tar .

# for instance, our DKD method.

python3 tools/train.py --cfg configs/cifar100/dkd/res32x4_res8x4.yaml

# you can also change settings at command line

python3 tools/train.py --cfg configs/cifar100/dkd/res32x4_res8x4.yaml SOLVER.BATCH_SIZE 128 SOLVER.LR 0.1 قم بتنزيل مجموعة البيانات على https://image-net.org/ ووضعها على ./data/imagenet

# for instance, our DKD method.

python3 tools/train.py --cfg configs/imagenet/r34_r18/dkd.yamlmdistiller/distillers/ وتحديد التقطير from . _base import Distiller

class MyDistiller ( Distiller ):

def __init__ ( self , student , teacher , cfg ):

super ( MyDistiller , self ). __init__ ( student , teacher )

self . hyper1 = cfg . MyDistiller . hyper1

...

def forward_train ( self , image , target , ** kwargs ):

# return the output logits and a Dict of losses

...

# rewrite the get_learnable_parameters function if there are more nn modules for distillation.

# rewrite the get_extra_parameters if you want to obtain the extra cost.

... Regist the distiller في distiller_dict في mdistiller/distillers/__init__.py

Regist المفردات المفرطة المقابلة في mdistiller/engines/cfg.py

إنشاء ملف تكوين جديد واختباره.

إذا كان هذا الريبو مفيدًا لبحثك ، فالرجاء التفكير في الاستشهاد بالورقة:

@article { zhao2022dkd ,

title = { Decoupled Knowledge Distillation } ,

author = { Zhao, Borui and Cui, Quan and Song, Renjie and Qiu, Yiyu and Liang, Jiajun } ,

journal = { arXiv preprint arXiv:2203.08679 } ,

year = { 2022 }

}

@article { zhao2023dot ,

title = { DOT: A Distillation-Oriented Trainer } ,

author = { Zhao, Borui and Cui, Quan and Song, Renjie and Liang, Jiajun } ,

journal = { arXiv preprint arXiv:2307.08436 } ,

year = { 2023 }

}يتم إصدار Mdistiller تحت رخصة معهد ماساتشوستس للتكنولوجيا. انظر الترخيص للحصول على التفاصيل.

شكرا ل CRD و reviewkd. نقوم ببناء هذه المكتبة استنادًا إلى قاعدة كود CRD و CodeBase's ReviewKD.

شكرًا Yiyu Qiu و Yi Shi على مساهمة الكود أثناء فترة التدريب في تقنية Megvii.

شكرا شين جين للمناقشة حول DKD.