Метрики машинного обучения для распределенных, масштабируемых применений пит -пищи.

Что такое Torchmetrics • Внедрение метрики • Встроенные метрики • Документы • Сообщество • Лицензия

Простая установка от PYPI

pip install torchmetricsУстановите с помощью Conda

conda install -c conda-forge torchmetricsPIP из источника

# with git

pip install git+https://github.com/Lightning-AI/torchmetrics.git@release/stablePIP от архива

pip install https://github.com/Lightning-AI/torchmetrics/archive/refs/heads/release/stable.zipДополнительные зависимости для специализированных показателей:

pip install torchmetrics[audio]

pip install torchmetrics[image]

pip install torchmetrics[text]

pip install torchmetrics[all] # install all of the aboveУстановите последнюю версию разработчика

pip install https://github.com/Lightning-AI/torchmetrics/archive/master.zipTorchmetrics-это коллекция из 100+ реализаций Pytorch Metrics и простого в использовании API для создания пользовательских метрик. Он предлагает:

Вы можете использовать Torchmetrics с любой моделью Pytorch или с пит -молнией, чтобы насладиться дополнительными функциями, такими как:

Метрики на основе модулей содержат внутренние метрические состояния (аналогичные параметрам модуля Pytorch), которые автоматизируют накопление и синхронизацию между устройствами!

Это можно запустить на процессоре, отдельном графическом процессоре или мульти-GPU!

Для одного графического процессора/процессора:

import torch

# import our library

import torchmetrics

# initialize metric

metric = torchmetrics . classification . Accuracy ( task = "multiclass" , num_classes = 5 )

# move the metric to device you want computations to take place

device = "cuda" if torch . cuda . is_available () else "cpu"

metric . to ( device )

n_batches = 10

for i in range ( n_batches ):

# simulate a classification problem

preds = torch . randn ( 10 , 5 ). softmax ( dim = - 1 ). to ( device )

target = torch . randint ( 5 , ( 10 ,)). to ( device )

# metric on current batch

acc = metric ( preds , target )

print ( f"Accuracy on batch { i } : { acc } " )

# metric on all batches using custom accumulation

acc = metric . compute ()

print ( f"Accuracy on all data: { acc } " )Использование показателей модуля остается одинаковым при использовании нескольких графических процессоров или нескольких узлов.

import os

import torch

import torch . distributed as dist

import torch . multiprocessing as mp

from torch import nn

from torch . nn . parallel import DistributedDataParallel as DDP

import torchmetrics

def metric_ddp ( rank , world_size ):

os . environ [ "MASTER_ADDR" ] = "localhost"

os . environ [ "MASTER_PORT" ] = "12355"

# create default process group

dist . init_process_group ( "gloo" , rank = rank , world_size = world_size )

# initialize model

metric = torchmetrics . classification . Accuracy ( task = "multiclass" , num_classes = 5 )

# define a model and append your metric to it

# this allows metric states to be placed on correct accelerators when

# .to(device) is called on the model

model = nn . Linear ( 10 , 10 )

model . metric = metric

model = model . to ( rank )

# initialize DDP

model = DDP ( model , device_ids = [ rank ])

n_epochs = 5

# this shows iteration over multiple training epochs

for n in range ( n_epochs ):

# this will be replaced by a DataLoader with a DistributedSampler

n_batches = 10

for i in range ( n_batches ):

# simulate a classification problem

preds = torch . randn ( 10 , 5 ). softmax ( dim = - 1 )

target = torch . randint ( 5 , ( 10 ,))

# metric on current batch

acc = metric ( preds , target )

if rank == 0 : # print only for rank 0

print ( f"Accuracy on batch { i } : { acc } " )

# metric on all batches and all accelerators using custom accumulation

# accuracy is same across both accelerators

acc = metric . compute ()

print ( f"Accuracy on all data: { acc } , accelerator rank: { rank } " )

# Resetting internal state such that metric ready for new data

metric . reset ()

# cleanup

dist . destroy_process_group ()

if __name__ == "__main__" :

world_size = 2 # number of gpus to parallelize over

mp . spawn ( metric_ddp , args = ( world_size ,), nprocs = world_size , join = True ) Реализация собственной метрики так же просто, как и подкласс torch.nn.Module . Проще говоря, подкласс torchmetrics.Metric и просто реализуйте методы update и compute :

import torch

from torchmetrics import Metric

class MyAccuracy ( Metric ):

def __init__ ( self ):

# remember to call super

super (). __init__ ()

# call `self.add_state`for every internal state that is needed for the metrics computations

# dist_reduce_fx indicates the function that should be used to reduce

# state from multiple processes

self . add_state ( "correct" , default = torch . tensor ( 0 ), dist_reduce_fx = "sum" )

self . add_state ( "total" , default = torch . tensor ( 0 ), dist_reduce_fx = "sum" )

def update ( self , preds : torch . Tensor , target : torch . Tensor ) -> None :

# extract predicted class index for computing accuracy

preds = preds . argmax ( dim = - 1 )

assert preds . shape == target . shape

# update metric states

self . correct += torch . sum ( preds == target )

self . total += target . numel ()

def compute ( self ) -> torch . Tensor :

# compute final result

return self . correct . float () / self . total

my_metric = MyAccuracy ()

preds = torch . randn ( 10 , 5 ). softmax ( dim = - 1 )

target = torch . randint ( 5 , ( 10 ,))

print ( my_metric ( preds , target )) Подобно torch.nn , большинство метрик имеют как модульную, так и функциональную версию. Функциональные версии представляют собой простые функции Python, которые в качестве ввода принимают Torch.tensors и возвращают соответствующую метрику в качестве Torch.tensor.

import torch

# import our library

import torchmetrics

# simulate a classification problem

preds = torch . randn ( 10 , 5 ). softmax ( dim = - 1 )

target = torch . randint ( 5 , ( 10 ,))

acc = torchmetrics . functional . classification . multiclass_accuracy (

preds , target , num_classes = 5

)В общей сложности Torchmetrics содержит 100+ метрик, которые охватывают следующие домены:

Каждый домен может потребовать некоторых дополнительных зависимостей, которые могут быть установлены с помощью pip install torchmetrics[audio] , pip install torchmetrics['image'] и т. Д.

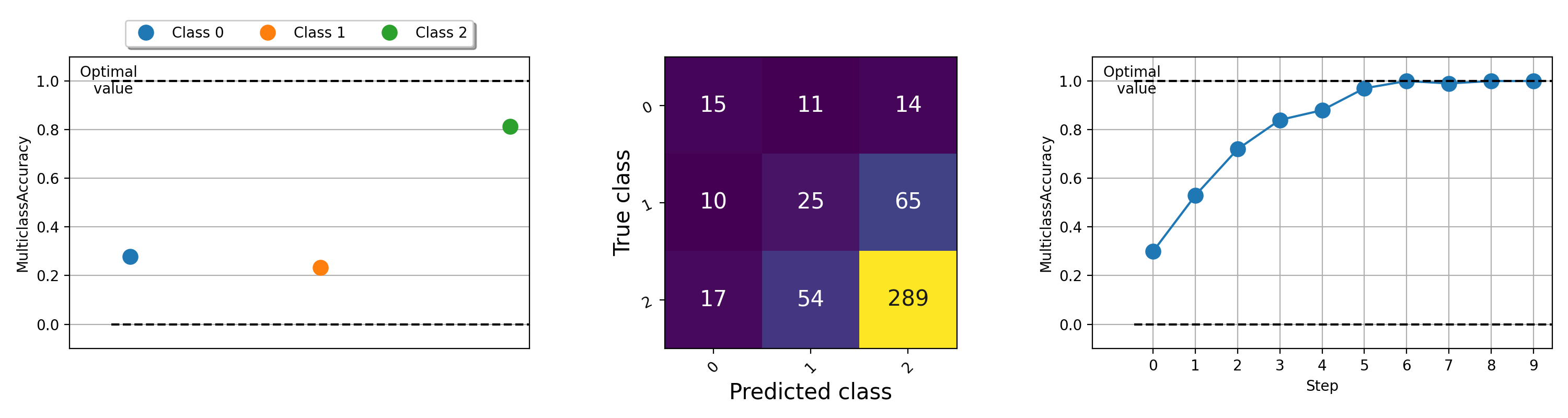

Визуализация метрик может быть важной, чтобы помочь понять, что происходит с вашим алгоритмами машинного обучения. Torchmetrics обладает встроенной поддержкой построения построения (установите зависимости с pip install torchmetrics[visual] ) практически для всех модульных метрик с помощью метода .plot . Просто вызовите метод, чтобы получить простую визуализацию любой метрики!

import torch

from torchmetrics . classification import MulticlassAccuracy , MulticlassConfusionMatrix

num_classes = 3

# this will generate two distributions that comes more similar as iterations increase

w = torch . randn ( num_classes )

target = lambda it : torch . multinomial (( it * w ). softmax ( dim = - 1 ), 100 , replacement = True )

preds = lambda it : torch . multinomial (( it * w ). softmax ( dim = - 1 ), 100 , replacement = True )

acc = MulticlassAccuracy ( num_classes = num_classes , average = "micro" )

acc_per_class = MulticlassAccuracy ( num_classes = num_classes , average = None )

confmat = MulticlassConfusionMatrix ( num_classes = num_classes )

# plot single value

for i in range ( 5 ):

acc_per_class . update ( preds ( i ), target ( i ))

confmat . update ( preds ( i ), target ( i ))

fig1 , ax1 = acc_per_class . plot ()

fig2 , ax2 = confmat . plot ()

# plot multiple values

values = []

for i in range ( 10 ):

values . append ( acc ( preds ( i ), target ( i )))

fig3 , ax3 = acc . plot ( values )

Для примеров построения различных метрик попробуйте запустить этот пример файла.

Команда Lightning + Torchmetrics усердно работает, добавляя еще больше метрик. Но мы ищем невероятных участников, таких как вы, чтобы представить новые метрики и улучшить существующие!

Присоединяйтесь к нашему Discord, чтобы получить помощь, став участником!

Для получения помощи или вопросов, присоединяйтесь к нашему огромному сообществу о Discord!

Мы рады продолжить сильное наследие программного обеспечения с открытым исходным кодом, и на протяжении многих лет были вдохновлены Caffe, Theano, Keras, Pytorch, Torchbarer, Ignite, Sklearn и Fast.ai.

Если вы хотите процитировать эту структуру, не стесняйтесь использовать встроенную опцию цитирования GitHub, чтобы создать цитату в стиле Bibtex или APA на основе этого файла (но только если вам это понравилось?).

Пожалуйста, соблюдайте лицензию Apache 2.0, которая указана в этом репозитории. Кроме того, платформа молнии находится в ожидании патента.