Код и данные для наших выводов EMNLP 2023 Бумага: еда (бумага).

Наши ключи-это:

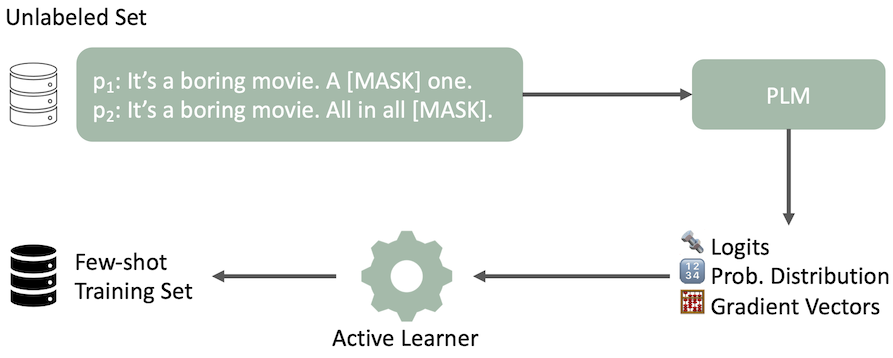

Наш модифицированный конвейер активного обучения для выбора данных иллюстрируется примером предложения и двумя подсказками для анализа настроений. PLM выводит несколько функций в нулевом выстреле. AL выбирает несколько учебных наборов на основе этих выходных функций.

Наш модифицированный конвейер активного обучения для выбора данных иллюстрируется примером предложения и двумя подсказками для анализа настроений. PLM выводит несколько функций в нулевом выстреле. AL выбирает несколько учебных наборов на основе этих выходных функций.

| ACC ↑ | Ранг ↓ | Дивизион ↑ | Реп. ↑ | ENT. ↓ | |

|---|---|---|---|---|---|

| Случайный | 72,6 ± 2,8 | 4.0 | 13.6 | 17.6 | 2.0 |

| Энтропия | 70,9 | 6.4 | 13.3 | 16.9 | 6.1 |

| LC | 70,9 | 5.6 | 13.5 | 17.2 | 5.3 |

| Бт | 72.1 | 4.0 | 13.4 | 17.1 | 5.6 |

| PP-KL (наш) | 69.1 | 5.6 | 13.4 | 16.9 | 9.0 |

| Кал | 70.4 | 4.4 | 13.1 | 17.1 | 23.5 |

| ЗНАЧОК | 73,2 ± 3,3 | 3.0 | 13.6 | 17.6 | 2.2 |

| Ipusd (наш) | 73,9 ± 2,3 | 3.0 | 13.5 | 17.6 | 2.0 |

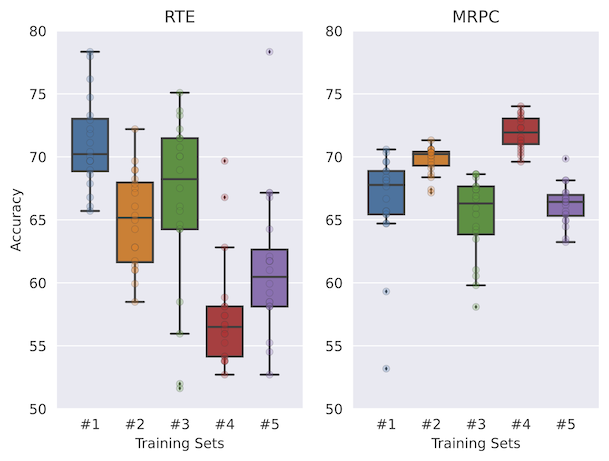

IPUSD, предлагаемая наша стратегия выбора данных, для нескольких выстрелов достигает более высокую точность, предлагая гораздо более низкую дисперсию в RTE, SST-2, SST-5, TREC и MRPC. Мы показываем, что эвристика, такая как случайная или самая высокая энтропия, приведет к гораздо более низкой производительности.

Ознакомьтесь с разделениями данных для различных стратегий активного обучения (включая немеченые и оценки данных в папке наборов данных.

@inproceedings{koksal-etal-2023-meal,

title = "{MEAL}: Stable and Active Learning for Few-Shot Prompting",

author = {K{"o}ksal, Abdullatif and

Schick, Timo and

Schuetze, Hinrich},

editor = "Bouamor, Houda and

Pino, Juan and

Bali, Kalika",

booktitle = "Findings of the Association for Computational Linguistics: EMNLP 2023",

month = dec,

year = "2023",

address = "Singapore",

publisher = "Association for Computational Linguistics",

url = "https://aclanthology.org/2023.findings-emnlp.36",

doi = "10.18653/v1/2023.findings-emnlp.36",

pages = "506--517"

}