Wenhao Wu 1,2 , Huanjin Yao 2,3 , Mengxi Zhang 2,4 , Yuxin Song 2 , Wanli Ouyang 5 , Jingdong Wang 2

1 Университет Сиднея, 2 Байду, 3 Университета Цингхуа, 4 Университета Тяньцзинь, 5 Китайский университет Гонконга

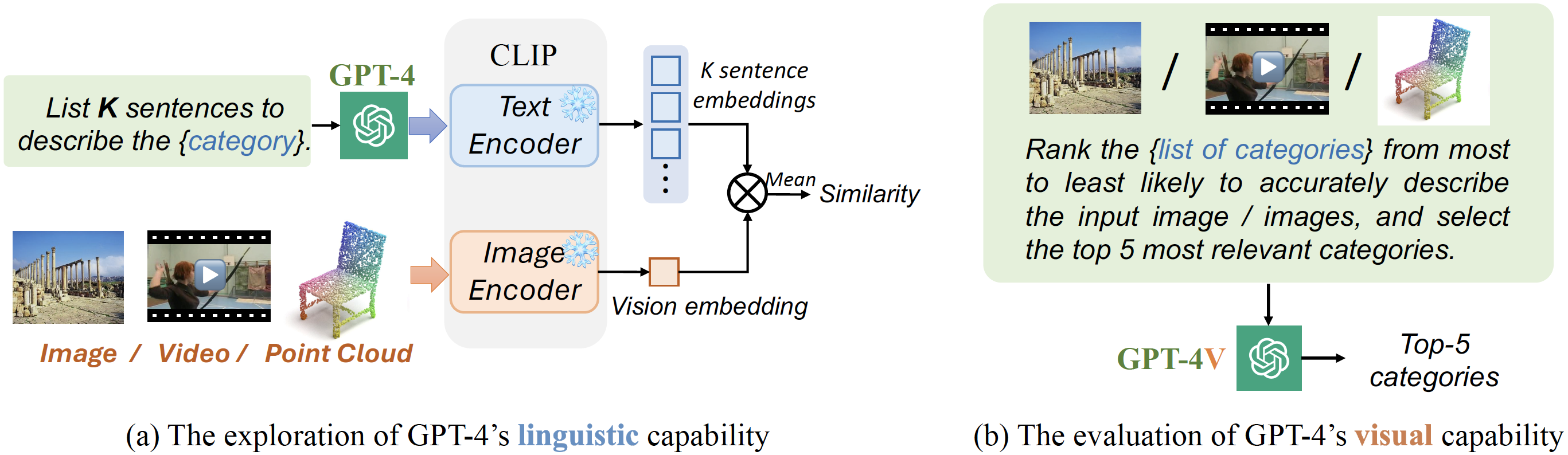

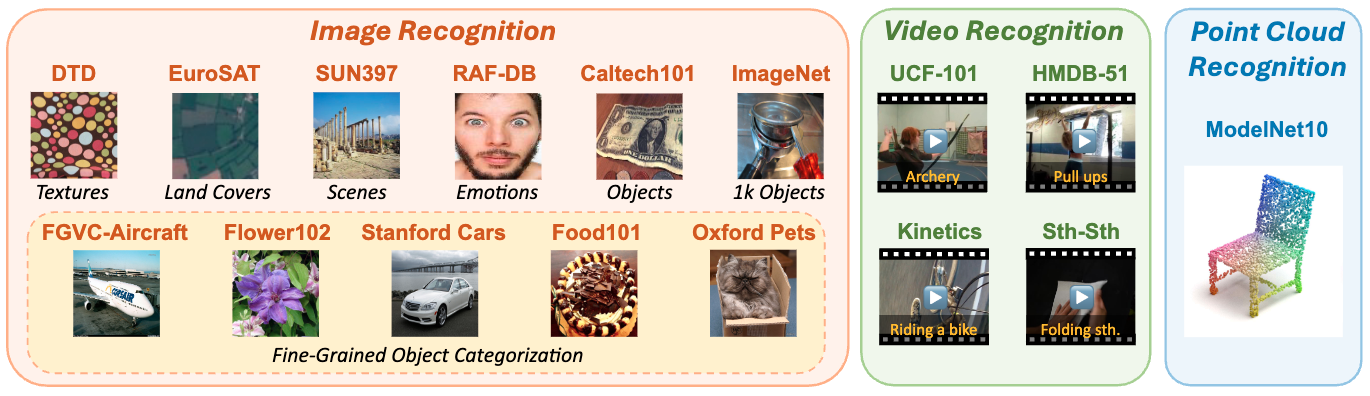

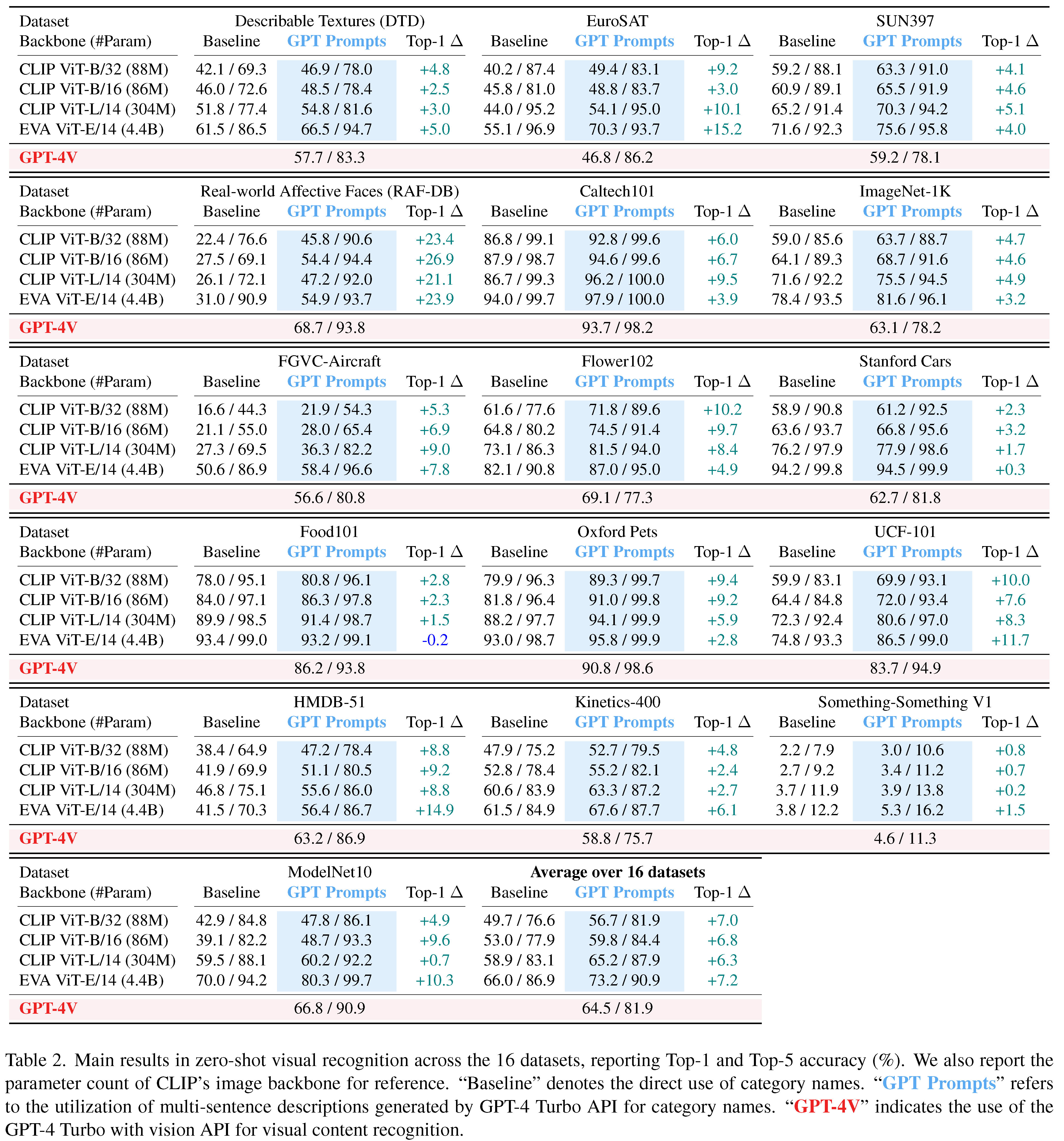

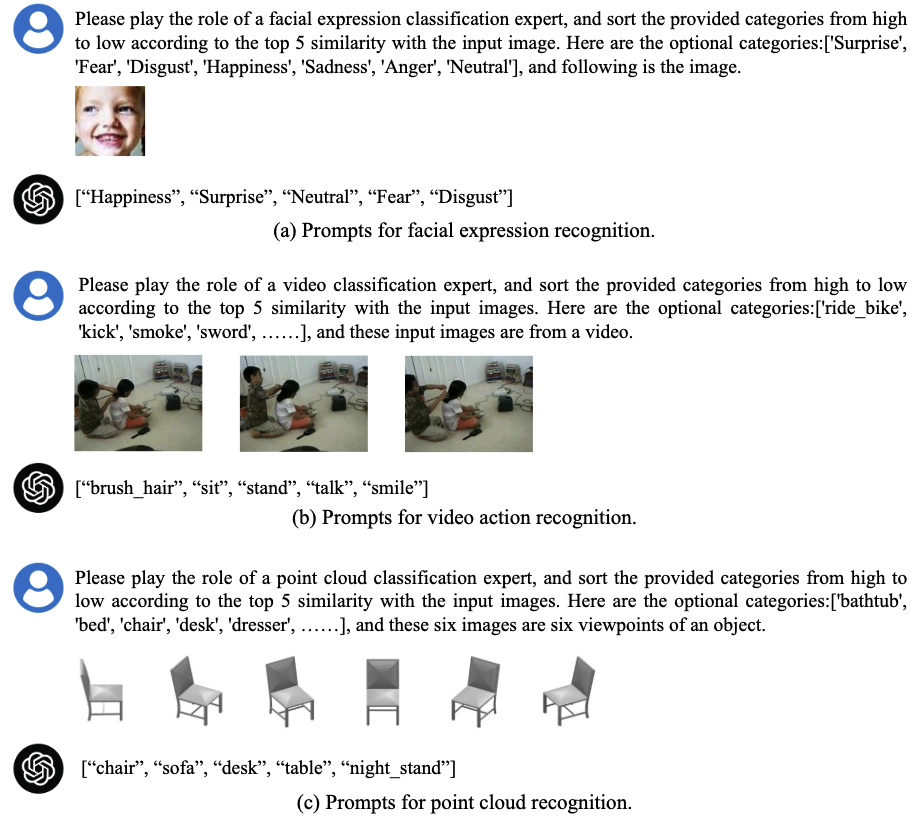

Эта работа углубляется в важную, но должна знать базовую линию в свете последних достижений в генеративном искусственном интеллекте (Genai): использование GPT-4 для визуального понимания. Мы сосредоточены на оценке лингвистических и визуальных возможностей GPT-4 в задачах визуального распознавания с нулевым выстрелом. Чтобы обеспечить всестороннюю оценку, мы провели эксперименты по трем методам - изображения, видео и точечные облака - в общей сложности 16 популярных академических эталон.

Пересмотр классификатора: передача моделей на языке зрения для распознавания видео

Венхао Ву, Жун Сан, Ванли Оуян

Двунаправленное межмодальное исследование знаний для распознавания видео с предварительно обученными моделями на языке зрения

Вэнхао Ву, Сяохан Ван, Хайпенг Луо, Цзиндон Ванг, И Ян, Ванли Оуян

CAP4Video: Что могут сделать вспомогательные подписи для поиска текстового видео?

Вэнхао Ву, Хайпенг Луо, Бо Фанг, Цзиндонг Ван, Ванли Оуян

Принято CVPR 2023 AS? Hight? |

Зрительное распознавание с нулевым выстрелом с использованием лингвистических и визуальных возможностей GPT-4.

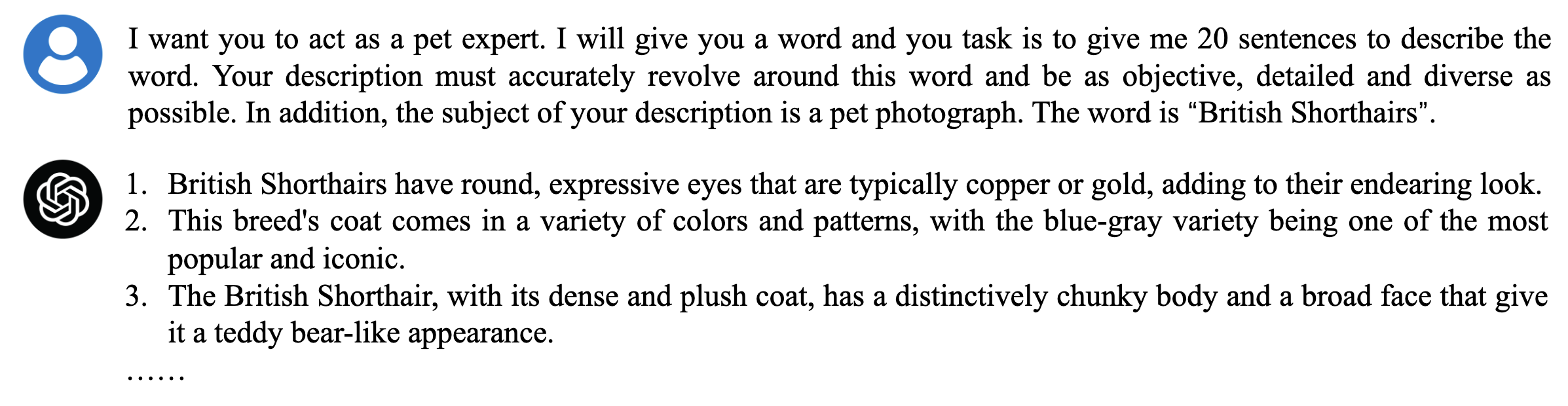

Мы имеем предварительно сгенерированные описательные предложения для всех категорий в наборах данных, которые вы можете найти в папке gpt_generated_prompts . Наслаждайтесь изучением!

Мы также предоставили пример сценария, чтобы помочь вам генерировать описания с использованием GPT-4. Для этого, пожалуйста, обратитесь к файлу generate_prompt.py. Счастливого кодирования! Пожалуйста, обратитесь к папке конфигурации для подробной информации обо всех наборах данных, используемых в нашем проекте.

Выполните следующую команду, чтобы сгенерировать описания с GPT-4.

# To run the script for specific dataset, simply update the following line with the name of the dataset you're working with:

# dataset_name = ["Dataset Name Here"] # e.g., dtd

python generate_prompt.py

Мы делимся примером сценария, который демонстрирует, как использовать API GPT-4V для прогнозов с нулевым выстрелом в наборе данных DTD. Пожалуйста, обратитесь к файлу gpt4v_zs.py для пошагового руководства по реализации этого. Мы надеемся, что это поможет вам начать с легкостью!

# GPT4V zero-shot recognition script.

# dataset_name = ["Dataset Name Here"] # e.g., dtd

python GPT4V_ZS.pyВсе результаты доступны в папке gpt4v_zs_results ! Кроме того, мы предоставили ссылку наборы данных вместе с их соответствующими наземными истинами (папкой аннотаций ), чтобы помочь читателям воспроизвести результаты. Примечание. Для определенных наборов данных мы могли бы удалить префиксы из идентификаторов образца. Например, в случае ImageNet «ILSVRC2012_VAL_00031094.JPEG» был изменен на «00031094.jpeg».

| Dtd | Евросат | Sun397 | RAF-DB | Caltech101 | ImageNet-1K | FGVC-Aircraft | Flower102 |

|---|---|---|---|---|---|---|---|

| 57.7 | 46.8 | 59,2 | 68.7 | 93,7 | 63.1 | 56.6 | 69.1 |

| Этикетка | Этикетка | Этикетка | Этикетка | Этикетка | Этикетка | Этикетка | Этикетка |

| Стэнфордские машины | Food101 | Оксфордские домашние животные | UCF-101 | HMDB-51 | Кинетика-400 | ModelNet-10 |

|---|---|---|---|---|---|---|

| 62,7 | 86.2 | 90.8 | 83,7 | 58.8 | 58.8 | 66.9 |

| Этикетка | Этикетка | Этикетка | Этикетка | Этикетка | Этикетка | Этикетка |

Благодаря предоставленным файлам прогнозирования и аннотации вы можете воспроизвести наши результаты точности TOP-1/TOP-5 с помощью сценария CARDELUTE_ACC.PY.

# pred_json_path = 'GPT4V_ZS_Results/imagenet.json'

# gt_json_path = 'annotations/imagenet_gt.json'

python calculate_acc.pyДля получения руководства по настройке и запуску API GPT-4 мы рекомендуем проверить официальную документацию Openai QuickStart, доступную по адресу: openai QuickStart Guide.

Если вы используете наш код в своем исследовании или хотите ссылаться на результаты, пожалуйста, снимайтесь? Это репо и использовать следующий бибтек? вход.

@article { GPT4Vis ,

title = { GPT4Vis: What Can GPT-4 Do for Zero-shot Visual Recognition? } ,

author = { Wu, Wenhao and Yao, Huanjin and Zhang, Mengxi and Song, Yuxin and Ouyang, Wanli and Wang, Jingdong } ,

booktitle = { arXiv preprint arXiv:2311.15732 } ,

year = { 2023 }

}Эта оценка построена на отличных работах:

Мы выражаем нашу искреннюю благодарность этим участникам.

По любым вопросам, пожалуйста, не стесняйтесь подать проблему.