Wenhao Wu 1,2 、Huanjin Yao 2,3 、Mengxi Zhang 2,4 、Yuxin Song 2 、Wanli Ouyang 5 、Jingdong Wang 2

1シドニー大学、 2バイドゥ、 3 Tsinghua University、 4 Tianjin University、 5香港中国大学

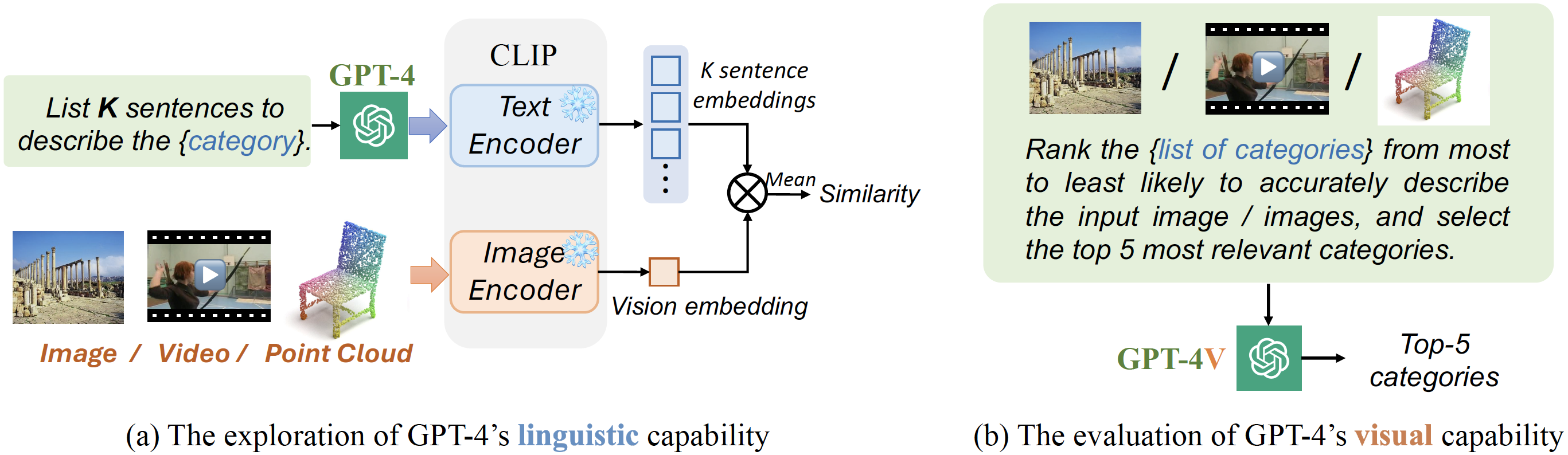

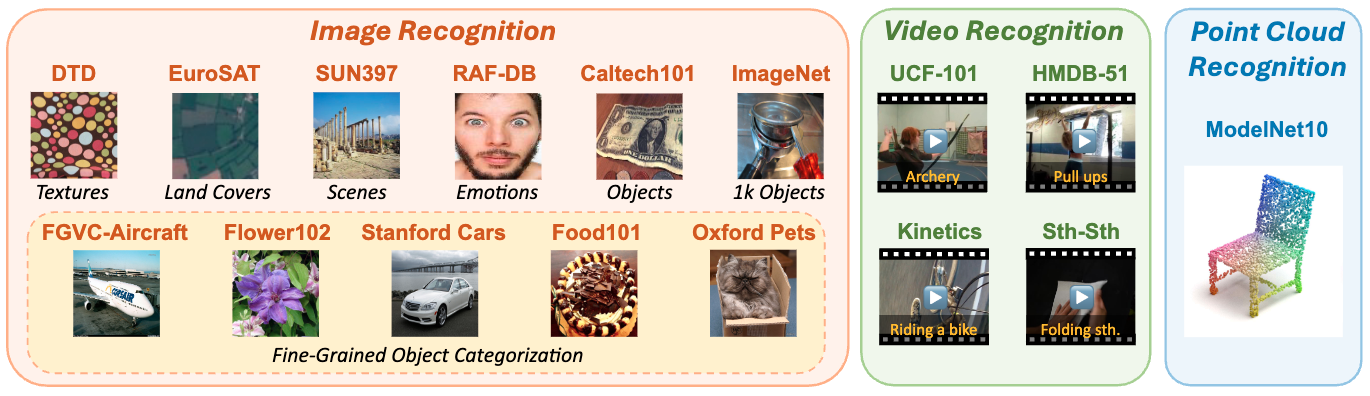

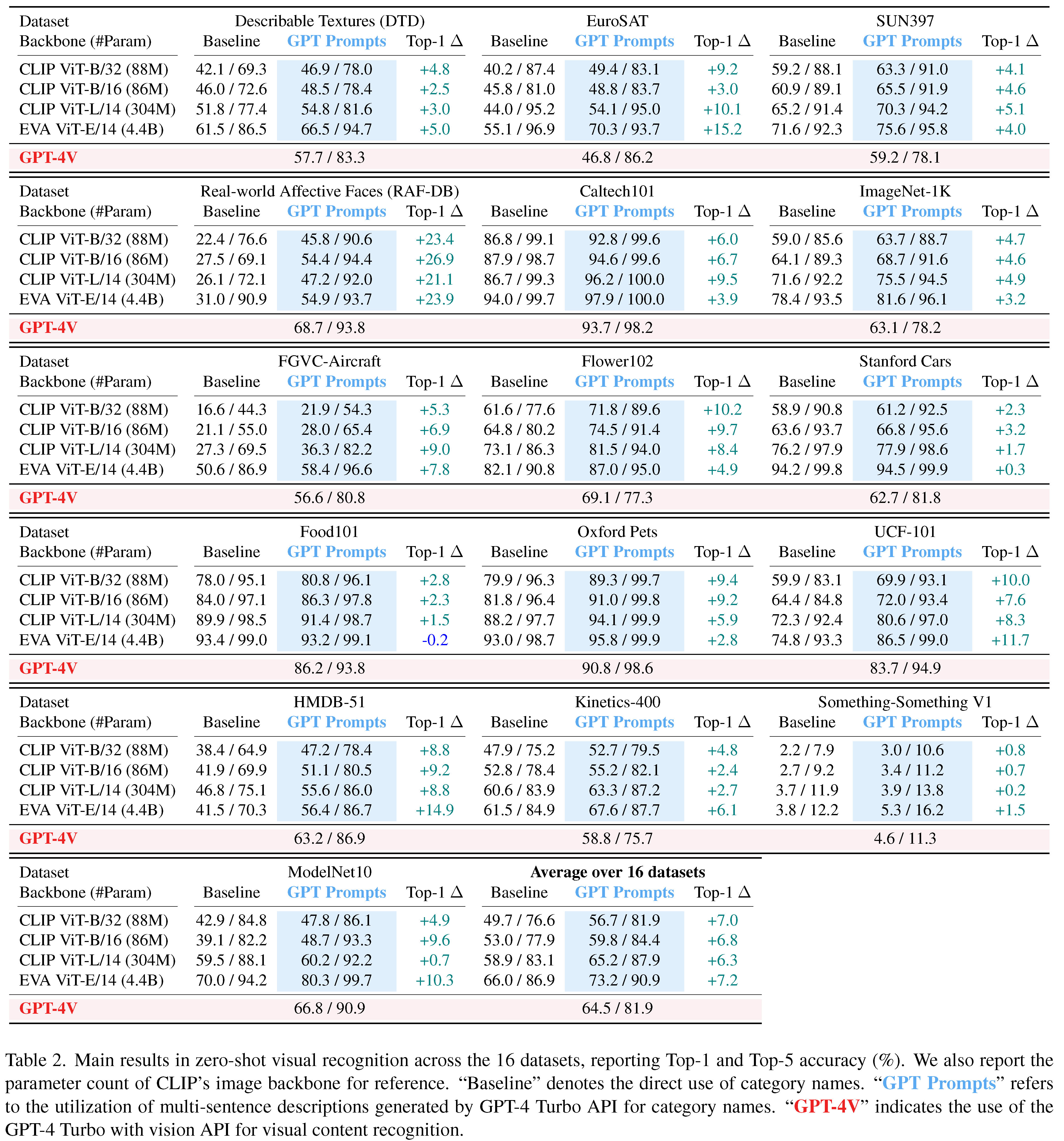

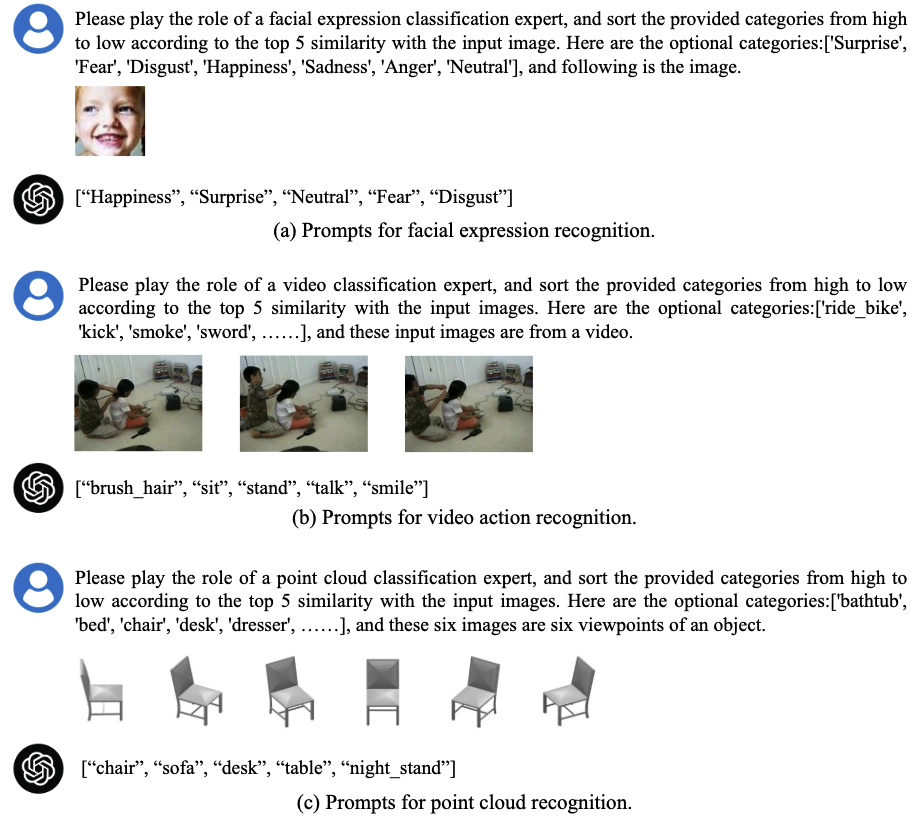

この作業は、生成人工知能(GENAI)の最新の進歩、視覚的理解のためのGPT-4の利用に照らして、本質的でありながら必須のベースラインを掘り下げます。ゼロショットの視覚認識タスクにおけるGPT-4の言語的および視覚的能力の評価に集中しています。包括的な評価を確保するために、イメージ、ビデオ、ポイントクラウドの3つのモダリティで実験を実施しました。

再検討分類器:ビデオ認識のためにビジョン言語モデルを転送します

Wenhao Wu、Zhun Sun、Wanli Oyang

事前に訓練されたビジョン言語モデルを使用したビデオ認識のための双方向クロスモーダル知識探査

Wenhao Wu、Xiaohan Wang、Haipeng Luo、Jingdong Wang、Yi Yang、Wanli Ouyang

Cap4Video:補助キャプションは、テキストビデオ取得に対して何ができますか?

Wenhao Wu、Haipeng Luo、Bo Fang、Jingdong Wang、Wanli Ouyang

CVPR 2023によって?ハイライトとして受け入れられていますか? |

GPT-4の言語的および視覚的能力を活用するゼロショット視覚認識。

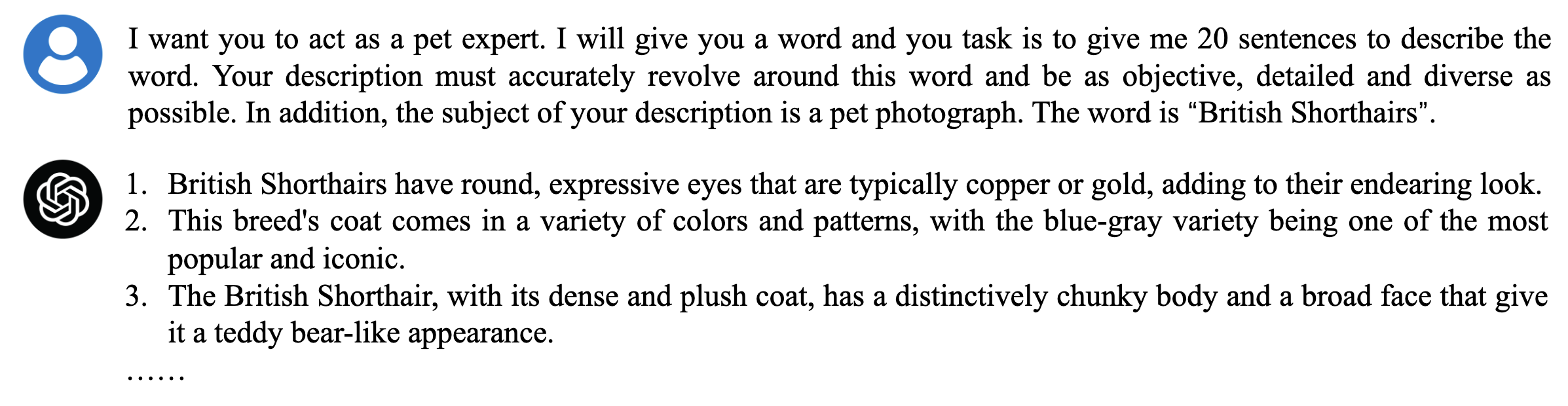

データセット全体のすべてのカテゴリに対して事前に生成された記述文があります。これは、 GPT_GENERATED_PROMPTSフォルダーで見つけることができます。探索を楽しんでください!

また、GPT-4を使用して説明を生成するのに役立つサンプルスクリプトも提供しました。これに関するガイダンスについては、Generate_prompt.pyファイルを参照してください。ハッピーコーディング!プロジェクトで使用されているすべてのデータセットの詳細については、 configフォルダーを参照してください。

次のコマンドを実行して、GPT-4で説明を生成します。

# To run the script for specific dataset, simply update the following line with the name of the dataset you're working with:

# dataset_name = ["Dataset Name Here"] # e.g., dtd

python generate_prompt.py

DTDデータセットでゼロショット予測にGPT-4V APIを使用する方法を示す例を共有します。これを実装する段階的なガイドについては、GPT4V_ZS.PYファイルを参照してください。簡単に始めるのに役立つことを願っています!

# GPT4V zero-shot recognition script.

# dataset_name = ["Dataset Name Here"] # e.g., dtd

python GPT4V_ZS.pyすべての結果は、 GPT4V_ZS_RESULTSフォルダーで入手できます!さらに、データセットリンクと、対応するグラウンドトゥルース(アノテーションフォルダー)を提供して、読者が結果を再現するのに役立ちました。注:特定のデータセットについては、サンプルIDからプレフィックスを削除した可能性があります。たとえば、Imagenetの場合、「ILSVRC2012_VAL_00031094.jpeg」は「00031094.jpeg」に変更されました。

| DTD | ユーロサット | Sun397 | RAF-DB | Caltech101 | Imagenet-1K | fgvc-aircraft | Flower102 |

|---|---|---|---|---|---|---|---|

| 57.7 | 46.8 | 59.2 | 68.7 | 93.7 | 63.1 | 56.6 | 69.1 |

| ラベル | ラベル | ラベル | ラベル | ラベル | ラベル | ラベル | ラベル |

| スタンフォード車 | Food101 | オックスフォードペット | UCF-101 | HMDB-51 | 速度論-400 | ModelNet-10 |

|---|---|---|---|---|---|---|

| 62.7 | 86.2 | 90.8 | 83.7 | 58.8 | 58.8 | 66.9 |

| ラベル | ラベル | ラベル | ラベル | ラベル | ラベル | ラベル |

提供された予測および注釈ファイルを使用すると、Calculate_acc.pyスクリプトでTOP-1/TOP-5の精度結果を再現できます。

# pred_json_path = 'GPT4V_ZS_Results/imagenet.json'

# gt_json_path = 'annotations/imagenet_gt.json'

python calculate_acc.pyGPT-4 APIのセットアップと実行に関するガイダンスについては、Openai Quickstart Guideで利用可能な公式Openai QuickStartドキュメントをチェックすることをお勧めします。

調査でコードを使用する場合、または結果を参照したい場合は、主演してください。このレポで、次のbibtexを使用しますか?エントリ。

@article { GPT4Vis ,

title = { GPT4Vis: What Can GPT-4 Do for Zero-shot Visual Recognition? } ,

author = { Wu, Wenhao and Yao, Huanjin and Zhang, Mengxi and Song, Yuxin and Ouyang, Wanli and Wang, Jingdong } ,

booktitle = { arXiv preprint arXiv:2311.15732 } ,

year = { 2023 }

}この評価は、優れた作品に基づいて構築されています。

これらの貢献者に心から感謝します。

質問がある場合は、お気軽に問題を提出してください。