2024 년 2 월 24 일, 인공 지능 분야에서 중요한 돌파구가 이루어졌습니다. 360 Intelligent Brain Team과 Peking University가 공동으로 개발 한 중간 규모의 추론 모델 Tiny-R1-32B-PREVIEW가 공식적으로 발표되었습니다. 이 혁신적인 모델은 5% 파라미터 볼트를 사용하여 DeepSeek-R1-671B의 전직 건강 성능에 성공적으로 접근하여 효율적인 추론 분야의 새로운 가능성을 열어줍니다.

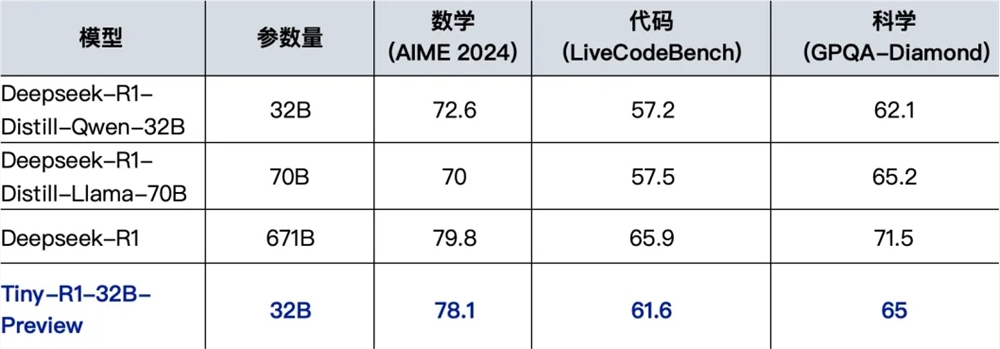

성능 테스트에서 Tiny-R1-32B-Prreview는 인상적인 성능을 보여주었습니다. 특히 수학 분야 에서이 모델은 AIME2024 리뷰에서 78.1의 탁월한 점수를 얻었으며, 이는 원래 R1 모델의 79.8 점에서 1.7 점에 불과하며 DeepSeek-R1-Distill-Llama-70B의 70.0 점수보다 훨씬 앞서 있습니다. 프로그래밍 및 과학 분야 에서이 모델은 또한 Livecodebench 및 GPQA-Diamond 테스트에서 각각 61.6 및 65.0 포인트를 달성하여 현재 최고의 오픈 소스 70B 모델을 능가했습니다. 이 일련의 업적은 Tiny-R1-32B-Preview의 탁월한 성능을 증명할뿐만 아니라 추론 비용을 크게 줄임으로써 효율성이 크게 향상됩니다.

이러한 획기적인 결과 뒤에는 연구팀의 혁신적인 "분할 및 수렴 통합"전략이 있습니다. 이 전략은 먼저 DeepSeek-R1을 기반으로 대규모 필드 데이터를 생성하고 수학, 프로그래밍 및 과학의 세 가지 수직 필드에서 전문 모델을 훈련시킵니다. 그 후, 연구팀은 Arcee Team의 MergeKit 도구를 사용하여 지능형 통합을 사용하여 단일 모델의 성능 제한을 성공적으로 깨뜨리고 멀티 태스크의 균형 잡힌 최적화를 달성했습니다. 이 혁신적인 기술 경로는 모델의 전반적인 성능을 크게 향상시킬뿐만 아니라 추론 모델의 향후 개발을위한 새로운 아이디어와 방향을 제공합니다.

Peking University의 360 Intelligent Brain Team과 공동 R & D 팀은 특히 Tiny-R1-32B-Preview의 성공이 오픈 소스 커뮤니티의 강력한 지원과 분리 할 수 없다고 강조했습니다. 이 모델은 DeepSeek-R1 증류 기술, DeepSeek-R1-Distill-32B 증분 교육 및 고급 모델 퓨전 기술로부터 완전히 이익을 얻습니다. 이러한 기술 성과의 축적은 모델 개발을위한 탄탄한 토대를 마련했습니다.

R & D 팀은 기술 포용성을 촉진하기 위해 자세한 기술 보고서, 교육 코드 및 일부 데이터 세트를 포함한 완전한 모델 창고를 공개 할 것을 약속합니다. 현재 모델 창고는 Hugging Face 플랫폼에서 공식적으로 출시되었으며 액세스 주소는 https://huggingface.co/qihoo360/tinyr1-32b-preview입니다. 이 공개 이니셔티브는 인공 지능 연구 커뮤니티에 귀중한 자원을 제공하고 관련 기술의 추가 개발을 촉진 할 것입니다.