2024年2月24日、人工知能の分野で重要なブレークスルーが行われました。 360 Intelligent Brain Team and Peking Universityが共同で開発した中規模の推論モデルTiny-R1-32B-Previewが正式にリリースされました。わずか5%のパラメーターボリュームで、この革新的なモデルは、DeepSeek-R1-671Bのフルヘルスパフォーマンスに成功し、効率的な推論分野の新しい可能性を開きます。

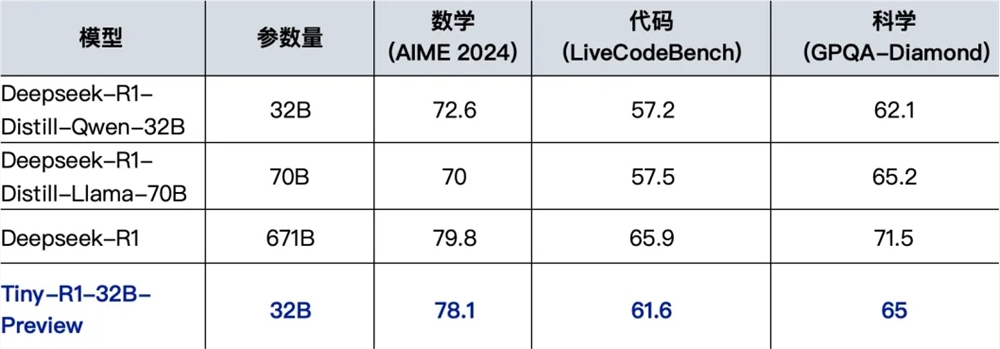

パフォーマンステストでは、Tiny-R1-32B-Previewが印象的なパフォーマンスを示しました。特に数学の分野では、このモデルはAIME2024レビューで78.1の優れたスコアを達成しました。これは、元のR1モデルの79.8スコアからわずか1.7ポイント離れており、DeepSeek-R1-Distill-Lalama-70Bの70.0スコアよりもかなり先を行っています。プログラミングと科学の分野では、モデルもうまく機能し、それぞれLiveCodebenchおよびGPQA-Diamondテストで61.6および65.0ポイントを達成し、現在の最高のオープンソース70Bモデルを上回りました。この一連の成果は、Tiny-R1-32B-Previewの優れたパフォーマンスを証明するだけでなく、推論コストを大幅に削減することで効率の大幅な改善を達成します。

この画期的な結果の背後には、研究チームの革新的な「分裂と収束統合」戦略があります。この戦略は、最初にDeepSeek-R1に基づいて大規模なフィールドデータを生成し、数学、プログラミング、科学の3つの垂直フィールドで専門モデルを訓練します。その後、研究チームはArceeチームのMergekitツールを使用してインテリジェントな統合を使用し、単一のモデルのパフォーマンス限界を克服し、マルチタスクのバランスの取れた最適化を達成しました。この革新的な技術的パスは、モデルの全体的なパフォーマンスを大幅に改善するだけでなく、推論モデルの将来の開発のための新しいアイデアと方向性を提供します。

360 Intelligent BrainチームとPeking Universityの共同R&Dチームは、Tiny-R1-32B-Previewの成功は、オープンソースコミュニティの強力なサポートと切り離せないことを強調しました。このモデルは、DeepSeek-R1蒸留テクノロジー、DeepSeek-R1-Distill-32B増分トレーニング、高度なモデル融合技術から完全に利益を得ています。これらの技術的成果の蓄積は、モデルの開発のための強固な基盤となっています。

テクノロジーの包括性を促進するために、R&Dチームは、詳細な技術レポート、トレーニングコード、一部のデータセットなど、完全なモデル倉庫を開示することを約束します。現在、モデルウェアハウスはハグのフェイスプラットフォームで正式に発売されており、アクセスアドレスはhttps://huggingface.co/qihoo360/tinyr1-32b-previewです。このオープンイニシアチブは、人工知能の研究コミュニティに貴重なリソースを提供し、関連技術のさらなる開発を促進します。