Google의 리서치 팀은 최근 획기적인 모델 인 Transnar를 발표했습니다. Transnar는 Transformer Architecture와 NER (Neural Algorithm Reseving) 기술을 영리하게 결합하여 복잡한 알고리즘 작업의 성능을 크게 향상시킵니다. 이 혁신은 알고리즘 추론에서 전통적인 변압기의 한계를 해결할뿐만 아니라 구조화 된 데이터를 처리하기위한 완전히 새로운 솔루션을 제공합니다.

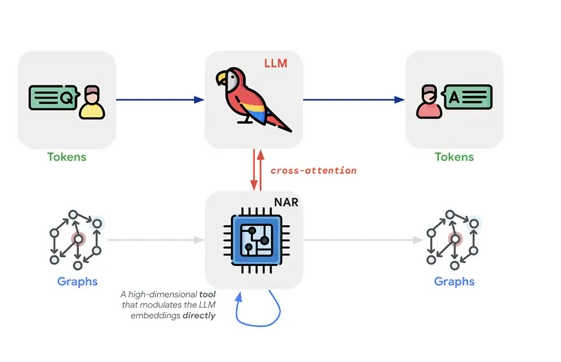

전통적인 변압기는 종종 알고리즘 문제를 해결할 때 구조화 된 데이터를 효과적으로 캡처 할 수 없다는 과제에 직면하지만, NAR 기술은 특히 일반화 기능에서 이와 관련하여 잘 수행됩니다. Transnar는 트랜스포머의 텍스트 처리 기능을 NAR의 그래프 표현 기능과 성공적으로 통합하여 상호주의 메커니즘을 도입합니다. 이 조합을 통해 모델은 텍스트 설명 및 그래프 구조 데이터를 동시에 처리 할 수 있으므로 알고리즘 추론 작업에서 전례없는 장점을 보여줍니다.

Transnar의 교육 전략도 독특합니다. 사전 훈련 단계에서 NAR 모듈은 독립적으로 훈련되며 여러 알고리즘 작업을 수행하여 고유 한 논리 및 계산 단계를 학습합니다. 이 프로세스는 모델에 대한 탄탄한 알고리즘 기반을 제시합니다. 미세 조정 단계에서 Transnar는 텍스트 설명 및 그래프 표현으로부터 듀얼 입력을 수신하고 사전 훈련 된 NAR 모듈이 제공하는 노드 임베딩 정보를 사용하여 교차-가지 메커니즘을 통해 자체 마크 임베딩을 동적으로 조정합니다. 이 다단계 교육 방법을 사용하면 모델이 복잡한 알고리즘 작업에 더 잘 적응할 수 있습니다.

실제 테스트에서 Transnar의 성능은 전통적인 변압기 모델의 성능, 특히 분포 외부의 일반화 기능에서 훨씬 뛰어 넘어 20%이상의 성능 향상을 보여줍니다. 이 성과는 모델의 강력한 기능을 확인할뿐만 아니라 더 넓은 범위의 알고리즘 작업에서 향후 적용을 강력하게 지원합니다.

핵심 사항 :

Google은 변압기와 NAR 기술을 결합하여 알고리즘 추론 기능을 크게 향상시키는 Transnar 모델을 시작했습니다.

transnar는 교차 분류 메커니즘을 채택하고 텍스트 처리 및 그래프 표현 기능을 깊이 통합하며 복잡한 알고리즘 작업에서 훌륭하게 수행합니다.

⭐ 다단계 교육 전략은 알고리즘 작업, 특히 일반화 기능에서 전통적인 변압기보다 Transnar가 상당히 향상시킵니다.