Googleの研究チームは最近、画期的なモデルであるTransNARをリリースしました。これは、変圧器アーキテクチャとニューラルアルゴリズムの推論(NAR)テクノロジーを巧みに組み合わせて、複雑なアルゴリズムタスクのパフォーマンスを大幅に向上させます。このイノベーションは、アルゴリズムの推論における従来の変圧器の制限を解決するだけでなく、構造化されたデータを処理するためのまったく新しいソリューションを提供します。

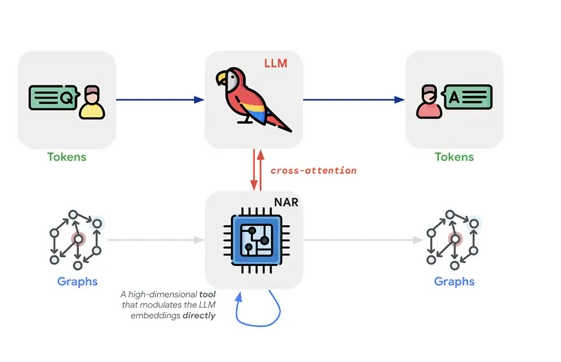

従来の変圧器は、アルゴリズムの問題に対処する際に構造化されたデータを効果的にキャプチャできないという課題に直面していることが多く、NARテクノロジーはこの点で、特に一般化能力ではうまく機能します。 TransNARは、交差に関するメカニズムを導入することにより、Transformerのテキスト処理機能とNARのグラフ表現機能を正常に統合します。この組み合わせにより、モデルはテキストの説明とグラフ構造データを同時に処理でき、アルゴリズム推論タスクの前例のない利点を示します。

Transnarのトレーニング戦略もユニークです。トレーニング前の段階では、NARモジュールは独立してトレーニングされ、複数のアルゴリズムタスクを実行することにより、固有のロジックおよび計算ステップを学習します。このプロセスは、モデルの強固なアルゴリズム基盤を置いています。微調整段階では、TransNARはテキストの説明とグラフ表現からデュアル入力を受け取り、事前に訓練されたNARモジュールが提供するノード埋め込み情報を使用して、クロスアテンションメカニズムを通じて独自のマーク埋め込みを動的に調整します。このマルチレベルのトレーニング方法により、モデルは複雑なアルゴリズムタスクによりよく適応することができます。

実際のテストでは、Transnarのパフォーマンスは従来のトランスモデルのパフォーマンスをはるかに上回り、特に分布外の一般化能力では20%以上のパフォーマンス改善が示されています。この成果は、モデルの強力な機能を検証するだけでなく、より広範なアルゴリズムタスクでの将来のアプリケーションを強力にサポートします。

キーポイント:

google GoogleはTransNARモデルを起動し、トランスとNARテクノロジーを組み合わせて、アルゴリズムの推論機能を大幅に改善しました。

cransnarは、クロスアテンションメカニズムを採用し、テキスト処理とグラフ表現機能を深く統合し、複雑なアルゴリズムタスクで優れた実行を実行します。

multialマルチレベルトレーニング戦略により、アルゴリズムタスク、特に一般化能力における従来の変圧器よりもトランスナーが大幅に優れています。