Copyright(c)2018 Nvidia Corporation。無断転載を禁じます。 CC by-nc-sa 4.0ライセンス(https://creativecommons.org/licenses/by-nc-sa/4.0/legalcode)に基づいてライセンスされています。

Caffeユーザーについては、caffe/readme.mdを参照してください。

Pytorchユーザーについては、pytorch/readme.mdを参照してください

Pytorchの実装は、Caffeの実装とほぼ一致しています(Sintelトレーニングセットの最終パスの平均EPE:2.31 Pytorchによる2.31、Caffeによる2.29)。

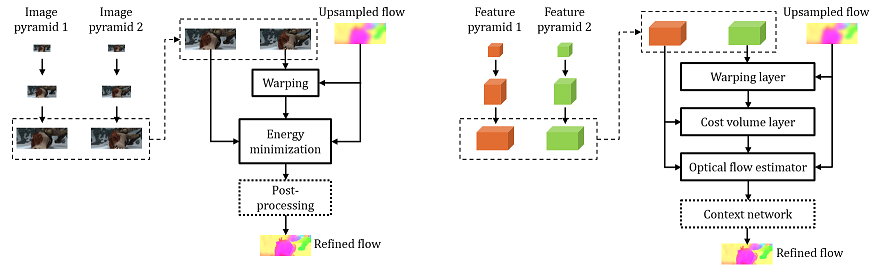

PWC-NETは、最先端の結果を達成するためのエンドツーエンドのトレーニング可能なディープニューラルネットワークで、画像ピラミッド、ワーピング、コストボリュームなど、いくつかの古典的な光学フロー推定技術を融合します。

Deqing Sun、Xiaodong Yang、Ming-Yu Liu、Jan Kautz。 「PWC-NET:ピラミッド、ワーピング、コストボリュームを使用した光学フローのCNNS」 CVPR 2018またはARXIV:1709.02371

更新および拡張バージョン:「モデルは重要です、トレーニングも重要です:光流量推定のためのCNNの経験的研究。」 Arxiv:1809.05571

プロジェクトページリンク

Robust Vision Challenge Workshopで話してください

CVPR 2018会議で話してください

PWC-NETを使用する場合は、次の論文を引用してください。

@InProceedings{Sun2018PWC-Net,

author = {Deqing Sun and Xiaodong Yang and Ming-Yu Liu and Jan Kautz},

title = {{PWC-Net}: {CNNs} for Optical Flow Using Pyramid, Warping, and Cost Volume},

booktitle = CVPR,

year = {2018},

}

またはarxiv紙

@article{sun2017pwc,

author={Sun, Deqing and Yang, Xiaodong and Liu, Ming-Yu and Kautz, Jan},

title={{PWC-Net}: {CNNs} for Optical Flow Using Pyramid, Warping, and Cost Volume},

journal={arXiv preprint arXiv:1709.02371},

year={2017}

}

または更新および拡張バージョン

@article{Sun2018:Model:Training:Flow,

author={Sun, Deqing and Yang, Xiaodong and Liu, Ming-Yu and Kautz, Jan},

title={Models Matter, So Does Training: An Empirical Study of CNNs for Optical Flow Estimation},

journal={IEEE Transactions on Pattern Analysis and Machine Intelligence (TPAMI)},

note = {to appear}

}

マルチフレームフローについては、引用してください

@inproceedings{ren2018fusion,

title={A Fusion Approach for Multi-Frame Optical Flow Estimation},

author={Ren, Zhile and Gallo, Orazio and Sun, Deqing and Yang, Ming-Hsuan and Sudderth, Erik B and Kautz, Jan},

booktitle={Proceedings of the IEEE Winter Conference on Applications of Computer Vision (WACV)},

year={2019}

}

Flownet2-Pytorch

3Dモーションフィールド推定のための移動カメラを使用した動的シーンでの剛性の学習(ECCV 2018)

deqing Sun([email protected])