Copyright (C) 2018 Nvidia Corporation. Tous droits réservés. Licencié sous la licence CC BY-NC-SA 4.0 (https://creativecommons.org/licenses/by-nc-sa/4.0/legalcode).

Pour les utilisateurs de Caffe, veuillez vous référer à Caffe / Readme.md.

Pour les utilisateurs de Pytorch, veuillez vous référer à Pytorch / Readme.md

L'implémentation de Pytorch correspond presque à la mise en œuvre de la CAFE (EPE moyen sur la passe finale de l'ensemble de formation SINTEL: 2,31 par Pytorch et 2,29 par Caffe).

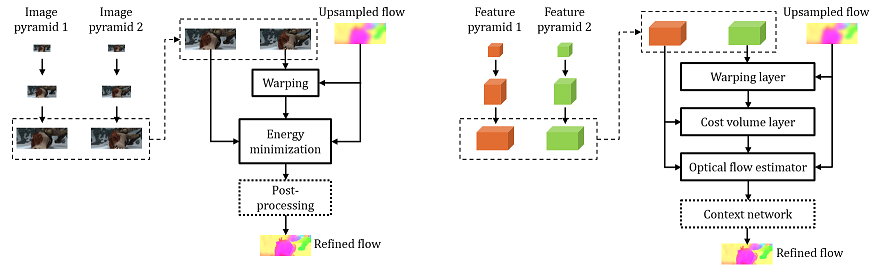

PWC-NET fusionne plusieurs techniques d'estimation de l'écoulement optique classiques, notamment la pyramide d'image, la déformation et le volume des coûts, dans des réseaux neuronaux profonds entraînant de bout en bout pour obtenir des résultats de pointe.

Deqing Sun, Xiaodong Yang, Ming-Yu Liu et Jan Kautz. "PWC-NET: CNNS pour le flux optique à l'aide de la pyramide, de la déformation et du volume des coûts." CVPR 2018 ou Arxiv: 1709.02371

Version mise à jour et étendue: "Les modèles comptent, la formation: une étude empirique des CNN pour l'estimation du flux optique." Arxiv: 1809.05571

Lien de page de projet

Talk at Robust Vision Challenge Workshop

Parler à la conférence CVPR 2018

Si vous utilisez PWC-NET, veuillez citer le document suivant:

@InProceedings{Sun2018PWC-Net,

author = {Deqing Sun and Xiaodong Yang and Ming-Yu Liu and Jan Kautz},

title = {{PWC-Net}: {CNNs} for Optical Flow Using Pyramid, Warping, and Cost Volume},

booktitle = CVPR,

year = {2018},

}

ou le papier arxiv

@article{sun2017pwc,

author={Sun, Deqing and Yang, Xiaodong and Liu, Ming-Yu and Kautz, Jan},

title={{PWC-Net}: {CNNs} for Optical Flow Using Pyramid, Warping, and Cost Volume},

journal={arXiv preprint arXiv:1709.02371},

year={2017}

}

ou la version mise à jour et étendue

@article{Sun2018:Model:Training:Flow,

author={Sun, Deqing and Yang, Xiaodong and Liu, Ming-Yu and Kautz, Jan},

title={Models Matter, So Does Training: An Empirical Study of CNNs for Optical Flow Estimation},

journal={IEEE Transactions on Pattern Analysis and Machine Intelligence (TPAMI)},

note = {to appear}

}

Pour le flux multi-châssis, veuillez également citer

@inproceedings{ren2018fusion,

title={A Fusion Approach for Multi-Frame Optical Flow Estimation},

author={Ren, Zhile and Gallo, Orazio and Sun, Deqing and Yang, Ming-Hsuan and Sudderth, Erik B and Kautz, Jan},

booktitle={Proceedings of the IEEE Winter Conference on Applications of Computer Vision (WACV)},

year={2019}

}

Flownet2-Pytorch

Rigidité d'apprentissage dans des scènes dynamiques avec une caméra en mouvement pour l'estimation du champ de mouvement 3D (ECCV 2018)

Deqing Sun ([email protected])