これは、論文の要約の公式リポジトリです。NICASSP2024で口頭発表のために受け入れられた検索されたオーディオキャプション。

[ Paper ] [ CLAP Checkpoints ] [ Weakly labeled captions for AudioSet, AudioCaps, and Clotho ]

注:CLAPチェックポイントは、このリポジトリで定義されているモデルとコードで使用することを目的としています。

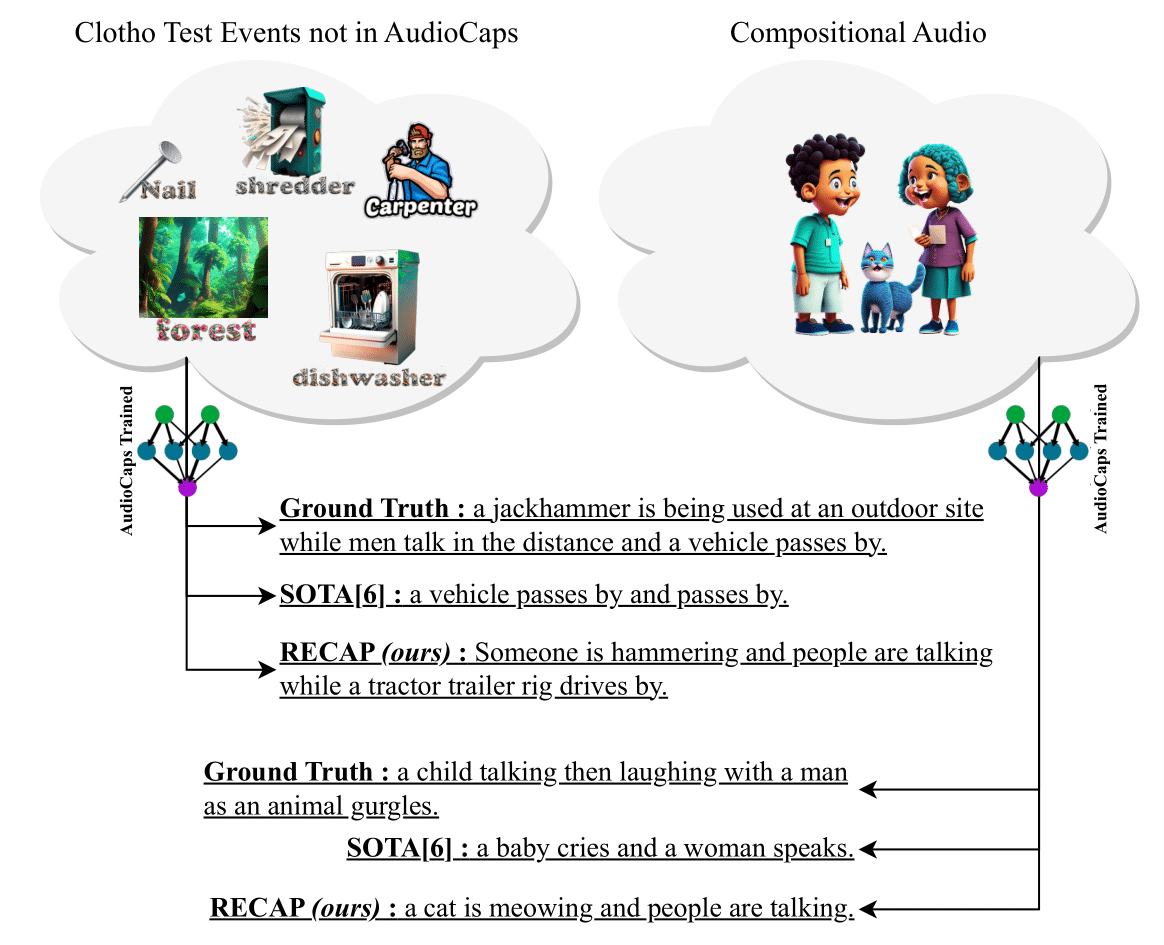

データストアから取得したオーディオと同様の入力オーディオやその他のキャプションに条件付けられたキャプションを生成する斬新で効果的なオーディオキャプションシステムである、概要(検索されたオーディオキャプション)を提示します。さらに、提案された方法は、追加の微調整を必要とせずに任意のドメインに転送できます。オーディオサンプルのキャプションを生成するために、オーディオテキストモデルCLAPを活用して、交換可能なデータストアから類似したキャプションを取得し、プロンプトの構築に使用します。次に、このプロンプトをGPT-2デコーダーに送り、CLAPエンコーダとGPT-2の間にクロスアテンション層を導入して、キャプション生成のオーディオを条件付けます。 2つのベンチマークデータセット、クロトー、オーディオカップでの実験は、要約がドメイン内の設定で競争力のあるパフォーマンスを達成し、ドメイン外の設定で大幅に改善することを示しています。さらに、トレーニングのないファッションで大規模なテキストキャプションのみのデータストアを活用する機能により、要約は、トレーニング中に見られなかった新しいオーディオイベントと複数のイベントを備えた構成オーディオのキャプションのユニークな機能を示しています。この分野での研究を促進するために、オーディオセット、オーディオキャップ、クロドーの150,000以上の新しい弱いラベル付きキャプションもリリースします。

pip install -r requirements.txt 。 Condaをインストールしている場合は、次のことを実行できます。 cd RECAP &&

conda create -n recap python=3.10 &&

conda activate recap &&

pip install -r requirements.txtbash recap.shリポジトリには、トレーニングコマンドと推論コマンドの両方があります。 1つずつ行うことをお勧めします。 python train.pyを実行してチェックポイントを保存したら、 python infer.pyのパスを更新し、トレーニングされたモデルを推測します。 --model_path 、チェックポイントが保存されている親フォルダーを指し、 --checkpoint_path使用するチェックポイントを指します(トレーニングコードは複数のチェックポイントを保存します。

CLAPチェックポイントをダウンロードしたら、CLAPを使用して評価に使用できます。

私たちのコードベースは、SmallCapに触発されています。著者が作品をオープンソーシングしてくれたことに感謝します。

@INPROCEEDINGS { 10448030 ,

author = { Ghosh, Sreyan and Kumar, Sonal and Reddy Evuru, Chandra Kiran and Duraiswami, Ramani and Manocha, Dinesh } ,

booktitle = { ICASSP 2024 - 2024 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP) } ,

title = { Recap: Retrieval-Augmented Audio Captioning } ,

year = { 2024 } ,

volume = { } ,

number = { } ,

pages = { 1161-1165 } ,

keywords = { Training;Signal processing;Benchmark testing;Acoustics;Decoding;Feeds;Speech processing;Automated audio captioning;multimodal learning;retrieval-augmented generation } ,

doi = { 10.1109/ICASSP48485.2024.10448030 } }