Der Prozess der Podcast -Synopsis -Generation erforderte traditionell Schöpfer, Produzenten und/oder Autoren, den Inhalt zu verstehen und die Synopse manuell zu schreiben, wodurch die herausragenden Punkte und Highlights einer Episode zusammengefasst werden. Dieser Ansatz ist zeitaufwändig und kann Brainstorming-Sitzungen beinhalten, die die Hauptthemen diskutieren und den Text verfeinern, bis er die Botschaft und den Ton des Podcasts effektiv vermittelt (z. B. in seinen Zusammenfassungen kann ein komödiantischer Podcast humorvoller Sprache oder Übertreibung aufweisen).

Dieses Repository zeigt, wie ein großer Teil dieses Handbuchs und zeitaufwändigen Prozesses mit dem Portfolio der von Azure Cognitive Services bereitgestellten Dienste automatisiert wird, insbesondere Azure-Sprachdienst und Azure OpenAI, um die Synopse , Sloglen , SEO-Keywords und Übersetzungen in mehrere Sprachen zu transkript und generieren. Die Einbeziehung von KI zur Automatisierung dieses Prozesses beseitigt weder die Rolle der menschlichen Kreativität noch die Bedeutung der menschlichen Beteiligung. Stattdessen ermöglicht es eine signifikante Beschleunigung in der Zeit zu Markt, indem die Kraft der KI nutzt. Die endgültige Validierung und Genehmigung des Inhalts bleibt die Verantwortung der menschlichen Spezialisten vor der Veröffentlichung.

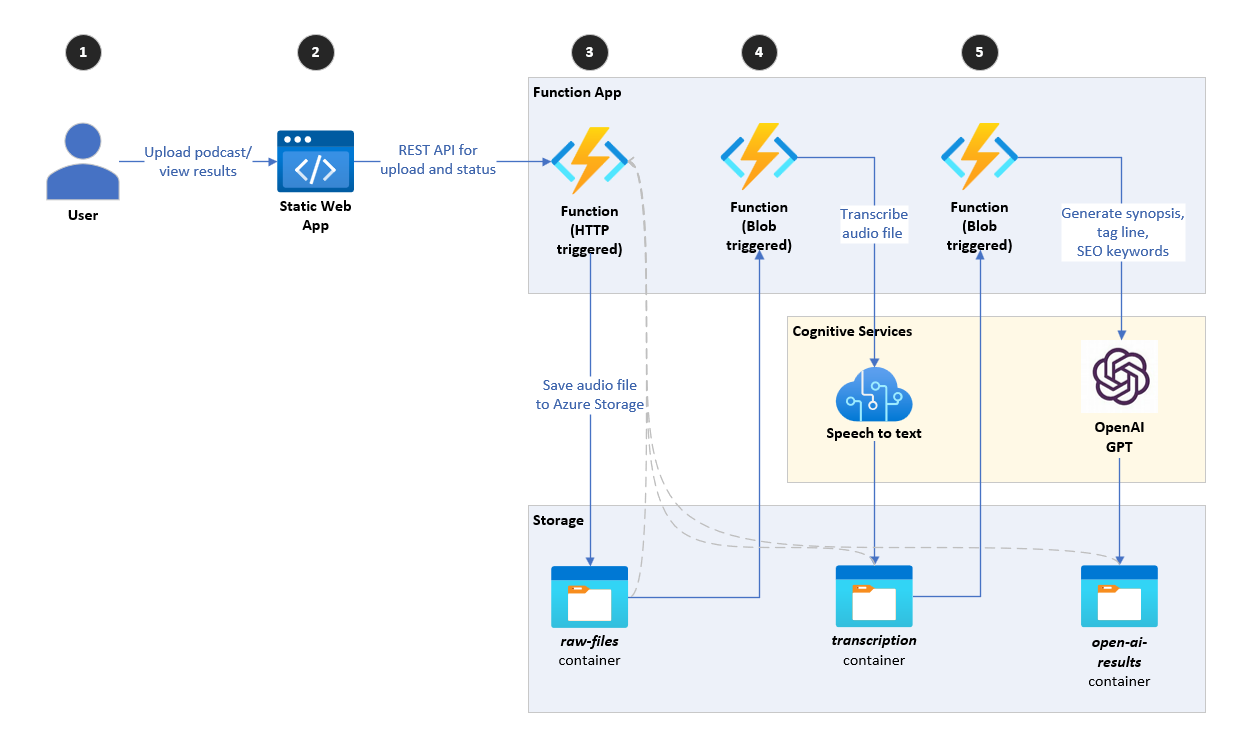

Dieses Repository implementiert eine hochrangige Architektur, die das Audio eines Podcasts (Schritte 1-3) übernimmt, das Audio mithilfe von Azure-Sprachdiensten (Schritt 4) in Text transkribiert und eine Synopse basierend auf der Transkription unter Verwendung von Azure OpenAI GPT-3.5 (Schritt 5) erzeugt. Beachten Sie, dass die Version des verwendeten GPT-Modells leicht auf GPT-4 oder zukünftige Versionen aufgerüstet werden kann.

Es besteht aus einer React -Web -App, mit der ein Benutzer eine Audio -Datei (Podcast) hochladen kann. Die App verwendet eine Azure-Funktion (WebAPIHTTPtrigger), um die Audiodatei in ein Speicherkonto, dh den raw-files -Container, hochzuladen.

Azure-Funktion (audioFileUploadedBlobtrigger) wird ausgelöst, wenn eine neue Datei zum raw-files -Container hinzugefügt wird. Die Funktion lädt die Audiodatei herunter und sendet sie an Azure -Sprachdienste und transkribiert das Audio in Text. Anschließend speichert es die Transkription auf demselben Speicherkonto, dh dem transcription .

Die letzte Azure -Funktion (TranscriptionFileUploadedBlobtrigger) wird ausgelöst, wenn der transcriptions neue Dateien hinzugefügt werden. Die Funktion lädt die Transkriptionsdatei herunter und sendet sie an vier verschiedene Azure OpenAI -Methoden, die die folgenden Funktionen ausführen:

Es speichert die Ergebnisse als separate Textdateien im Speicherkonto open-ai-results Container.

Dieses Projekt begrüßt Beiträge und Vorschläge. In den meisten Beiträgen müssen Sie einer Mitarbeiters Lizenzvereinbarung (CLA) zustimmen, in der Sie erklären, dass Sie das Recht haben und uns tatsächlich tun, um uns die Rechte zu gewähren, Ihren Beitrag zu verwenden. Weitere Informationen finden Sie unter https://cla.opensource.microsoft.com.

Um einen Beitrag zu leisten, erstellen Sie bitte ein selbst zugeordnetes Problem, indem Sie einen Überblick über das, was Sie möchten, einen Überblick über hochrangige Übersicht geben. Sobald eine Diskussion dort abgeschlossen ist, folgen Sie mit einem PR.

Dieses Projekt hat den Microsoft Open Source -Verhaltenscode übernommen. Weitere Informationen finden Sie im FAQ oder wenden Sie sich an [email protected] mit zusätzlichen Fragen oder Kommentaren.