Deepxde

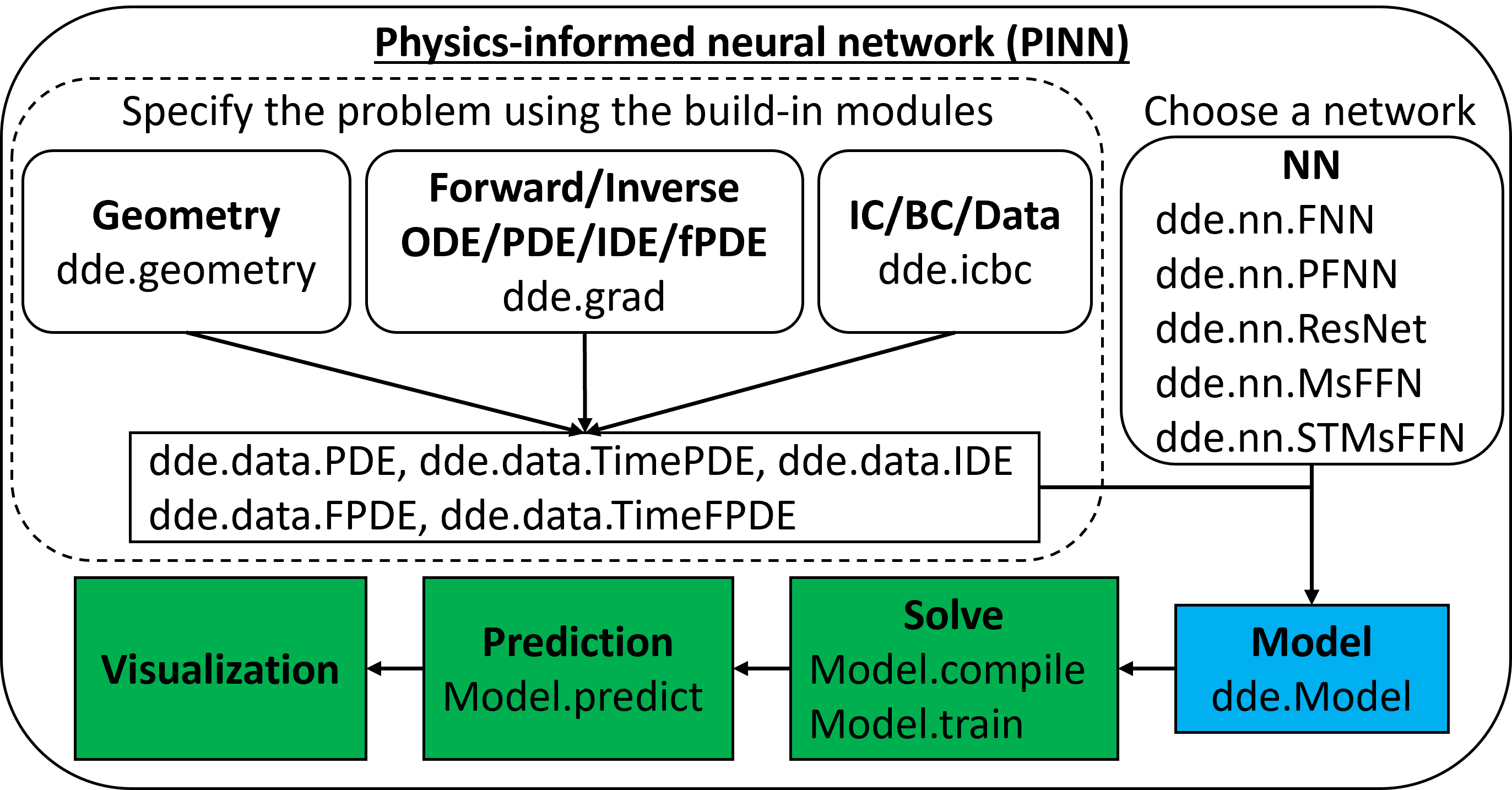

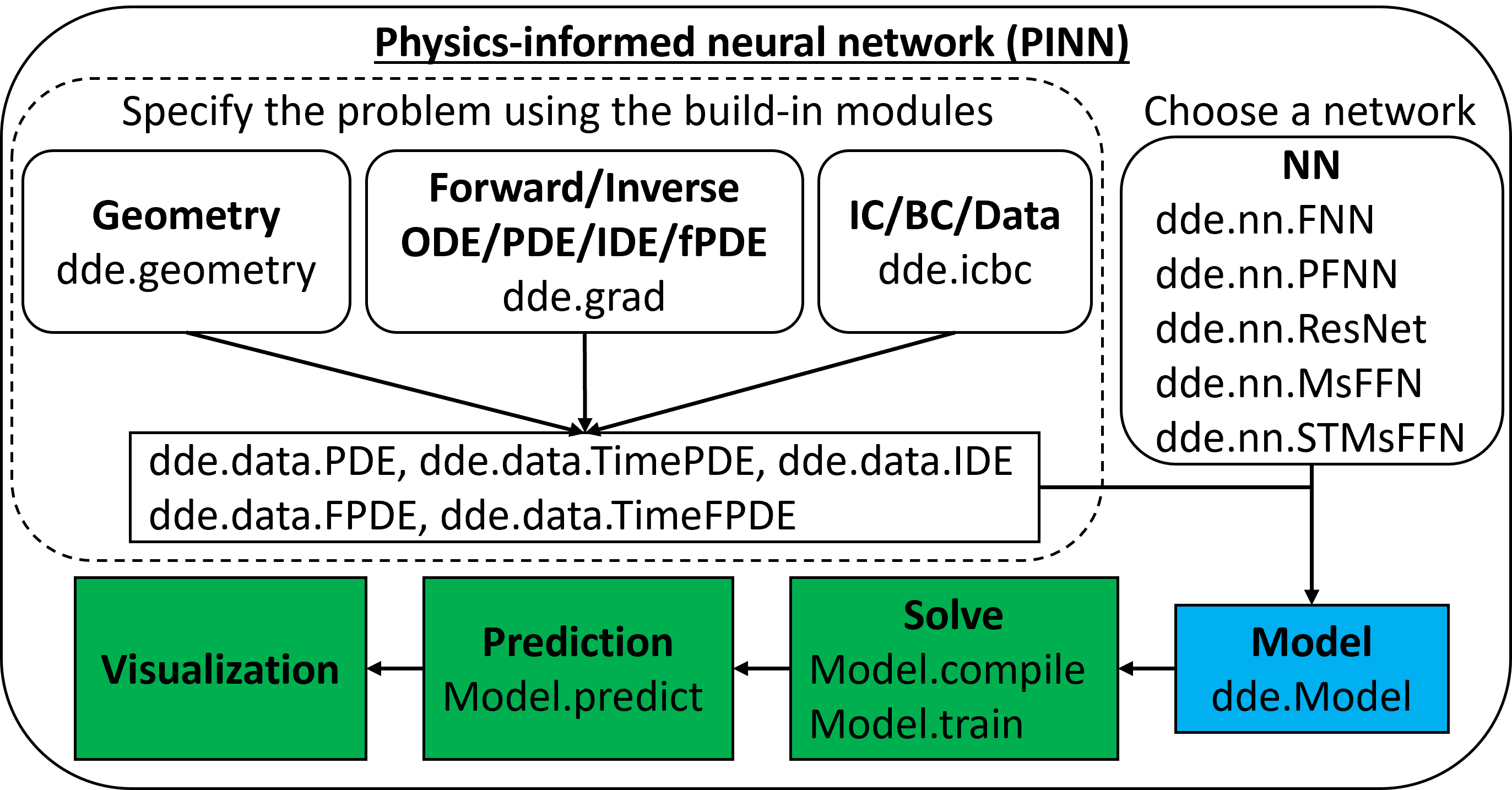

Deepxde هي مكتبة للتعلم الآلي العلمي والتعلم المستنير فيزياء. يتضمن Deepxde الخوارزميات التالية:

- الشبكة العصبية المستنيرة للفيزياء (PINN)

- حل مشاكل مختلفة

- حل المعادلات التفاضلية إلى الأمام/العكسية/الجزئية (ODES/PDEs) [Siam Rev.]

- حل المعادلات المتماثلة إلى الأمام/العكسية (IDES) [Siam Rev.]

- FPINN: حل PDEs forward/عكسية PDES (FPDES) [Siam J. Sci. حساب.]

- الفوضى متعددة الحدود المعجزة (NN-APC): حل PDEs للأمام/العكسي (SPDES) [J. حساب. Phys.]

- Pinn مع قيود صعبة (HPinn): حل التصميم العكسي/التحسين الطوبولوجيا [Siam J. Sci. حساب.]

- تحسين دقة بين

- أخذ العينات التكيفية المتبقية [Siam Rev. ، Comput. طرق Appl. الميكانيكية. المهندس.]

- Pinn المعزز بالدرجات (GPinn) [Comput. طرق Appl. الميكانيكية. المهندس.]

- Pinn مع ميزات فورييه متعددة النطاق [Comput. طرق Appl. الميكانيكية. المهندس.]

- الشرائح ، فيديو ، فيديو باللغة الصينية

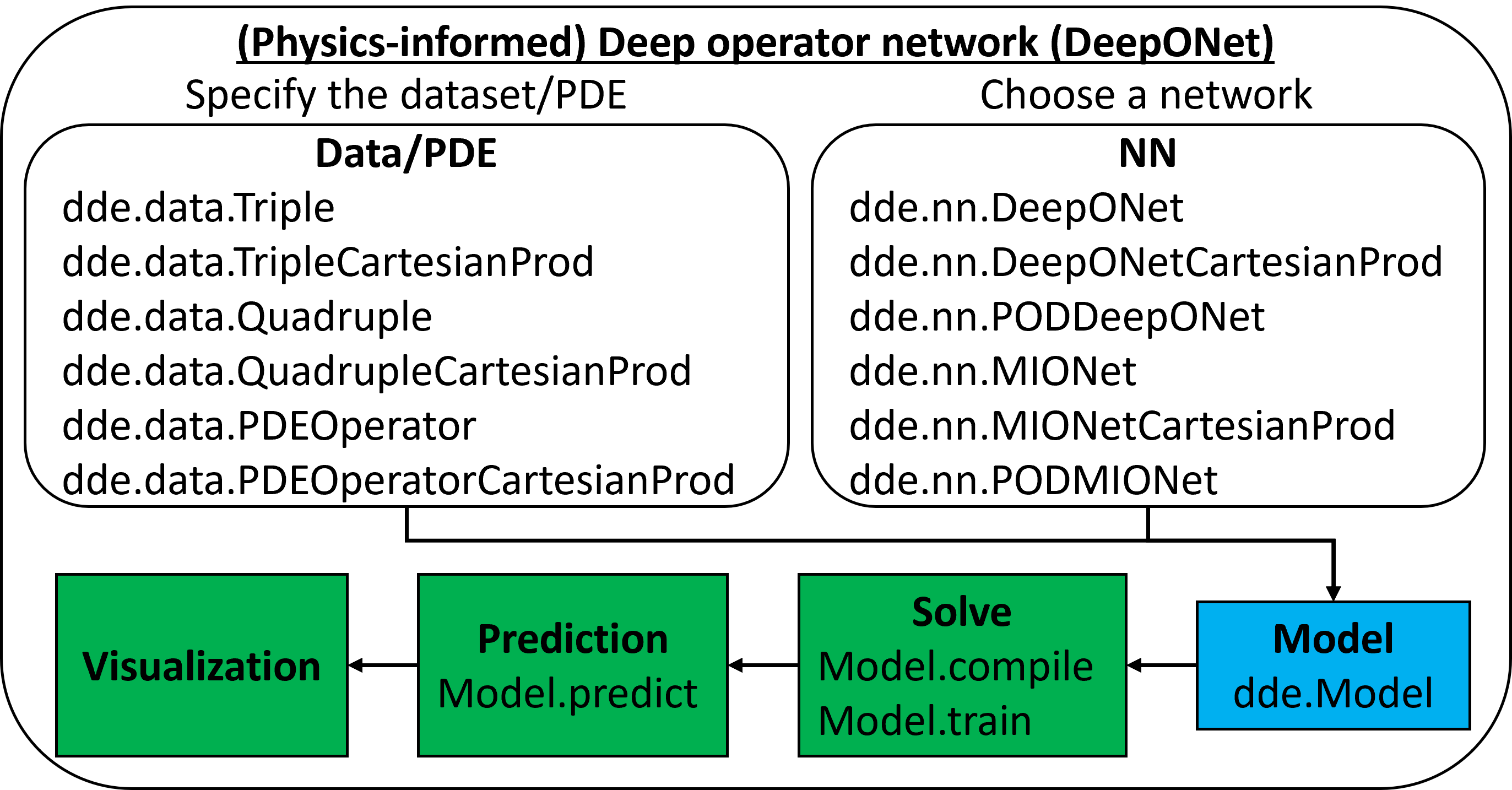

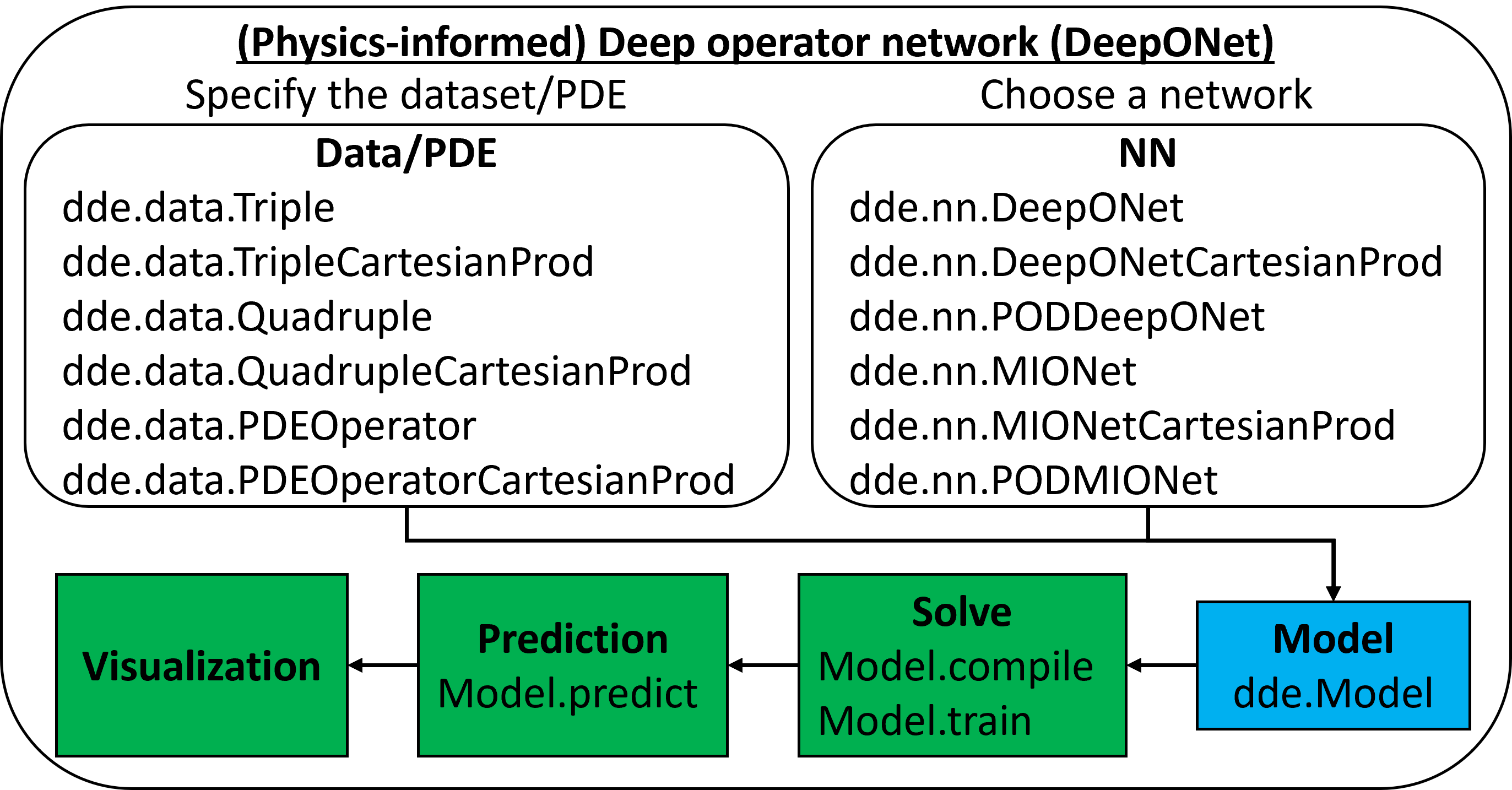

- (فيزياء مستنيرة) شبكة المشغل العميق (DeepOnet)

- DeepOnet: مشغلي التعلم [NAT. ماخ. العقل.]

- امتدادات DeepOnet ، على سبيل المثال ، pod-deeponet [Comput. طرق Appl. الميكانيكية. المهندس.]

- Mionet: تعلم مشغلي المدخلات المتعددة [Siam J. Sci. حساب.]

- فورييه دونيت [Comput. طرق Appl. الميكانيكية. المهندس] ، فورييه ميونيت [arxiv]

- ديبونيت المستنيرة فيزياء [SCI. adv.]

- multifidelity deeponet [Phys. القس البحوث]

- Deepm & Mnet: حل المشكلات متعددة الفيزياء والمشاكل المتعددة [J. حساب. Phys. ، J. Comput. Phys.]

- استقراء موثوق [Comput. طرق Appl. الميكانيكية. المهندس.]

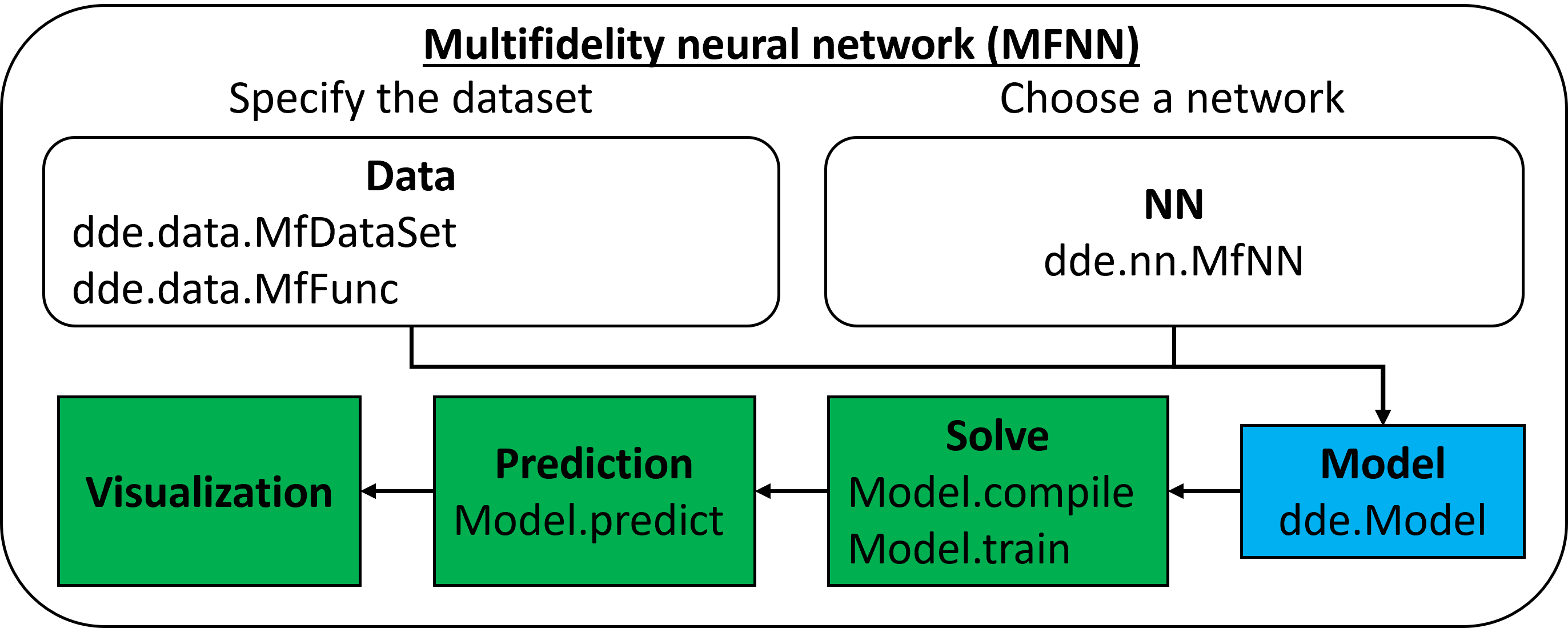

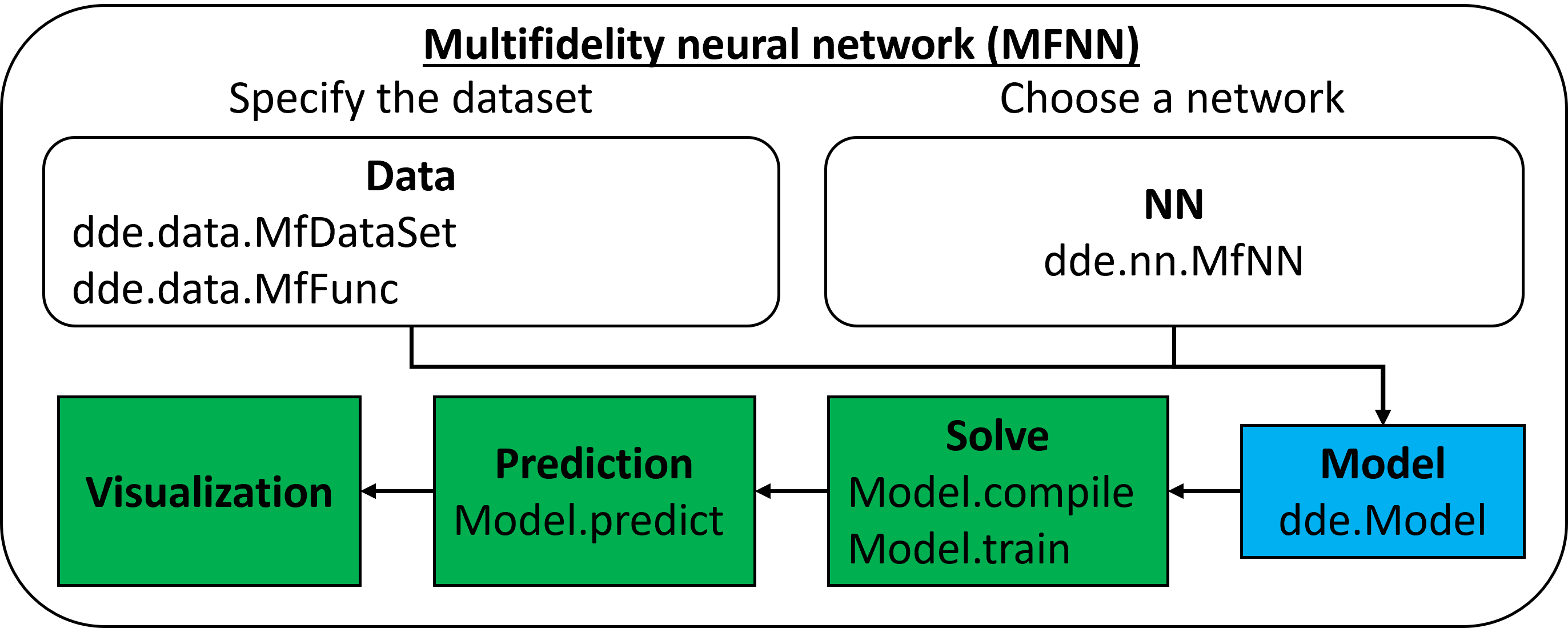

- الشبكة العصبية متعددة الأبعاد (MFNN)

- التعلم من بيانات متعددة الأبعاد [J. حساب. Phys. ، pnas]

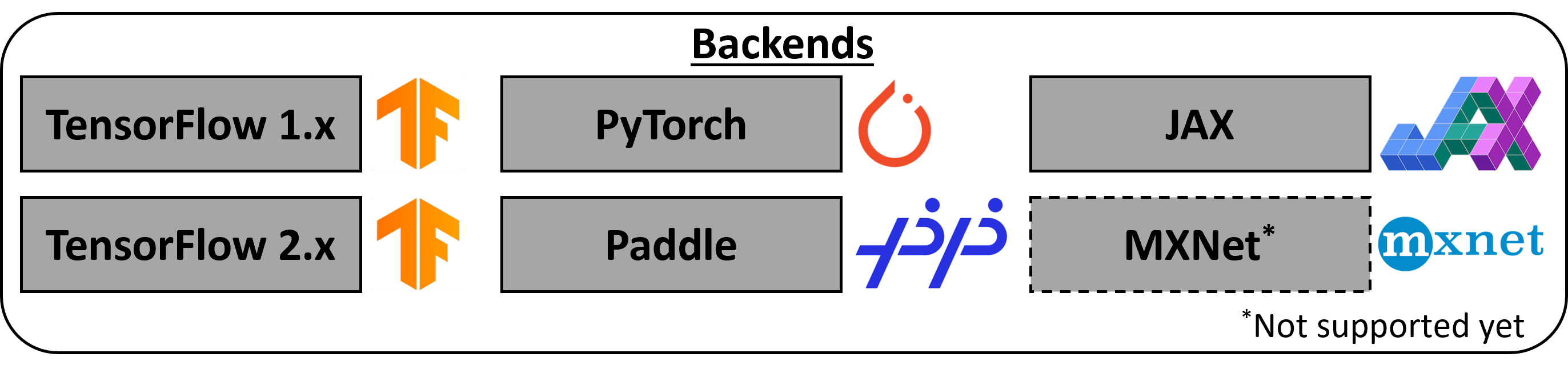

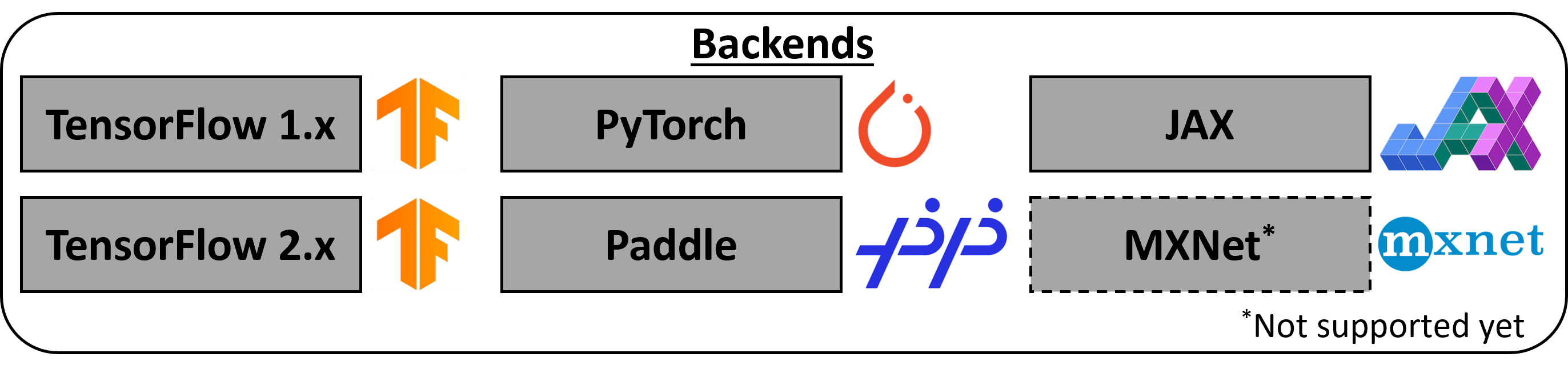

يدعم DeepXDE خمسة مكتبات الموترات كخلفية: TensorFlow 1.x ( tensorflow.compat.v1 في Tensorflow 2.x) ، Tensorflow 2.x ، Pytorch ، Jax ، و PaddlePaddle. لمعرفة كيفية اختيار واحدة ، راجع العمل مع الخلفية المختلفة.

الوثائق : ReadTheDocs

سمات

قام Deepxde بتنفيذ العديد من الخوارزميات كما هو موضح أعلاه ويدعم العديد من الميزات:

- يمكّن رمز المستخدم من أن يكون مضغوطًا ، ويشبه عن كثب التركيبة الرياضية.

- هندسة المجال المعقدة دون جيل شبكة الطغيان. الهندسة البدائية هي الفاصل الزمني ، مثلث ، مستطيل ، مضلع ، قرص ، القطع الناقص ، على شكل نجمة ، مكعب ، كرة ، فرط الكوب ، وفرط. يمكن إنشاء الهندسة الأخرى كهندسة صلبة بناءة (CSG) باستخدام ثلاث عمليات منطقية: الاتحاد ، والاختلاف ، والتقاطع. يدعم Deepxde أيضًا هندسة تمثلها سحابة نقطة.

- 5 أنواع من شروط الحدود (BCS): Dirichlet ، Neumann ، Robin ، دورية ، و BC عامة ، والتي يمكن تعريفها على مجال تعسفي أو على مجموعة نقاط ؛ ووظائف المسافة التقريبية للقيود الصعبة .

- 3 طرق التمايز التلقائي (AD) لحساب المشتقات: الوضع العكسي (IE ، backpropagation) ، الوضع الأمامي ، وتحول الإحداثيات الصفر (ZCS).

- الشبكات العصبية المختلفة: الشبكة العصبية المتصلة بالكامل (FNN) ، FNN المكدسة ، الشبكة العصبية المتبقية ، شبكات ميزات فورييه متعددة النطاق (المكانية الزمانية) ، إلخ.

- العديد من أساليب أخذ العينات : موحدة ، pseudorandom ، أخذ عينات من فرط الكوب اللاتينية ، تسلسل هالتون ، تسلسل هامرسلي ، وتسلسل سول. يمكن أن تحافظ نقاط التدريب على نفس الشيء أثناء التدريب أو إعادة تشكيلها (على نحو تكيفي) كل تكرارات معينة.

- 4 مسافات الوظائف : سلسلة الطاقة ، Chebyshev الحدود ، الحقل العشوائي الغاوسي (1D/2D).

- تدريب متوازي للبيانات على وحدات معالجة الرسومات المتعددة.

- مُحسّنات مختلفة: آدم ، L-BFGS ، إلخ.

- حفظ النموذج بشكل مناسب أثناء التدريب ، وتحميل نموذج مدرب.

- عروض عمليات الاسترداد لمراقبة الحالات الداخلية وإحصائيات النموذج أثناء التدريب: التوقف المبكر ، إلخ.

- عدم اليقين الكمي باستخدام التسرب.

- Float16 ، Float32 ، و Float64 .

- العديد من الميزات المفيدة الأخرى: خسائر مختلفة (مرجحة) ، جداول معدل التعلم ، المقاييس ، إلخ.

جميع مكونات Deepxde مقترنة بشكل فضفاض ، وبالتالي فإن Deepxde هي منظمة جيدة التنظيم وقابلة للتكوين. من السهل تخصيص Deepxde لتلبية مطالب جديدة.

تثبيت

يتطلب Deepxde أن يتم تثبيت واحدة من التبعيات التالية الخاصة بالواجهة الخلفية:

- TensorFlow 1.x: TensorFlow> = 2.7.0

- TensorFlow 2.x: TensorFlow> = 2.3.0 ، احتمال TensorFlow> = 0.11.0

- Pytorch: Pytorch> = 1.9.0

- Jax: Jax ، Flax ، Optax

- Paddlepaddle: Paddlepaddle> = 2.6.0

ثم ، يمكنك تثبيت Deepxde نفسها.

- قم بتثبيت الإصدار المستقر مع

pip :

- قم بتثبيت الإصدار المستقر مع

conda :

$ conda install -c conda-forge deepxde

- للمطورين ، يجب عليك استنساخ المجلد إلى جهازك المحلي ووضعه مع برامج النصوص الخاصة بك.

$ git clone https://github.com/lululxvi/deepxde.git

استكشف المزيد

- تثبيت وإعداد

- عروض تقارب الوظيفة

- عروض تجريبية للمشاكل الآجلة

- عروض تجريبية للمشاكل العكسية

- عروض التوضيح لتعلم المشغل

- التعليمات

- تستخدم الأوراق البحثية Deepxde

- API

استشهد Deepxde

إذا كنت تستخدم Deepxde للبحث الأكاديمي ، فيتم تشجيعك على الاستشهاد بالورقة التالية:

@article{lu2021deepxde,

author = {Lu, Lu and Meng, Xuhui and Mao, Zhiping and Karniadakis, George Em},

title = {{DeepXDE}: A deep learning library for solving differential equations},

journal = {SIAM Review},

volume = {63},

number = {1},

pages = {208-228},

year = {2021},

doi = {10.1137/19M1274067}

}

المساهمة في Deepxde

أولا ، شكرا لأخذ الوقت للمساهمة!

- الإبلاغ عن الأخطاء. للإبلاغ عن خطأ ، ببساطة فتح مشكلة في قضايا GitHub.

- اقتراح تحسينات. لتقديم اقتراح تعزيز لـ DeepXDE ، بما في ذلك الميزات الجديدة تمامًا والتحسينات الطفيفة في الوظائف الحالية ، أخبرنا عن طريق فتح مشكلة في قضايا GitHub.

- طلبات سحب. إذا قمت بإجراء تحسينات على Deepxde ، أو إصلاح الخلل ، أو كان لديك مثال جديد ، فلا تتردد في إرسال طلب سحب لنا.

- طرح الأسئلة. للحصول على مساعدة حول كيفية استخدام Deepxde أو وظائفها ، يمكنك فتح مناقشة في مناقشات GitHub.

- الإجابة على الأسئلة. إذا كنت تعرف الإجابة على أي سؤال في المناقشات ، فأنت مرحب بك للإجابة.

الركود. يستضيف Deepxde Slack جمهورًا أساسيًا من مستخدمي ومطوري DeepXDE المتوسطة للدردشة العامة ، والمناقشات عبر الإنترنت ، والتعاون ، وما إلى ذلك إذا كنت بحاجة إلى دعوة الركود ، فيرجى إرسال بريد إلكتروني إلي.

الفريق

تم تطوير Deepxde بواسطة Lu Lu تحت إشراف البروفيسور جورج Karniadakis في جامعة براون من صيف من 2018 إلى 2020. كان Deepxde مستضيفًا ذاتيًا في Subversion في جامعة براون ، تحت اسم SciConet (الشبكات العصبية الحاسوبية العلمية). في 7 فبراير 2019 ، تم نقل SciConet من التخريب إلى Github ، الذي تم تسميته إلى Deepxde.

يتم الحفاظ على Deepxde حاليًا من قبل لو لو في جامعة ييل مع مساهمات رئيسية تأتي من العديد من الأفراد الموهوبين بأشكال ووسائل مختلفة. يجب ذكر قائمة غير شاملة ولكنها متزايدة: بول Escapil-Inchauspé ، زونغرين زو ، جيالين لي ، سارانش شوبرا ، سينسين ، فلاديمير دودينكوف ، أنران جياو ، تشونغي جيانغ ، شونيوان ماو.

رخصة

LGPL-2.1 ترخيص