DriveLM

1.0.0

Drivelm:與G Raph V iSual Q Uestion一起駕駛

Autonomous Driving Challenge 2024駕駛語言排行榜。

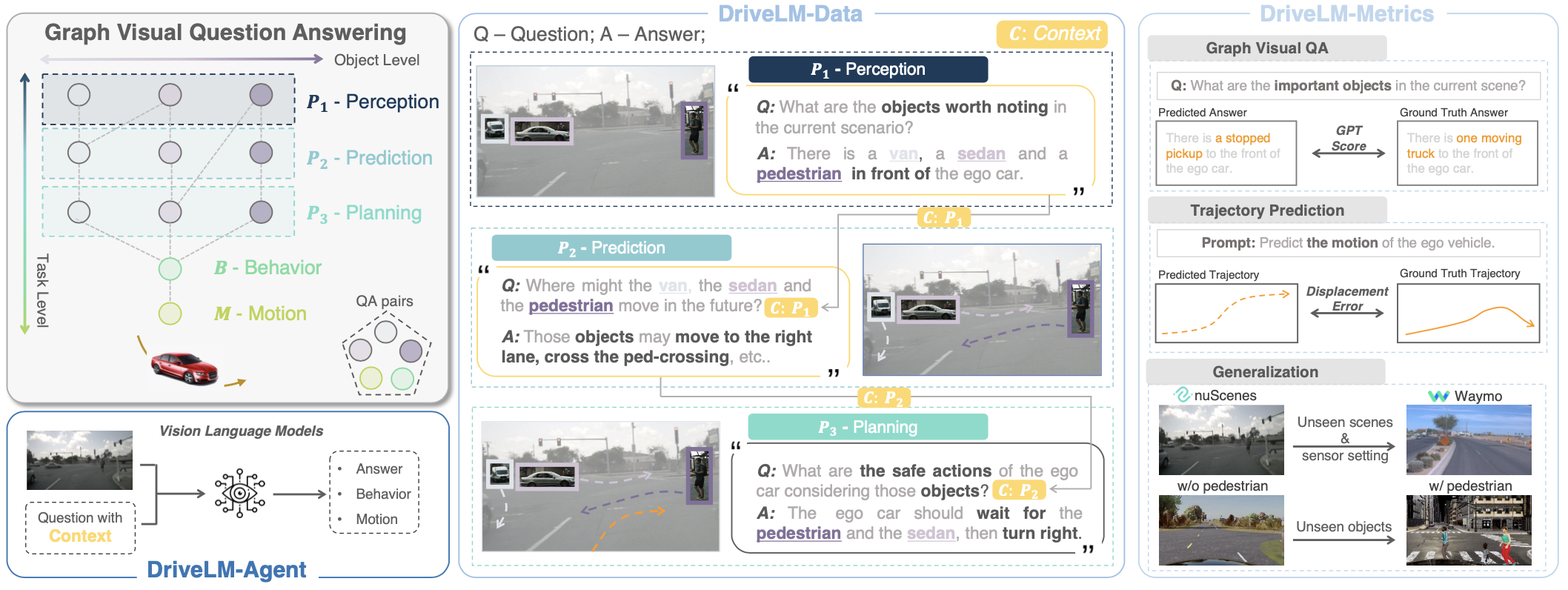

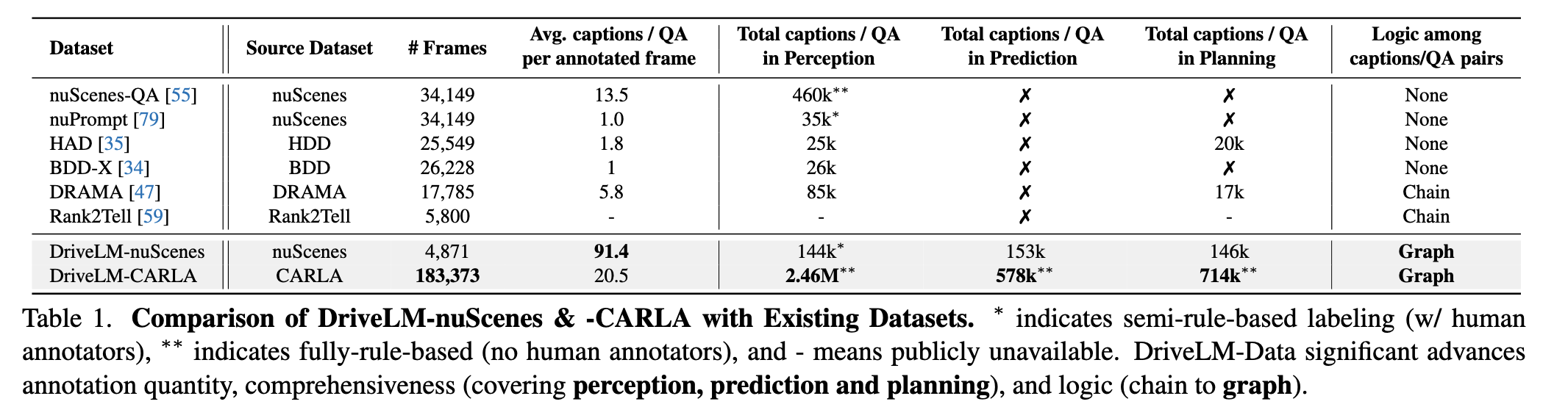

我們實例化基於Nuscenes和Carla建立的數據集( Drivelm-Data ),並提出了一種基於VLM的基線方法( DRIVELM-ENGENT ),用於共同執行Graph VQA和端到端駕駛。

? Drivelm是CVPR 2024 Autonomous Driving Challenge的主要軌道。挑戰所需的一切都在這裡,包括基線,測試數據和提交格式和評估管道!

[2025/01/08] Drive-Bench釋放! Drivelm的深入分析真正的基準測試。看看Arxiv。[2024/07/16] Drivelm官方排行榜重新打開![2024/07/01] Drivelm被ECCV 2024接受了!恭喜團隊![2024/06/01]挑戰最終出現了!請參閱最終排行榜。[2024/03/25]挑戰測試服務器在線,測試問題已發布。 chekc吧![2024/02/29]挑戰回購發布。基線,數據和提交格式,評估管道。看看![2023/08/25] Drivelm-nuscenes Demo發布。[2023/12/22] Drivelm-nuscenes Full v1.0和紙張發布。 開始使用Drivelm:

(返回到頂部)

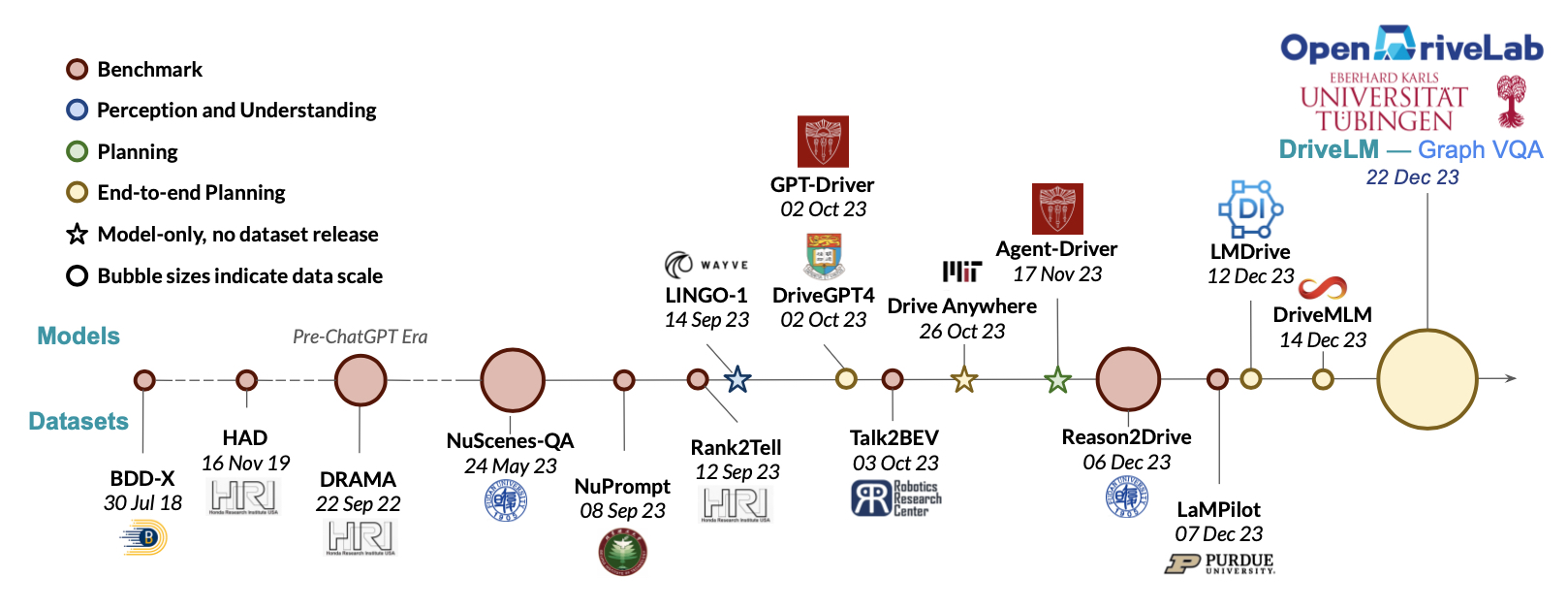

- GPT風格的多模型在現實世界應用中的出現激發了語言在駕駛中的作用的研究。

- 下面的日期反映了ARXIV提交日期。

- 如果缺少工作,請與我們聯繫!

Drivelm試圖解決社區面臨的一些挑戰。

(返回到頂部)

(返回到頂部)

我們促進了以人為編寫的推理邏輯作為它們之間的聯繫Perception, Prediction, Planning, Behavior, Motion任務。我們在Drivelm-Data上提出了GVQA的任務。

drivelm -data是第一語言驅動數據集,可促進具有圖形結構化邏輯依賴性的全部駕駛任務堆棧。

鏈接到有關GVQA任務,數據集功能和註釋的詳細信息。

(返回到頂部)

除非另有說明,否則此存儲庫中的所有資產和代碼均在Apache 2.0許可下。語言數據在CC BY-NC-SA 4.0下。其他數據集(包括Nuscenes)繼承了自己的分銷許可。如果我們的論文和項目幫助您的研究,請考慮考慮。

@article { sima2023drivelm ,

title = { DriveLM: Driving with Graph Visual Question Answering } ,

author = { Sima, Chonghao and Renz, Katrin and Chitta, Kashyap and Chen, Li and Zhang, Hanxue and Xie, Chengen and Luo, Ping and Geiger, Andreas and Li, Hongyang } ,

journal = { arXiv preprint arXiv:2312.14150 } ,

year = { 2023 }

} @misc { contributors2023drivelmrepo ,

title = { DriveLM: Driving with Graph Visual Question Answering } ,

author = { DriveLM contributors } ,

howpublished = { url{https://github.com/OpenDriveLab/DriveLM} } ,

year = { 2023 }

}(返回到頂部)

opendrivelab

自主視力小組

(返回到頂部)