Treibstoff: Fahren mit G -Raph v Iual Q uestion a nwering

Autonomous Driving Challenge 2024 Fahren mit der Sprache .

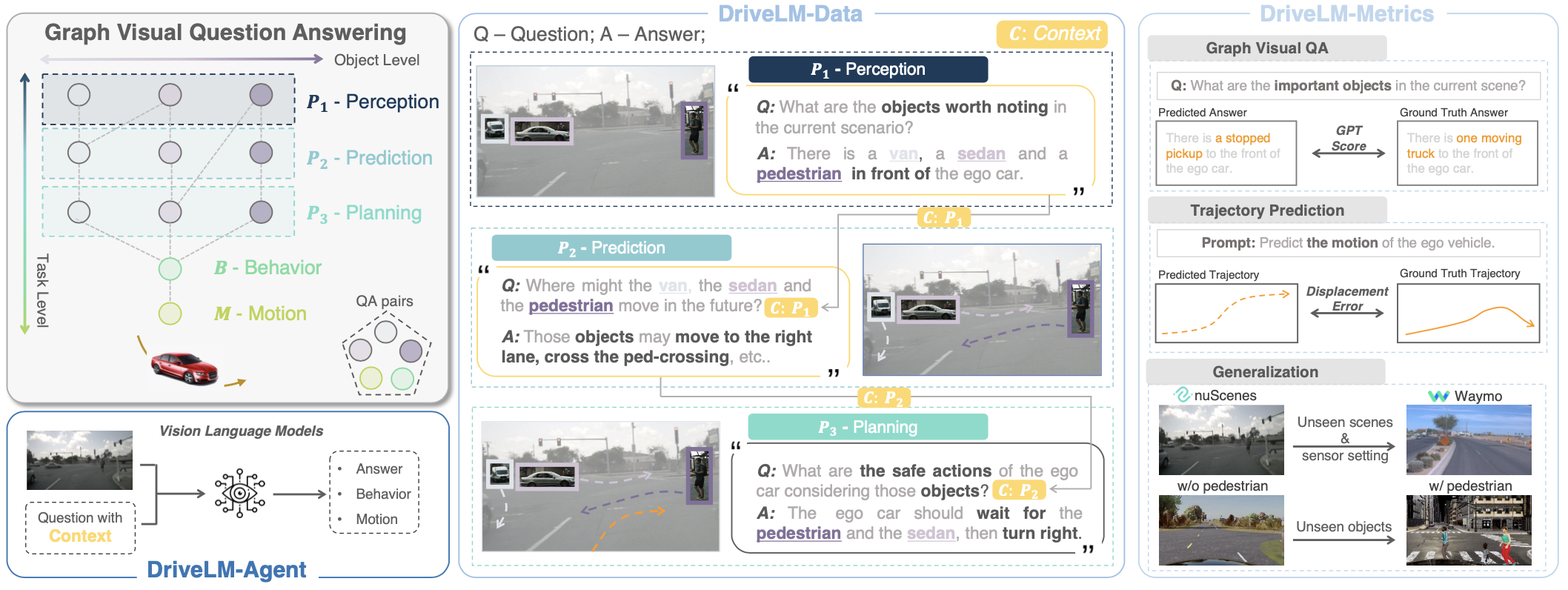

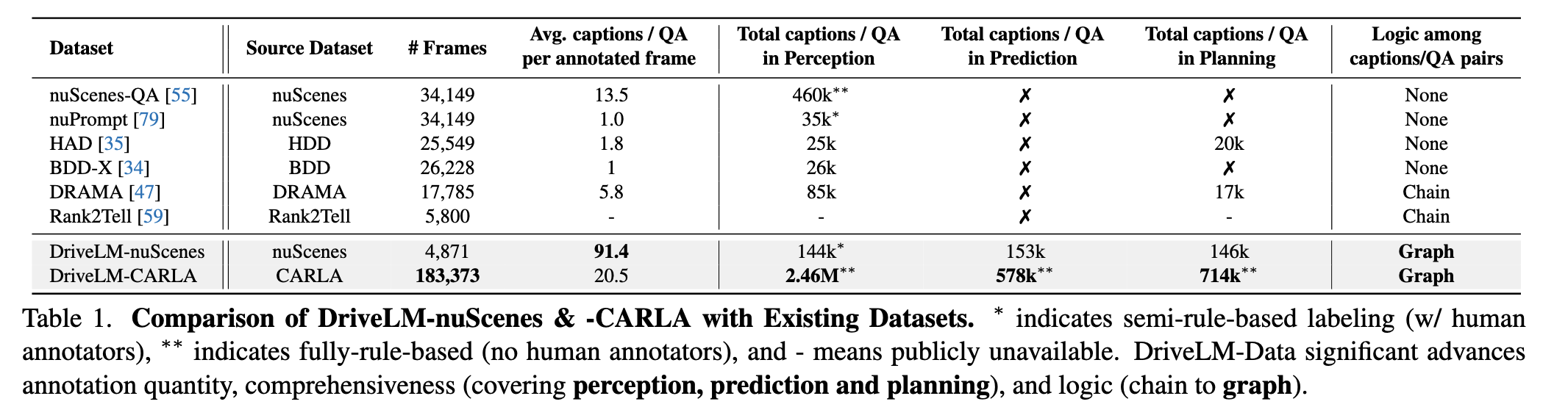

Wir instanziieren Datensätze ( TRAVILM-DATA ), die auf NuScenen und Carla basieren, und schlagen einen VLM-basierten Basisansatz ( TRAVILM-Agent ) für die gemeinsame Durchführung von Graph VQA und End-to-End-Fahren vor.

? Drachselement dient als Hauptstrecke in der CVPR 2024 Autonomous Driving Challenge . Alles, was Sie für die Herausforderung benötigen, ist hier, einschließlich Basis-, Testdaten- und Einreichungsformat und Bewertungspipeline!

[2025/01/08] Auffahrt-Bench-Veröffentlichung! Eingehende Analyse in dem Treibstoff wirklich Benchmarking. Schauen Sie sich Arxiv an.[2024/07/16] Official Official Rangloungboard Reöffnung![2024/07/01] TRAVERME wurde an ECCV 2024 aufgenommen! Herzlichen Glückwunsch an das Team![2024/06/01] Die Herausforderung endete! Siehe die letzte Rangliste.[2024/03/25] Challenge Test Server ist online und die Testfragen werden veröffentlicht. Chekc It Out![2024/02/29] Herausforderung Repo Release. Basis-, Daten- und Einreichungsformat, Bewertungspipeline. Schauen Sie sich an![2023/08/25] Die Demo der Dreh- und Angelpunkt-Nuscenes veröffentlicht.[2023/12/22] TRAVERM-NUSCENES Full v1.0 und Papier veröffentlicht. Um mit einem treiber zu beginnen:

(zurück nach oben)

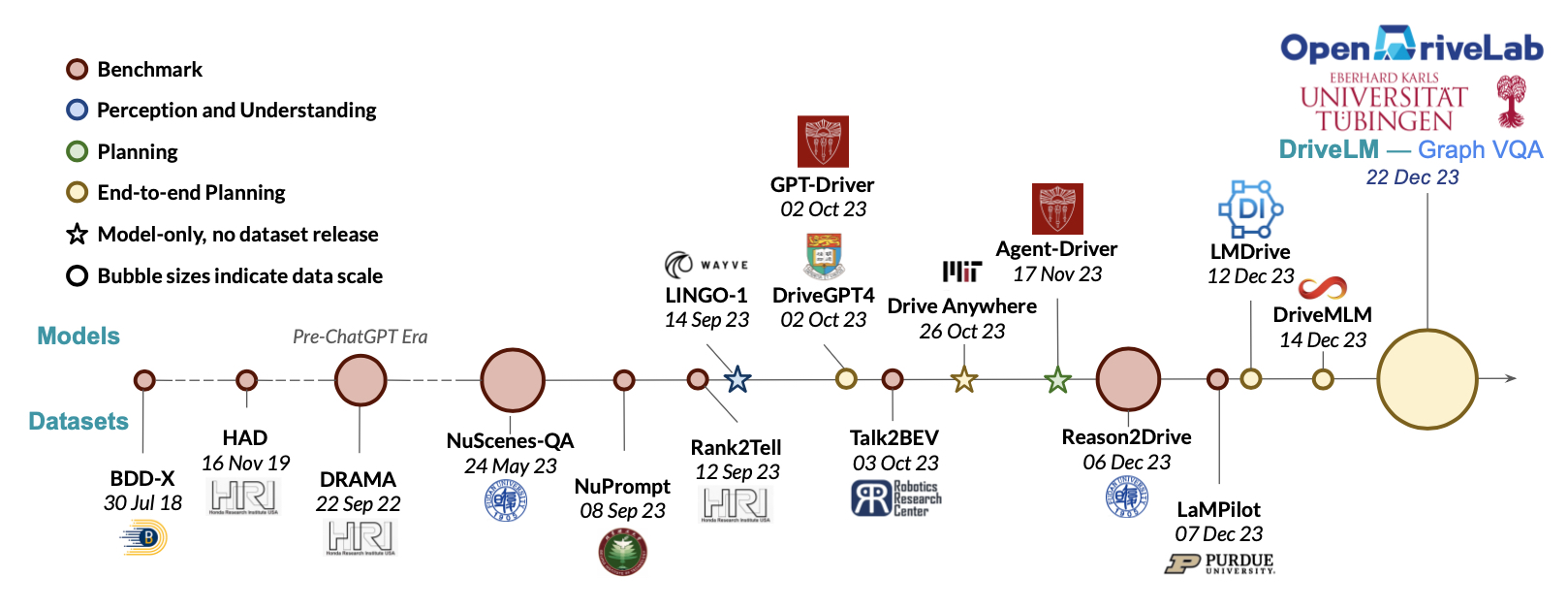

- Das Aufkommen von multimodalen Modellen im GPT-Stil in realen Anwendungen motiviert die Untersuchung der Rolle der Sprache beim Fahren.

- Das folgende Datum spiegelt das Arxiv -Einreichungsdatum wider.

- Wenn es fehlende Arbeit gibt, wenden Sie sich bitte an uns!

Drehkristallversuche, um einige der Herausforderungen der Gemeinschaft zu begegnen.

(zurück nach oben)

(zurück nach oben)

Wir erleichtern die Perception, Prediction, Planning, Behavior, Motion mit menschlich geschriebener Argumentationslogik als Verbindung zwischen ihnen. Wir schlagen die Aufgabe von GVQA auf der Treibstoffdaten vor.

TreVerm-Data ist der erste Sprachantriebsdatensatz, der den vollständigen Stapel von Fahraufgaben mit graphgestrukturierten logischen Abhängigkeiten erleichtert.

Links zu Details zu GVQA -Task, Datensatzfunktionen und Annotation.

(zurück nach oben)

Alle Vermögenswerte und Code in diesem Repository befinden sich unter der Apache 2.0 -Lizenz, sofern nicht anders angegeben. Die Sprachdaten erfolgen unter CC BY-NC-SA 4.0. Andere Datensätze (einschließlich NuScene) erben ihre eigenen Verteilungslizenzen. Bitte erwägen Sie, unser Papier und unser Projekt zu zitieren, wenn sie Ihre Recherche helfen.

@article { sima2023drivelm ,

title = { DriveLM: Driving with Graph Visual Question Answering } ,

author = { Sima, Chonghao and Renz, Katrin and Chitta, Kashyap and Chen, Li and Zhang, Hanxue and Xie, Chengen and Luo, Ping and Geiger, Andreas and Li, Hongyang } ,

journal = { arXiv preprint arXiv:2312.14150 } ,

year = { 2023 }

} @misc { contributors2023drivelmrepo ,

title = { DriveLM: Driving with Graph Visual Question Answering } ,

author = { DriveLM contributors } ,

howpublished = { url{https://github.com/OpenDriveLab/DriveLM} } ,

year = { 2023 }

}(zurück nach oben)

Opendrivelab

Autonome Vision Group

(zurück nach oben)