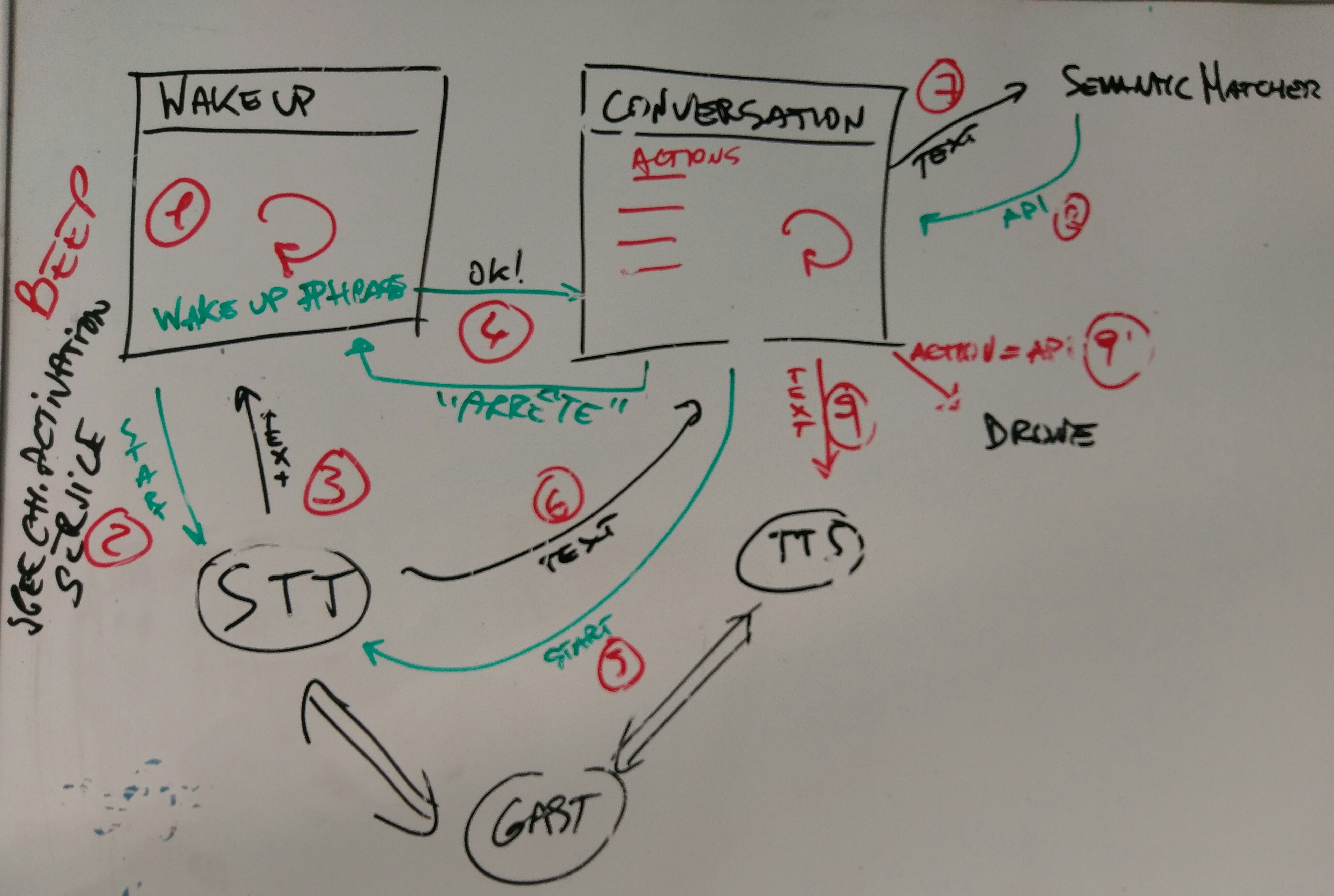

เล่นกับคำพูดของ Android เป็นข้อความและข้อความถึงคำพูด; การตั้งค่าคำปลุกนอกเหนือจาก ok google และพยายามจับคู่ข้อความที่แปลงเป็น ontology ที่ได้รับ

หนึ่งในลูกค้าของเราต้องการผู้ช่วยเสมือนจริงมือฟรีในการจัดการคำสั่งซื้อเช่น 'ส่ง Product-X Product-X ในสัปดาห์หน้า', 'ส่งเช่นเดียวกับสัปดาห์ที่แล้ว' หรือ 'ของฉัน?!' ชนิดของ Amazon Echo หรือ Google Home

ความคิดของเราคือการสร้างวัตถุที่พิมพ์ 3 มิติซึ่งจะซ่อน Raspberry Pi ไว้ข้างในซึ่งจะจัดการกับการโต้ตอบด้วยเสียงและในที่สุดก็โทรไปที่บริการ CRM หรืออะไรก็ตามจากนั้นแปลข้อความเพื่อพูดอีกครั้ง

ในฐานะที่เป็นต้นแบบแรกเราได้ตั้งค่าแอพ Android ที่จะทำสิ่งเหล่านี้ทั้งหมดเนื่องจาก API ของ Android ให้ทั้งคำพูดเพื่อส่งข้อความถึงการพูดออกจากกล่องมีลำโพงและไมโครโฟนรวมอยู่แล้วและเราไม่จำเป็นต้องจัดการกับฮาร์ดแวร์ตั้งแต่เริ่มต้น

ดังนั้นเราได้สร้างแอพ Android ซึ่งมี 2 ขั้นตอน/การกระทำ/หน้าจอ: อันดับแรกตัวรับสัญญาณ Wake-Up-Word (A LA "OK Google") และที่สองตัวรับสัญญาณคำสั่งที่ตรงกับข้อความที่ได้รับการยอมรับกับชุดของการกระทำที่กำหนด

สำหรับต้นแบบขนาดเล็กของเราเราได้ออกเดินทางเพื่อส่งคำสั่งไปยังเสียงพึมพำเล็ก ๆ ในรูปแบบของ "เฮ้หุ่นยนต์ -> กระโดดไกล!/ก้าวไปข้างหน้าเล็กน้อย/เลี้ยวขวาแล้วหมุน!"

การกระทำถูกกำหนดผ่านไฟล์ ontology ที่สร้างขึ้นผ่านโครงการ ontology ของ Stanford 'Protege'

เมื่อข้อความได้รับการยอมรับผ่าน API คำพูดของ Android เรา (โดยพื้นฐานมาก) ค้นหาการกระทำใน ontology ซึ่งจะตอบกลับด้วยวิธี API จากนั้นวิธีการ API จะถูกดำเนินการและการใช้งานในปัจจุบันของเราทำให้เสียงพึมพำของเราเคลื่อนไหวไปรอบ ๆ !

มีหลายสิ่งที่เราอยากทำ: