Brincando com o discurso para texto e texto para fala do Android; Configurando uma palavra de alerta além do OK Google e tentando combinar o texto convertido a uma determinada ontologia

Bem, um de nossos clientes queria uma mão de assistente virtual livre para lidar com ordens como 'Envie-me um monte de Product-X na próxima semana', 'Envie o mesmo que na semana passada' ou 'Onde minhas coisas?!' Como o Amazon's Echo ou o Google Home

Nossa idéia era criar um objeto impresso em 3D que ocultaria um Raspberry Pi dentro de quem lidaria com as interações de voz e, eventualmente, fazia chamadas para serviços de CRM ou o que quer que seja e depois re-traduzisse o texto para a fala.

Como primeiro protótipo, configuramos um aplicativo Android que faria tudo isso, dado que a API do Android fornece a fala para enviar um texto para falar fora da caixa, há um alto -falante e um microfone já integrado e não teríamos que lidar com coisas de hardware desde o início.

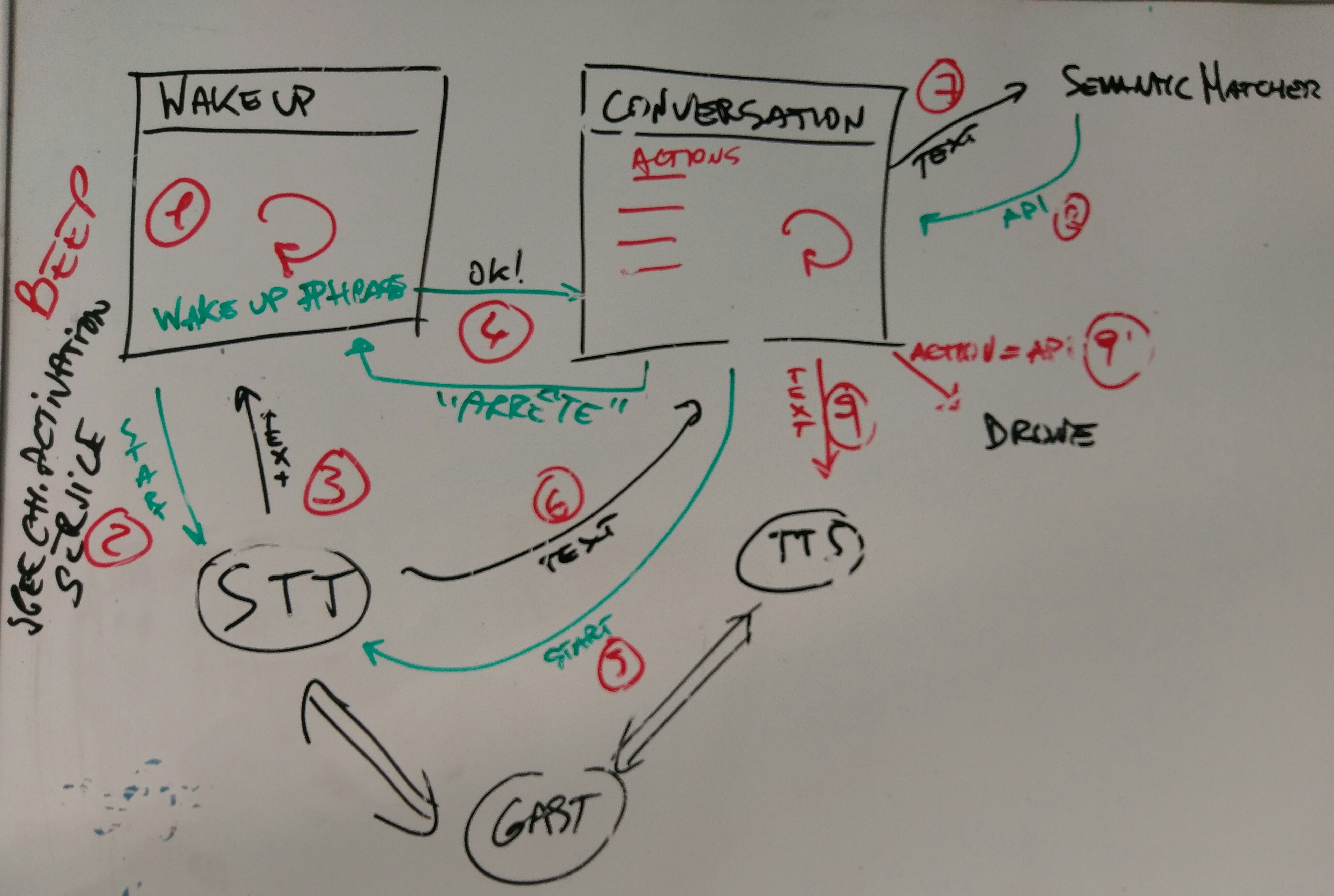

Então, criamos um aplicativo Android que possui 2 etapas/ações/telas: primeiro um receptor de despertar-up infinito (a la "ok google") e segundo, um receptor de comando que corresponde ao texto reconhecido a um conjunto de ações determinadas.

Para o nosso pequeno protótipo, partimos para enviar comandos para um pequeno drone na forma de "Hey Robot -> faça um salto em distância!/Vá em frente um pouco/vire à direita e gire!"

As ações foram definidas por meio de um arquivo de ontologia, criado pelo projeto de ontologia de Stanford 'Protege'

Depois que o texto é reconhecido pela API de fala do Android, nós (muito basicamente) procuramos ações na ontologia que, por sua vez, respondem com um método da API. O método da API é então executado e nossa implementação atual faz com que nosso drone se mova!

Bem, há um monte de coisas que gostaríamos de fazer: