Fornece 3 funções principais:

git clone https://github.com/microsoft/DeepSpeed.git

cd deepspeed

rm -rf build

TORCH_CUDA_ARCH_LIST= " 7.0 " DS_BUILD_OPS=1 pip install -e . --global-option= " build_ext " --global-option= " -j8 " --no-cache -v --disable-pip-version-check 2>&1 | tee build.log Se você deseja criar uma roda binária que seja conveniente para instalação em outras máquinas, pode usar o seguinte comando, que gerará um arquivo installável semelhante deepspeed-0.3.13+8cd046f-cp38-cp38-linux_x86_64.whl no diretório dist .

git clone https://github.com/microsoft/DeepSpeed.git

cd deepspeed

rm -rf build

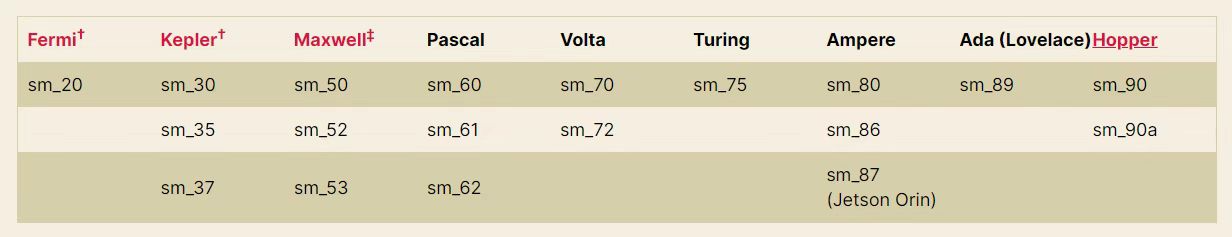

TORCH_CUDA_ARCH_LIST= " 7.0 " DS_BUILD_OPS=1 python setup.py build_ext -j8 bdist_wheel 2>&1 | tee build.log PS : De acordo com a figura abaixo, TORCH_CUDA_ARCH_LIST="7.0" precisa ser ajustado à sua arquitetura NVIDIA GPU correspondente.

Ou Run torch.cuda.get_device_capability() para obter sua própria arquitetura de GPU

Ao usar o modelo de classe Pangu, seu formato Special_Token é <sep> , <pad> , etc., e a função tokenize() em tokenization_gptpangu.py usará jieba para segmentação de palavras. Mas pip install jieba se separará diretamente < > padrão. Usando jieba.add_word("<sep>") não tem efeito, porque os tokens de codos rígidos diretamente jieba que se dividem automaticamente, incluindo < >

Portanto, é necessário executar:

git clone https://github.com/fxsjy/jieba.git

cd jieba Clonate o código localmente e modifique o valor de re_han_default em jieba/__init__.py As mudanças específicas são as seguintes:

re_han_default = re . compile ( "([ u4E00 - u9FD5 a-zA-Z0-9+#&._%-]+)" , re . U ) re_han_default = re . compile ( "([ u4E00 - u9FD5 a-zA-Z0-9+#&._%-<>]+)" , re . U ) Após a conclusão da modificação, use pip install . para compilação e instalação local e substitua o jieba original. Após a conclusão da instalação, adicione jieba.add_word("<sep>") ao código (o código foi adicionado tokenization_gptpangu.py) para resolver o problema de dividir os tokens especiais de <sep> em vários IDs.

git clone https://github.com/NVIDIA/apex

cd apex

pip install --global-option= " --cpp_ext " --global-option= " --cuda_ext " --no-cache -v --disable-pip-version-check . 2>&1 | tee build.log Se você deseja criar uma roda binária que seja conveniente para instalação em outras máquinas, pode usar o seguinte comando, que gerará um arquivo installável semelhante apex-0.0.1+7150e20-cp38-cp38-linux_x86_64.whl no diretório dist .

git clone https://github.com/NVIDIA/apex

cd apex

python setup.py --cpp_ext --cuda_ext bdist_wheel 2>&1 | tee build.log| Modelo | tamanho | Endereço de Huggingface | Endereço de disco de rede Baidu | Extrair código |

|---|---|---|---|---|

| Pangu-350m | 659 MB | Sunzeyeah/Pangu-350m | Pangu-350m | C5JJ |

| Pangu-2.6b | 9,8 GB | Sunzeyeah/pangu-2_6b | Pangu-2.6b | 2RAD |

| Pangu-13b | 23,6 GB | Sunzeyeah/Pangu-13b | Pangu-13b | u3dx |

| GLM-350M-Chinese | 679 MB | Sunzeyeah/GLM-350m-Chinese | GLM-350M-Chinese | ii8e |

| GLM-10b-Chinese | 18.4G | Sunzeyeah/GLM-10b-Chinese | GLM-10b-Chinese | Fynj |

| Chatglm-6b | 25.6g | Sunzeyeah/chatglm-6b | Chatglm-6b | uq1k |

PS : O modelo pré-treinado fornecido por este repositório está baixando.

| Conjunto de dados | tamanho | Endereço de Huggingface | Endereço de disco de rede Baidu | Extrair código |

|---|---|---|---|---|

| Referência de pista | 500 MB | Referência de pista | m6gt | |

| Dados de SFT e recompensa | 5 GB | Sunzeyeah/chinês_chatgpt_corpus | Dados de SFT e recompensa | Ecyc |

| Enciclopédia | 652MB | Baike_qa_2019 | 7JAD | |

| Conheça as perguntas e respostas | 847 MB | Zhidao | Neds | |

| Campa | 221MB | dísticos | 54EY | |

| Texto antigo | 125 MB | Clássico e moderno | A4CR | |

| Poesia antiga | 87 MB | Poesia chinesa | 5zzj | |

| Comentários do Weibo News | 522MB | Comentários resumidos do Weibo | W0G1 |

PS : Os dados da SFT e recompensa são baseados em enciclopédia, know-how, dísticos, textos antigos, poemas antigos e dados de comentários do Weibo News, e podem ser usados diretamente para o treinamento em estágio de SFT e recompensa. Consulte Data_Prepare.py para obter detalhes

Pré-treinado incrementalmente para o Open Source LLM, com base na implementação da DeepSpeed. Atualmente suporta arquiteturas de modelos de 2 classes:

cd examples

bash pretrain.shRevisões de LLMs chineses de código aberto para Zeroshot, OneShot ou Fewshot. Consulte EVAL_PRETRAIN.PY e DATA.PY para obter detalhes.

Tarefas de avaliação atualmente suportadas:

Modelos de código aberto atualmente suportados:

cd examples

bash eval_pretrain.shTreinamento SFT usando dados de código aberto LLM + SFT e recompensa

cd examples

bash train_sft.shTreinamento do modelo de recompensa usando o modelo SFT + SFT e dados de recompensa

cd examples

bash train_reward.shUsando o algoritmo PPO e o modelo de recompensa, o modelo SFT é atualizado ainda mais. Implementado com base na estrutura de código aberto DeepSpeedChat

cd examples

bash train_rlhf.shUsando o algoritmo DPO para substituir o pipeline de recompensa+rlHF, eliminando o treinamento de modelos de recompensa e alcançando o efeito do treinamento de RL, esse método pode reduzir significativamente o uso da memória. Implementado com base na estrutura de código aberto TRL

cd examples

bash train_dpo.sh| Modelo | Avg | AVG (difícil) | TRONCO | Ciências sociais | Humanidades | Outro |

| Baichuan2-13b-chat | 56.30 | 34.20 | 48.20 | 70,00 | 60,50 | 54.20 |

| xverse-13b | 55.30 | 32.50 | 45.90 | 66.70 | 59.50 | 57,60 |

| Qwen-7b-chat | 54.70 | 35.40 | 47.90 | 68.30 | 58,70 | 50.00 |

| BAICHUAN-13B-BASE | 53.70 | 35.60 | 46.80 | 65.80 | 58,00 | 50,80 |

| Baichuan2-7b-chat | 52.50 | 33.80 | 45.70 | 64.20 | 56.60 | 50.20 |

| Chatglm2-6b | 51.20 | 33.40 | 46.90 | 63.00 | 51.60 | 47.70 |

| Baichuan-13b-Chat | 47.90 | 31.50 | 41.40 | 56,80 | 53,00 | 46.50 |

| Baichuan-7b | 44.20 | 31.70 | 39.20 | 53.30 | 47.30 | 41.90 |

| Ziya-llama-13b-v1.1 | 40.10 | 30.30 | 35.80 | 47.30 | 42.80 | 38.50 |

| ChatglM1.1-6b | 38.10 | 28.60 | 33.60 | 46.70 | 40,90 | 35.70 |

| Atomgpt-13b-56k | 37.60 | 25.30 | 32.00 | 44.70 | 42.80 | 36.10 |

| Llama2-13b-chat | 37.10 | 29.30 | 34.60 | 43.60 | 35.90 | 37.00 |

| Chatglm-6b | 36.30 | 27.20 | 32.90 | 42.80 | 38.10 | 34.90 |

| LLAMA-30B | 35.90 | 29.90 | 34.40 | 42.40 | 33.30 | 35.60 |

| Llama2-7b-chat | 33.50 | 27.30 | 31.60 | 38.10 | 33.80 | 32.70 |

| Ziya-llama-13b-pré-fixa-v1 | 31.10 | 22.20 | 27.40 | 36.50 | 33.80 | 30.40 |

| LLAMA-13B | 29.8 | 24.20 | 28.40 | 33.70 | 29.60 | 29.00 |

| Llama-7b | 26.80 | 26.70 | 26.20 | 27.60 | 25,70 | 28.10 |

| Modelo | Avg | TRONCO | Ciências sociais | Humanidades | Outro |

| Baichuan2-13b-chat | 56.90 | 47.28 | 66.23 | 52.90 | 63.50 |

| LLAMA-30B | 56.33 | 44.68 | 65.64 | 54.60 | 61.57 |

| xverse-13b | 55.24 | 45.60 | 64.51 | 50.32 | 63.27 |

| Qwen-7b-chat | 54.13 | 41.76 | 63.43 | 50.81 | 62.50 |

| Llama2-13b-chat | 53.98 | 44.52 | 63.40 | 49.37 | 61.21 |

| BAICHUAN-13B-BASE | 53.46 | 43.86 | 63.14 | 49.73 | 59.28 |

| Baichuan2-7b-chat | 53.11 | 43.51 | 62.26 | 49.58 | 59.12 |

| Baichuan-13b-Chat | 51.12 | 41.61 | 59.11 | 47.52 | 58.31 |

| Ziya-llama-13b-v1.1 | 51.06 | 41.89 | 57.71 | 49.22 | 56.54 |

| Llama2-7b-chat | 48.10 | 39.64 | 56.28 | 43.61 | 55.39 |

| LLAMA-13B | 46.51 | 37.23 | 52.71 | 44.35 | 53.04 |

| Chatglm2-6b | 45.83 | 38.75 | 52.06 | 43.20 | 50.82 |

| Atomgpt-13b-56k | 42.75 | 36.02 | 49.04 | 38.80 | 49.30 |

| Baichuan-7b | 41.96 | 36.63 | 47.77 | 37.55 | 48.31 |

| Ziya-llama-13b-pré-fixa-v1 | 41.61 | 33.61 | 46.01 | 39.85 | 48.05 |

| ChatglM1.1-6b | 40.07 | 32.95 | 44.55 | 39.23 | 44.12 |

| Chatglm-6b | 37.87 | 32.41 | 43.80 | 35.60 | 41.00 |

| Llama-7b | 28.53 | 26.10 | 28.76 | 28.52 | 24.81 |

| Conjunto de dados | Método | Métricas | Tipo de tarefa | Zero-shot | Poucos anos | ||||||||

| GLM-350M-Chinese | Pangu-350m | Pangu-2.6b | GLM-10b-Chinese | Pangu-13b | GLM-350M-Chinese | Pangu-350m | Pangu-2.6b | GLM-10b-Chinese | Pangu-13b | ||||

| Ocnli | Ppl | acc | Nli | 0,3074 | 0,3369 | 0,3061 | 0,3288 | 0.3301 | 0,3298 | 0,3352 | 0,3216 | ||

| Cmnli | Ppl | acc | Nli | 0,3279 | 0.3302 | 0,3310 | 0,3338 | 0,3358 | 0,3356 | 0,3328 | 0,3300 | ||

| CHID | Ppl | acc | CLOZE (Multi-Choices) | 0,0734 | 0,0916 | 0,0670 | 0.1016 | 0,1018 | 0,0979 | 0.1007 | 0,0996 | ||

| CMRC2018 | Geração | F1 | MRC | 0,093 | 0,0979 | 0.1007 | 0,1392 | 0,021 | 0,09345 | 0,097 | 0.1007 | ||

| ClueWSC2020 | Ppl | acc | WSC | 0,4934 | 0,5328 | 0,5592 | 0,5131 | 0,4671 | 0,5526 | 0,4473 | 0,4671 | ||

| C3 | Ppl | acc | Raciocínio do senso comum | 0,2360 | 0,2426 | 0,2418 | 0,2573 | 0,2567 | 0,2476 | 0,2559 | 0,2515 | ||

| AFQMC | Ppl | acc | Classificação de texto | 0.6306 | 0,4582 | 0,4914 | 0,4960 | 0,5000 | 0,4872 | 0,4993 | 0,5018 | ||

| Csl | Ppl | acc | Classificação de texto | 0,4943 | 0,4913 | 0,4666 | 0,5126 | 0,4996 | 0,5140 | 0,5036 | 0,4973 | ||

| Iflytek | Ppl | acc | Classificação de texto | 0,1292 | 0,3058 | 0,265 | 0,2620 | 0,2408 | 0,2539 | 0,2535 | 0,2524 | ||

| Tnews | Ppl | acc | Classificação de texto | 0,1582 | 0,2022 | 0,2449 | 0,2489 | 0,2527 | 0,2555 | 0,2466 | 0,2494 | ||

Parâmetros de treinamento de modelo:

| Modelo | Quantidade do parâmetro de treinamento | Volume de dados | Tamanho do lote | comprimento da sequência | hardware | Uso da memória de vídeo | velocidade | Horas por época |

|---|---|---|---|---|---|---|---|---|

| GLM-350M-Chinese | 355m | 5.4m | 4 | 512 | V100 16G | 13G | 3.7 s/iter | 88h |

| Pangu-350m | 345m | 5.4m | 48 | 512 | A100 80G | 78G | 1.91 s/iter | 27.5h |

| Pangu-2.6b | 2.6b | 5.4m | 8 | 512 | A100 80G | 79.4G | 9.61 s/iter | 116h |

Download do modelo SFT:

| Modelo pré-treinado | Conjunto de dados SFT | tamanho | Endereço de Huggingface | Endereço de disco de rede Baidu | Extrair código |

|---|---|---|---|---|---|

| Pangu-350m | Dados de SFT e recompensa | 1,3 GB | Sunzeyeah/PANG-350M-SFT | PANG-350M-SFT | 0F8J |

| Pangu-2.6b | Dados de SFT e recompensa | 9,8 GB | Sunzeyeah/pangu-2_6b-sft | Pangu-2.6b-sft | R13W |

# 生成参数

max_length = 512

max_length_generation = 100

top_k = 10

temperature = 0.8

do_sample=True

[Input] 我不能确定对方是不是喜欢我,我却想分分秒秒跟他在一起,有谁能告诉我如何能想他少一点<sep>回答:

[Generated] 你爱他就多关心他,少在他面前表现出你的脆弱。这样他才更会爱你。

[Input] 一次次买彩,一次次倾听那比分,一次次兴奋,一次次失落,一次次无归而返!最终还是任8~~~~<sep>回答:

[Generated] 我也是这样,买彩的时间也不长,但是每次都是这样。。。。。。。

[Input] 现代文:太祖很高兴地说:凭着这样的部下去作战,还担心不能取胜么?<sep>古文:

[Generated] 太祖悦曰:此自是以去,何忧不胜?

[Input] 现代文:十一年秋,丞相伯颜与阿术会师襄阳,遣阿剌罕率诸翼军攻郢、复诸州,十月夺取郢州之南门堡。<sep>古文:

[Generated] 十一年秋,丞相伯颜与阿术会师襄阳,遣阿剌罕率诸翼军攻郢、复诸州,十月夺郢州之南门堡。

[Input] 以孔⁇的风格,写一篇经书,题为中庸<sep>

[Generated] 我闻昔者夫子之言也,曰:吾道一以贯之。其或行之或不行,吾未知之。是故君子慎其独也。吾未见好德如好色者也。好德如好色者,未之有也。好德如好色者,既已之有也。君子不以言举人,不以人废言。好德如好色者,其如命何!吾

[Input] 以陆游的风格,写一首七言诗,题为晨起<sep>

[Generated] 秋光满纸清⁇明,睡醒一江万马奔。自笑身如枯木鹤,何妨食饱作闲人。

[Input] 上联:霜风几笔雕残画<sep>下联:

[Generated] 云海千山叠翠峰

[Input] 新闻内容:据悉,这名14岁的女生在Facebook上发布了戏谑考试的博文,其中使用了胡志明1946年反对法国殖民者的讲话,随后被越南当局停课一年。越南官员称,该学生歪曲了历史事件,侮辱了老师的情感。多数网友虽对越南当局做法不满,但都表示,至少他们还能上Facebook.<sep>摘要:越南女生Facebook上模仿胡志明讲话被停课<sep>评论:

[Generated] 这女的,还真有勇气,我喜欢你!

[Input] 新闻内容:习近平天津考察时勉励大学生志存高远、脚踏实地,转变择业观念,坚持从实际出发,勇于到基层一线和艰苦地方去,把人生的路一步步走稳走实,善于在平凡岗位上创造不平凡的业绩<sep>摘要:习近平勉励大学生转变择业观念勇于到基层和艰苦地方去<sep>评论:

[Generated] 现在的社会,很多年轻人都是在父母的安排下,去了不同的单位,在不同的地方工作,在不同的城市生活,这就导致了年轻人的思维方式,价值观都不一样,这也导致了年轻人的成长道路,也有很多的不安全感,这也是很正常的事情,年轻人需要正确的引导,正确的引导,也需要正确的引导!

[Input] 问题:劳动仲裁申请法院强制执行,法院强制执行需要多长时间<sep>回答:

[Generated] 一般申请法院强制执行需要3-6个月时间,具体需要看法院的执行措施。

[Input] 问题:银行贷款50万,30年!年利率是4.41怎么算一个月还多少钱<sep>回答:

[Generated] 若申请的是招行贷款,要计算贷款利息或者每月还款金额,需要知道贷款本金,贷款期限,还款方式,贷款年利率。若上述信息都确认到,可以通过我行贷款计算器尝试计算,登录招行官网右下方找到“理财计算器”--“个人贷款计算器”可以计算。

Parâmetros de treinamento de modelo:

| Modelo | Quantidade do parâmetro de treinamento | Volume de dados | Tamanho do lote | comprimento da sequência | hardware | Uso da memória de vídeo | velocidade | Horas por época |

|---|---|---|---|---|---|---|---|---|

| Pangu-350m | 131m | 12m | 32 | 512 | A100 80G | 72.6g | 1.91 s/iter | 105h |

| Pangu-2.6b | 815m | 12m | 8 | 512 | A100 80G | 80.7g | 423h |

Download do modelo de recompensa:

| Modelo pré-treinado | Conjunto de dados SFT | tamanho | Endereço de Huggingface | Endereço de disco de rede Baidu | Extrair código |

|---|---|---|---|---|---|

| Pangu-350m | Dados de SFT e recompensa | 1,3 GB | Sunzeyeah/pangu-350m-recompensa | PANG-350M-RECWARED | 4GJU |

Para ser atualizado

Para verificar se a eficiência do treinamento do uso da velocidade profunda em diferentes modelos pré-treinados pode alcançar os efeitos oficialmente reivindicados (aceleração, economia de GPU etc.), o benchmarking foi realizado

max_sequence_length=512| Modelo | dados | General demorado/época | Demorado para uma única amostra | Uso de memória | Uso da memória de vídeo | Modelo de GPU e quantidade | FP16 | BF16 | estágio de velocidade profunda | Otimizador de descarte | Memória do PIN | descarregar o param de descarga | sobreposição comm | Tamanho do balde de Allgather | Stage3 Max Parâmetros ao vivo | Tamanho do lote | Etapas de acumulação de gradiente | Ponto de verificação de gradiente | modelo metade |

| T5-grande | WMT16-en-ro, um total de 610.000 amostras | 43h | 0,5s/it | 7.1g | 1*14529MB | 1*V100 16G | verdadeiro | - | - | - | - | - | - | - | - | 2 | 8 | falso | falso |

| 152h | 1.78s/it | 38.26G | 1*11663MB | 1*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 2E8 | - | 2 | 8 | falso | falso | ||

| 250h | 2,95s/it | 38.74G | 1*7255MB | 1*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 1e5 | - | 2 | 8 | falso | falso | ||

| 62h | 5.8s/it | 86.81g | 8*7811MB | 8*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 1e5 | - | 2 | 8 | falso | falso | ||

| - | - | - | OOM | 1*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 2E8 | - | 16 | 8 | falso | falso | ||

| - | - | - | OOM | 1*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 1e5 | - | 16 | 8 | falso | falso | ||

| 290H | 3.48s/it | 46.53G | 1*6655MB | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 2E8 | 2E8 | 2 | 8 | falso | falso | ||

| 380h | 4.5s/it | 43.48G | 1*5263MB | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 2 | 8 | falso | falso | ||

| 215h | 4.9S/IT | 47.31G | 2*5019MB | 2*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 2 | 8 | falso | falso | ||

| 1370H | 64s/it | 57,55G | 4*4701MB | 4*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 2 | 8 | falso | falso | ||

| 948H | 90s/it | 72.54G | 8*4585MB | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 2 | 8 | falso | falso | ||

| Pangu-2.6b | Conjunto de verificação da SFT e Recompensa Dados, com um total de 10.000 amostras | 2h | 5.76s/It | 67.86g | 1*15631MB | 1*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 2E8 | - | 2 | 8 | falso | falso |

| 2.1h | 6.15s/it | 67.88G | 1*15705MB | 1*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 1e5 | - | 2 | 8 | falso | falso | ||

| 4.5h | 13.3s/it | 81.02G | 1*15449MB | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 2E8 | 2E8 | 2 | 8 | falso | falso | ||

| 11.5h | 8.2s/it | 75.89G | 1*15299MB | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 2 | 8 | falso | falso | ||

| 5.5h | 7.8s/it | 81.16g | 2*14851MB | 2*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 2 | 8 | falso | falso | ||

| 6.2h | 18.3s/it | 97.31G | 4*14389MB | 4*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 2 | 8 | falso | falso | ||

| 6.6h | 38S/IT | 118.82G | 8*14335MB | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 2 | 8 | falso | falso | ||

| Chatglm-6b | Conjunto de verificação da SFT e Recompensa Dados, com um total de 10.000 amostras | - | - | 120.45G | OOM | 1*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 1e5 | - | 1 | 8 | verdadeiro | verdadeiro |

| - | - | 120.48G | OOM | 1*V100 16G | verdadeiro | - | 2 | verdadeiro | verdadeiro | - | falso | 1e3 | - | 1 | 8 | falso | verdadeiro | ||

| - | - | 153.02G | OOM | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1E2 | 1E2 | 1 | 8 | falso | verdadeiro | ||

| - | - | 154G | OOM | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 2E8 | 2E8 | 1 | 8 | verdadeiro | verdadeiro | ||

| 21.2h | 60s/it | 154G | 1*10443MB | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 2E8 | auto | 1 | 8 | verdadeiro | verdadeiro | ||

| 21.5h | 60s/it | 152.81G | 1*10409MB | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 1 | 8 | verdadeiro | verdadeiro | ||

| 23.5h | 65s/it | 153.36G | 1*9229MB | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 1 | 8 | verdadeiro | verdadeiro | ||

| 14h | 80s/it | 158.21G | 2*8631MB | 2*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 1 | 8 | verdadeiro | verdadeiro | ||

| 7.8h | 90s/it | 168.38G | 4*6743MB | 4*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 1 | 8 | verdadeiro | verdadeiro | ||

| 4h | 90s/it | 189.34G | 8*6729MB | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 1 | 8 | verdadeiro | verdadeiro | ||

| 1h | 100s/it | 189.38G | 8*10047MB | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 4 | 8 | verdadeiro | verdadeiro | ||

| 50min | 40s/it | 189.39G | 8*14763MB | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 8 | 2 | verdadeiro | verdadeiro | ||

| 35min | 113s/it | 189.39G | 8*14763MB | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 8 | 8 | verdadeiro | verdadeiro | ||

| - | - | 189.34G | OOM | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 10 | 8 | verdadeiro | verdadeiro | ||

| GLM-10b-Chinese | Conjunto de verificação da SFT e Recompensa Dados, com um total de 10.000 amostras | - | - | - | OOM | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 2E8 | 2E8 | 1 | 8 | verdadeiro | falso |

| - | - | - | OOM | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 2E8 | auto | 1 | 8 | verdadeiro | falso | ||

| - | - | - | OOM | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e5 | 1e5 | 1 | 8 | verdadeiro | falso | ||

| - | - | - | OOM | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1e3 | 1e3 | 1 | 8 | verdadeiro | falso | ||

| - | - | - | OOM | 1*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1E2 | 1E2 | 1 | 8 | verdadeiro | falso | ||

| - | - | - | OOM | 2*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1E2 | 1E2 | 1 | 8 | verdadeiro | falso | ||

| - | - | - | OOM | 4*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1E2 | 1E2 | 1 | 8 | verdadeiro | falso | ||

| - | - | OOM | - | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1E2 | 1E2 | 1 | 8 | verdadeiro | falso | ||

| - | - | - | OOM | 4*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1E2 | 1E2 | 1 | 8 | verdadeiro | verdadeiro | ||

| - | - | - | OOM | 6*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1E2 | 1E2 | 1 | 8 | verdadeiro | verdadeiro | ||

| - | - | OOM | - | 8*V100 16G | verdadeiro | - | 3 | verdadeiro | verdadeiro | verdadeiro | falso | 1E2 | 1E2 | 1 | 8 | verdadeiro | verdadeiro |

PS : Configuração do DeepSpeed para parâmetros e experiência de ajuste.

Para verificar a melhoria da eficiência do treinamento de Lora, foi realizado benchmarking

max_sequence_length=512, lora_alpha=1, lora_train_bias='none'| Modelo | Lora Rank | Quantidade do parâmetro de treinamento | DeepSpeed | Tamanho do lote | Modelo de GPU e quantidade | Uso da memória de vídeo | Demorado para uma única amostra | General demorado/época |

| Pangu-2.6b | - | 2.6b | - | 8 | 1*A100 80G | 1*79421MB | 9.66S/It | 12,5min |

| 1000 | 1.5b | - | 8 | 1*A100 80G | 1*76129MB | 11.61s/it | 15min | |

| 500 | 758 MB | - | 12 | 1*A100 80G | 1*77179MB | 16.2s/it | 14min | |

| 100 | 151 MB | - | 16 | 1*A100 80G | 1*81103MB | 18.6S/It | 12min | |

| 50 | 75 MB | - | 16 | 1*A100 80G | 1*80809MB | 17.8S/It | 11,5min | |

| 10 | 15 MB | - | 16 | 1*A100 80G | 1*78735MB | 17.6S/It | 11,5min | |

| 100 | 151 MB | estágio = 2, W descarregando | vinte e quatro | 1*A100 80G | 1*76933MB | 25.5s/It | 11min | |

| 100 | 151 MB | estágio = 3, W descarregando | vinte e quatro | 1*A100 80G | 1*77259MB | 46.5s/it | 20min | |

| Chatglm-6b | - | 6.2b | - | 3 | 1*A100 80G | 1*79206MB | 6.7s/it | 23,5min |

| 1000 | 1.9b | - | 6 | 1*A100 80G | 1*78840MB | 12.8s/It | 22,5min | |

| 500 | 994MB | - | 6 | 1*A100 80G | 1*68832MB | 12.4s/it | 21,5min |