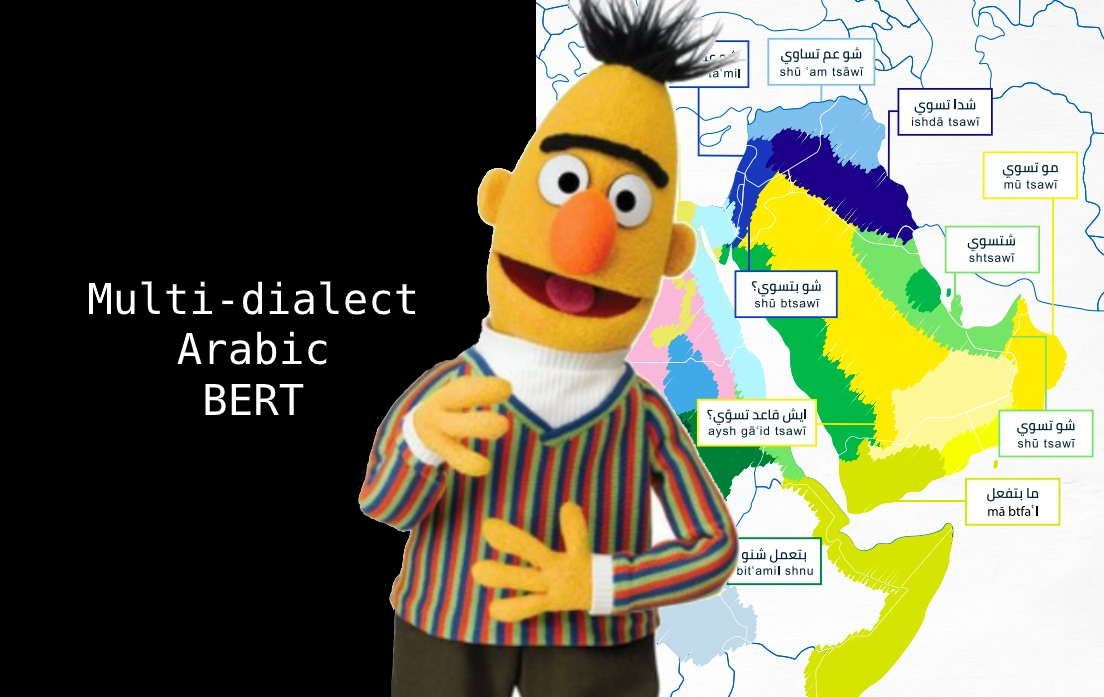

Multi dialect Arabic BERT

1.0.0

이것은 다중 다발 아랍어 버트 모델의 저장소입니다.

Mawdoo3-IA에 의해.

다중 다발성 아랍어 버트 모델을 처음부터 훈련시키는 대신, 우리는 아랍어 베르트를 사용하여 모델의 가중치를 초기화하고 미묘한 아랍어 방언 식별 (NADI) 공유 작업의 무연 데이터에서 10m 아랍어 트윗으로 교육했습니다.

@misc{talafha2020multidialect,

title={Multi-Dialect Arabic BERT for Country-Level Dialect Identification},

author={Bashar Talafha and Mohammad Ali and Muhy Eddin Za'ter and Haitham Seelawi and Ibraheem Tuffaha and Mostafa Samir and Wael Farhan and Hussein T. Al-Natsheh},

year={2020},

eprint={2007.05612},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

모델 가중치는 HuggingFace를 통해 transformers 라이브러리를 사용하여로드 할 수 있습니다.

from transformers import AutoTokenizer , AutoModel

tokenizer = AutoTokenizer . from_pretrained ( "bashar-talafha/multi-dialect-bert-base-arabic" )

model = AutoModel . from_pretrained ( "bashar-talafha/multi-dialect-bert-base-arabic" ) pipeline 사용 예 :

from transformers import pipeline

fill_mask = pipeline (

"fill-mask" ,

model = "bashar-talafha/multi-dialect-bert-base-arabic " ,

tokenizer = "bashar-talafha/multi-dialect-bert-base-arabic "

)

fill_mask ( " سافر الرحالة من مطار [MASK] " ) [{'sequence': '[CLS] سافر الرحالة من مطار الكويت [SEP]', 'score': 0.08296813815832138, 'token': 3226},

{'sequence': '[CLS] سافر الرحالة من مطار دبي [SEP]', 'score': 0.05123933032155037, 'token': 4747},

{'sequence': '[CLS] سافر الرحالة من مطار مسقط [SEP]', 'score': 0.046838656067848206, 'token': 13205},

{'sequence': '[CLS] سافر الرحالة من مطار القاهرة [SEP]', 'score': 0.03234650194644928, 'token': 4003},

{'sequence': '[CLS] سافر الرحالة من مطار الرياض [SEP]', 'score': 0.02606341242790222, 'token': 2200}]

| 매개 변수 | 값 |

|---|---|

| 건축학 | Bertformaskedlm |

| hidden_size | 768 |

| max_position_embeddings | 512 |

| num_attention_heads | 12 |

| num_hidden_layers | 12 |

| vocab_size | 32000 |

| hidden_size | 768 |

| 총 매개 변수 수 | 110m |