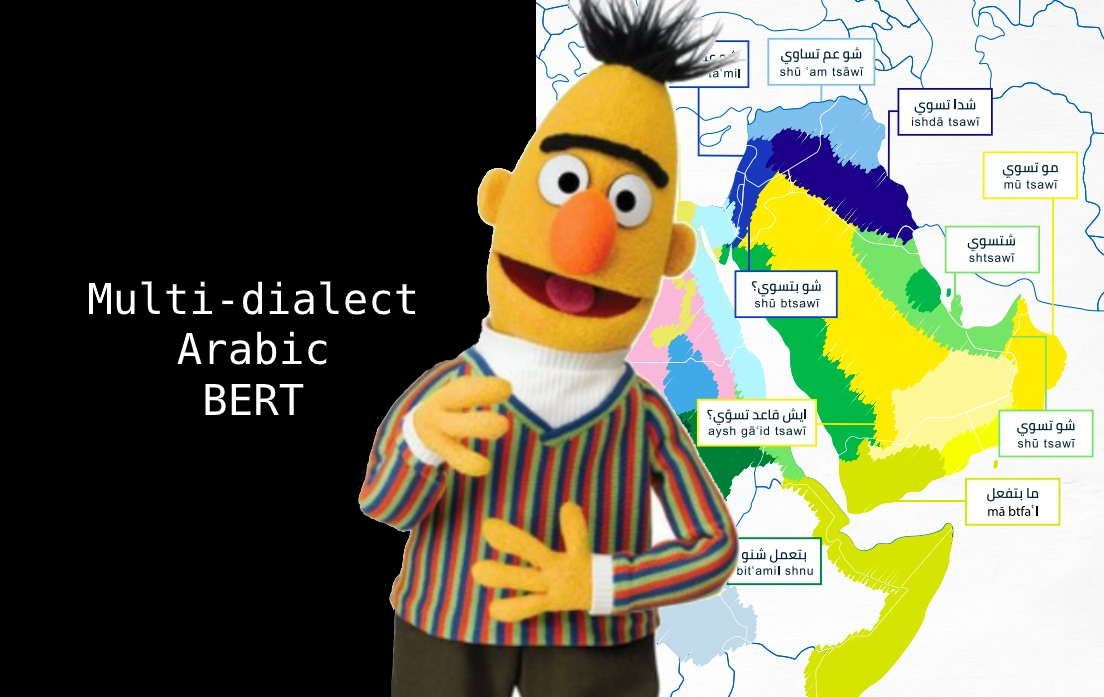

Multi dialect Arabic BERT

1.0.0

Este es un repositorio del modelo de BERT en árabe multi-dialecto.

Por Mawdoo3-Ai.

En lugar de entrenar el modelo de BERT en árabe multi-dialecto desde cero, inicializamos los pesos del modelo usando árabe-bert y lo entrenamos en tweets árabes de 10 m de los datos no habilitados de la tarea compartida de identificación de dialectos árabes (NADI) matizados.

@misc{talafha2020multidialect,

title={Multi-Dialect Arabic BERT for Country-Level Dialect Identification},

author={Bashar Talafha and Mohammad Ali and Muhy Eddin Za'ter and Haitham Seelawi and Ibraheem Tuffaha and Mostafa Samir and Wael Farhan and Hussein T. Al-Natsheh},

year={2020},

eprint={2007.05612},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

Los pesos del modelo se pueden cargar utilizando la biblioteca transformers por Huggingface.

from transformers import AutoTokenizer , AutoModel

tokenizer = AutoTokenizer . from_pretrained ( "bashar-talafha/multi-dialect-bert-base-arabic" )

model = AutoModel . from_pretrained ( "bashar-talafha/multi-dialect-bert-base-arabic" ) Ejemplo usando pipeline :

from transformers import pipeline

fill_mask = pipeline (

"fill-mask" ,

model = "bashar-talafha/multi-dialect-bert-base-arabic " ,

tokenizer = "bashar-talafha/multi-dialect-bert-base-arabic "

)

fill_mask ( " سافر الرحالة من مطار [MASK] " ) [{'sequence': '[CLS] سافر الرحالة من مطار الكويت [SEP]', 'score': 0.08296813815832138, 'token': 3226},

{'sequence': '[CLS] سافر الرحالة من مطار دبي [SEP]', 'score': 0.05123933032155037, 'token': 4747},

{'sequence': '[CLS] سافر الرحالة من مطار مسقط [SEP]', 'score': 0.046838656067848206, 'token': 13205},

{'sequence': '[CLS] سافر الرحالة من مطار القاهرة [SEP]', 'score': 0.03234650194644928, 'token': 4003},

{'sequence': '[CLS] سافر الرحالة من مطار الرياض [SEP]', 'score': 0.02606341242790222, 'token': 2200}]

| Parámetro | Valor |

|---|---|

| arquitectura | Bertformaskedlm |

| Hidden_size | 768 |

| max_position_embeddings | 512 |

| num_attention_heads | 12 |

| num_hidden_layers | 12 |

| VOCAB_SIZE | 32000 |

| Hidden_size | 768 |

| Número total de parámetros | 110m |