이 저장소는 OpenVoice를 사용하여 음성 음색을 캡처하고 추론하여 YouTube 비디오를 더빙하기위한 FastApi 백엔드를 개발하기위한 시작점 역할을합니다.

Fastapi-Cloudrun-starter

YouTube Auto-Dub를 시작하려면 다음을 수행하십시오.

지역 개발을 위해서는 다음과 같이 콘다 환경을 설정하는 것이 좋습니다.

conda install mamba -n base -c conda-forge

mamba create -n youtube-auto-dub python=3.9 -y

mamba install -n youtube-auto-dub pytorch==1.13.1 torchvision==0.14.1 torchaudio==0.13.1 pytorch-cuda=11.7 -c pytorch -c nvidia -y

conda activate youtube-auto-dub

pip install -r requirements.txt음성 음색 인식 및 합성에 필요한 모델 체크 포인트를 다운로드하십시오.

sudo aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://myshell-public-repo-hosting.s3.amazonaws.com/checkpoints_1226.zip -d /code -o checkpoints_1226.zip

sudo unzip /code/checkpoints_1226.zip -d backend/checkpoints환경 설정 및 체크 포인트가 다운로드되면 백엔드 디렉토리로 이동하여 다음을 사용하여 응용 프로그램을 시작하십시오.

cd backend

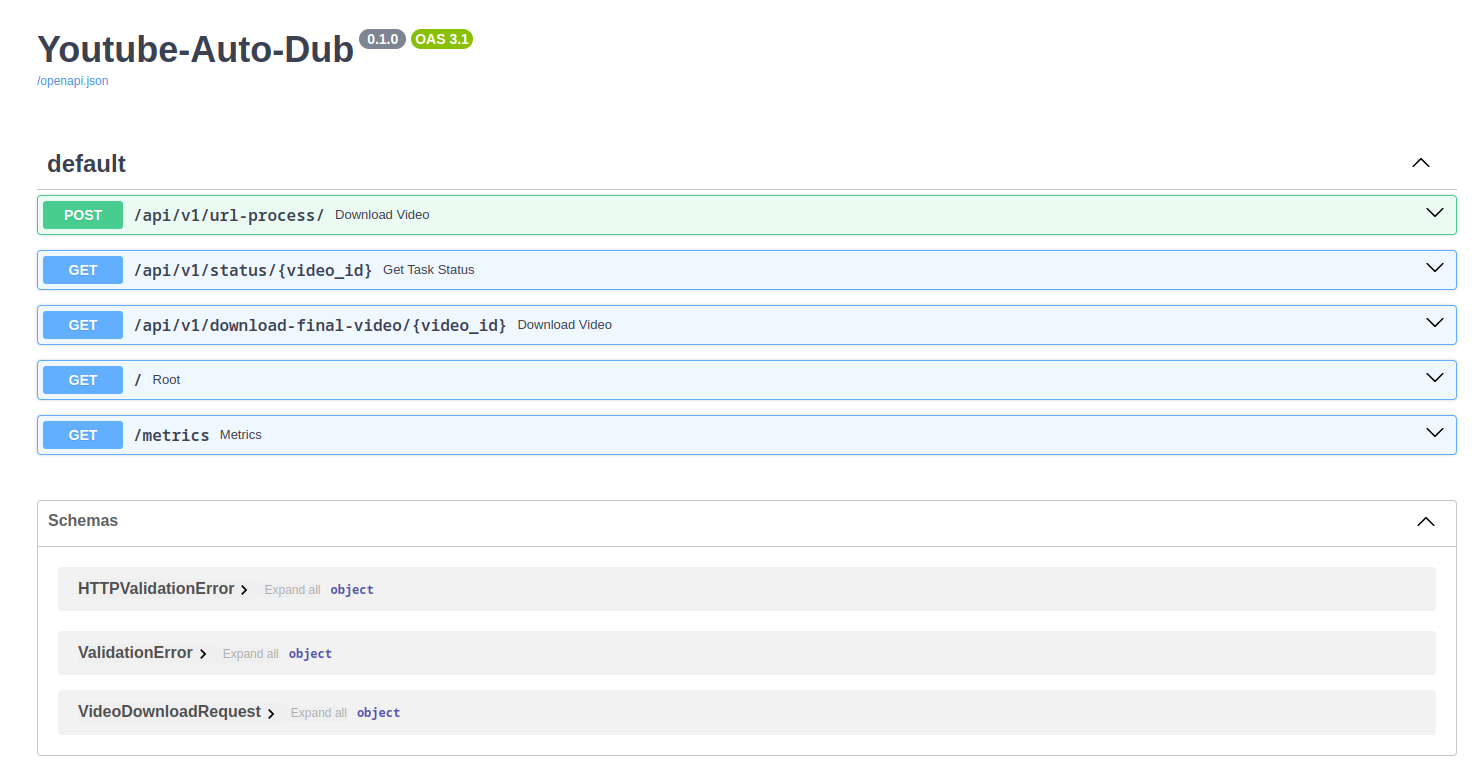

uvicorn app.main:app --reloadYouTube Auto-Dub을 사용하려면 엔드 포인트를 통해 YouTube 링크를 제출하여 시작하십시오.

/api/v1/download/

응용 프로그램은 비디오를 처리하고, 음성 목재를 인식하고, 자막을 번역하고, 원래 음색과 일치하는 번역 된 연설을 합성 한 다음 최종 비디오를 조립합니다. 처리 된 비디오는 backend/data/final_videos 에 저장됩니다. 출력에서 비디오 ID가 반환되면 엔드 포인트를 통해 처리 상태를 확인할 수 있습니다.

/api/v1/status/{video_id}

마지막으로 엔드 포인트를 사용하여 최종 비디오를 다운로드 할 수 있습니다.

/api/v1/download-video/{video_id}

비디오의 ID 삽입.

이 프로젝트는 클라우드 배포를 염두에두고 설계되었습니다. 제공된 cloudbuild.yaml 및 TerraForm 구성은 Google Cloud 플랫폼에서 배포를 용이하게합니다. 특히 Cladable, Serverless Application 호스팅에 클라우드 실행을 사용합니다.

기부금을 환영합니다! 버그를 고치거나 새로운 기능 추가 또는 문서 개선에 관계없이 도움을 주시면 도움이됩니다. 저장소를 포크하고 풀 요청을 제출하십시오.

YouTube Auto-Dub의 개발은 다음 저장소에서 영감을 얻었습니다.

이 프로젝트는 MIT 라이센스에 따라 라이센스가 부여됩니다. 자세한 내용은 라이센스 파일을 참조하십시오.