このリポジトリは、OpenVoiceを使用してVoice Timbreをキャプチャして推測することにより、YouTubeビデオを吹き替えるためのFastAPIバックエンドを開発するための出発点として機能します。

Fastapi-Cloudrun-Starter

YouTube Auto-Dubを開始するには、次の手順に従ってください。

地元の開発には、次のようなコンドラ環境を設定することをお勧めします。

conda install mamba -n base -c conda-forge

mamba create -n youtube-auto-dub python=3.9 -y

mamba install -n youtube-auto-dub pytorch==1.13.1 torchvision==0.14.1 torchaudio==0.13.1 pytorch-cuda=11.7 -c pytorch -c nvidia -y

conda activate youtube-auto-dub

pip install -r requirements.txt音声の認識と合成に必要なモデルチェックポイントをダウンロードしてください。

sudo aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://myshell-public-repo-hosting.s3.amazonaws.com/checkpoints_1226.zip -d /code -o checkpoints_1226.zip

sudo unzip /code/checkpoints_1226.zip -d backend/checkpoints環境がセットアップされ、チェックポイントがダウンロードされたら、バックエンドディレクトリに移動し、以下を使用してアプリケーションを開始します。

cd backend

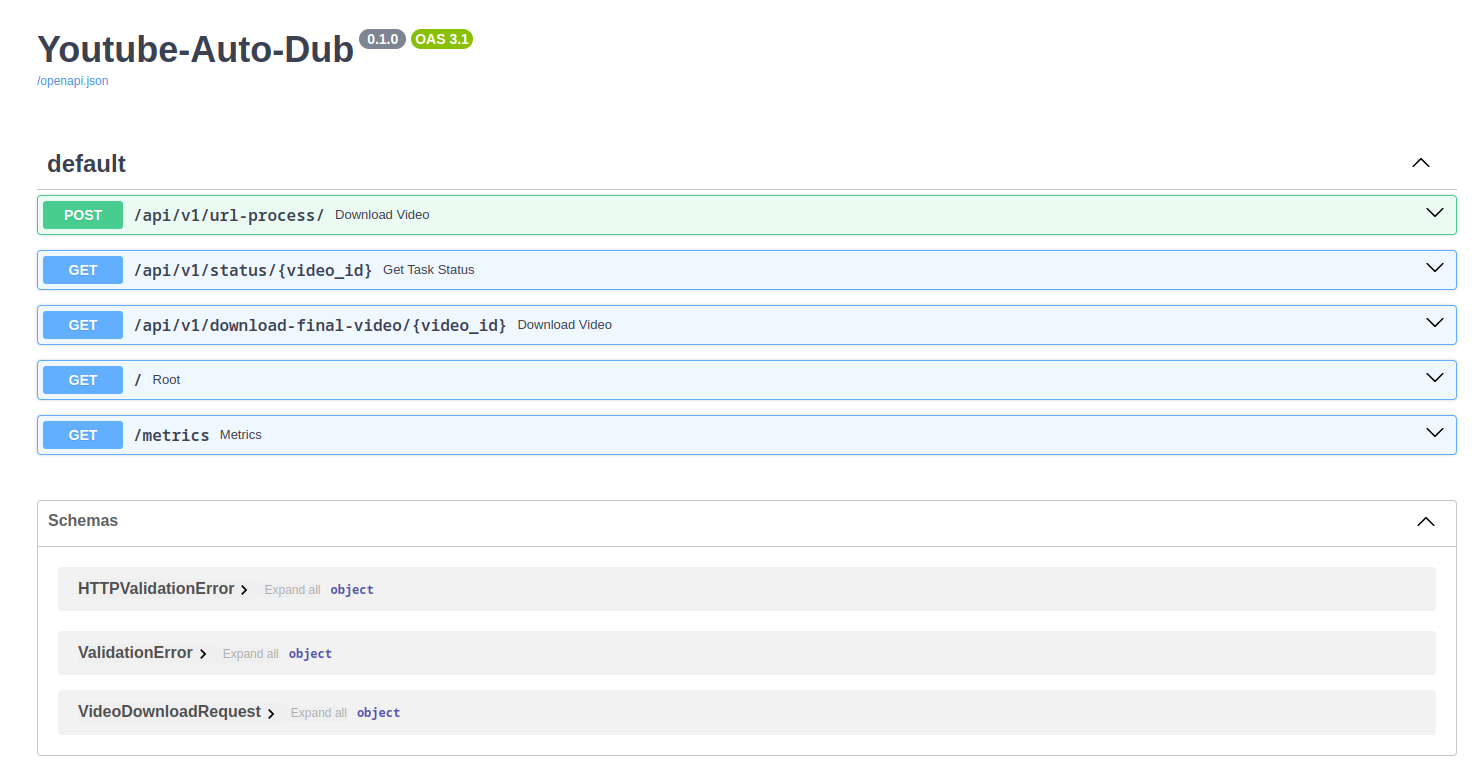

uvicorn app.main:app --reloadYouTube Auto-Dubを使用するには、エンドポイントを介してYouTubeリンクを送信することから始めます。

/api/v1/download/

アプリケーションは、ビデオの処理、音声の音色を認識し、字幕を翻訳し、元の音色に一致する翻訳された音声を合成し、最終ビデオを組み立てます。処理されたビデオはbackend/data/final_videosに保存されます。ビデオIDが出力で返されると、エンドポイントを介して処理ステータスを確認できます。

/api/v1/status/{video_id}

最後に、エンドポイントを使用して最終ビデオをダウンロードできます。

/api/v1/download-video/{video_id}

ビデオのIDを挿入します。

このプロジェクトは、クラウドの展開を念頭に置いて設計されています。提供されたcloudbuild.yamlおよびTerraformの構成は、Google Cloudプラットフォームでの展開を容易にします。

貢献は大歓迎です!バグを修正したり、新しい機能を追加したり、ドキュメントを改善したりする場合でも、あなたの助けが高く評価されます。リポジトリをフォークし、プルリクエストを送信してください。

YouTube Auto-Dubの開発は、次のリポジトリに触発されました。

このプロジェクトは、MITライセンスに基づいてライセンスされています。詳細については、ライセンスファイルを参照してください。