가벼운 작은 프레임, 당신이 좋아한다면 스타에 오신 것을 환영합니다 ~ 감사합니다. 문제가 발생하면 문제를 요청할 수 있으며 답장을 할 것입니다.

현재 분산 교육의 버전이 재현되어 있습니다. 추가 명령이나 추가 코드없이 다중 GPU를 직접 교육 할 수 있습니다 ! 자세한 내용은 https://github.com/920232796/bert_seq2seq_ddp에 오신 것을 환영합니다

"model_name"매개 변수를 설정하여 다른 모델로드가 달성되며 "model_class"매개 변수를 설정하여 다른 작업이 달성됩니다. 자세한 내용은 예에서 다양한 예를 볼 수 있습니다.

코드 중 일부는 https://github.com/huggingface/transformers/ 및 https://github.com/bojone/bert4keras에 참조됩니다. ! !

오늘 좋은 날씨

, 나는 아기와 함께 영화를 보러 갔다. 정말 좋았다! 환경은 할 말이 없습니다. 영화는 매우 절묘하고 음향 효과는 매우 좋습니다. 이 가게가 여전히 열려 있는지 모르겠습니다. 시간이 있으면 자주 확인할 수 있기를 바랍니다.

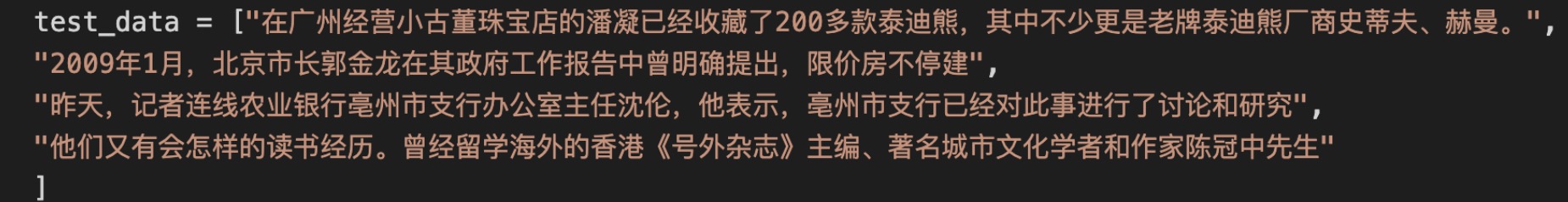

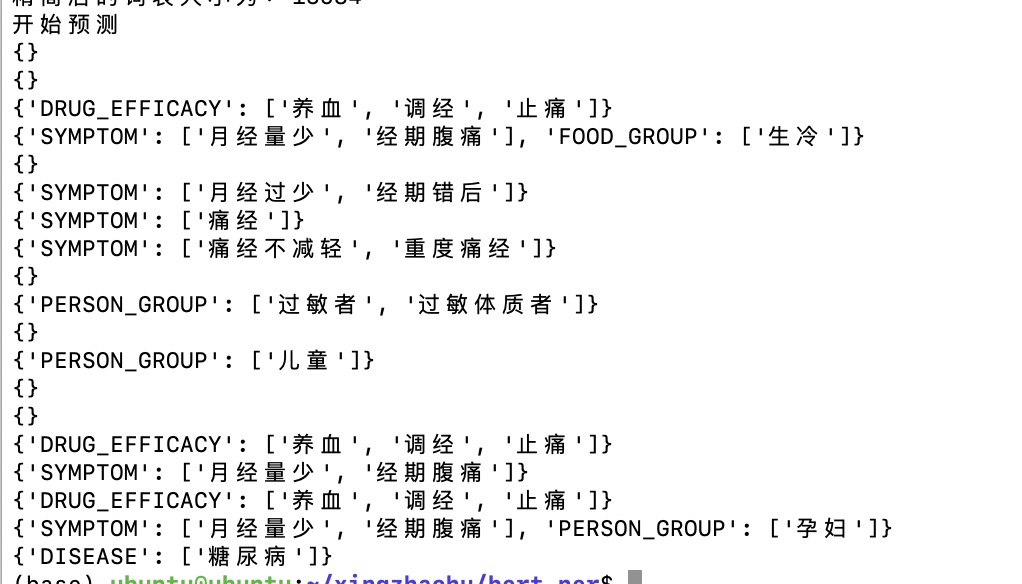

입력하다: 산출:

산출:

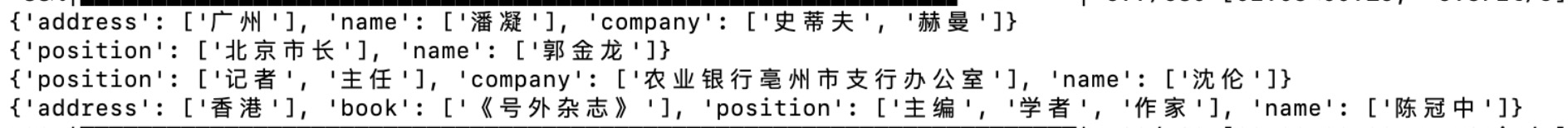

산출:

다른 약물과 동시에 사용하는 경우 약물 상호 작용이 발생할 수 있습니다. 자세한 내용은 의사 또는 약사에게 문의하십시오. 끓는 물, 한 번에 14 그램, 하루에 3 번 가져 가십시오. 피를 영양을 공급하고 월경을 조절하며 통증을 완화시킵니다. 그것은 월경 흐름, 잘못된 월경 복통, Jianmin Group Yekai Thai Medicine (Suizhou) Co., Ltd. 1. 날고 차가운 음식을 먹지 마십시오. 2. 다른 질병이있는 사람들은 의사의지도하에 복용해야합니다. 3. 월경이 정상적인 경우 월경이 갑자기 감소한 후 치료를 위해 병원에 가야하거나 월경 기간이 잘못되었습니다. 4. menorrhea의 치료를 위해서는 월경 3 ~ 5 일 전에 약을 복용하여 일주일 동안 복용하는 것이 좋습니다. 다산 요구 사항이있는 경우 의사의지도하에 가져 가야합니다. 5. 약을 복용 한 후일 또는 심각한 성형술을받은 사람들은 진단 및 치료를 위해 병원에 가야합니다. 6. 2 주 동안 약을 복용 한 후 증상이 완화되지 않으면 치료를 위해 병원에 가야합니다. 7.이 제품에 알레르기가있는 사람들에게는 금지되며 신체에 알레르기가있는 경우주의해서 사용됩니다. 8.이 제품의 특성이 변할 때 사용하는 것이 금지되어 있습니다. 9.이 제품을 아이들이 도달 할 수없는 곳에 배치하십시오. 10. 다른 약물을 사용하는 경우이 제품을 사용하기 전에 의사 나 약사에 문의하십시오. 이 제품은 부인과 불규칙한 월경을위한 처방전없이 구입할 약물입니다. 피를 영양을 공급하고 월경을 조절하며 통증을 완화시킵니다. 월경 중 복통에 사용됩니다. 피를 영양을 공급하고 월경을 조절하며 통증을 완화시킵니다. 월경 흐름, 잘못된 월경 복통, 14G*5 봉지의 처방전없이 구입할 수있는 약물 (클래스 B), 임산부에게 금지 된 국가 의료 보험 디렉토리 (클래스 B)에 사용됩니다. 당뇨병 환자는 그것을 취할 수 없습니다.

pip install bert-seq2seq 설치하십시오pip install tqdm 표시하는 데 사용될 수 있습니다.Bert 모델을로드하면 Model_Name 매개 변수는 사용할 버트를 지정하며 현재 Bert, Roberta 및 Nezha를 지원합니다. model_class Bert를 사용할 작업을 지정하고 Seq2Seq는 생성 작업을 나타내고 CLS는 텍스트 분류 작업을 나타냅니다 ...

버트 모델 매개 변수로드, 인코더 매개 변수, 즉 인터넷에서 다운로드 된 미리 훈련 된 모델의 매개 변수 만로드하는 것입니다. 예를 들어, Seq2Seq 모델에는 Bert 모델 + 전체 연결 계층의 매개 변수가 포함되어 있으며이 함수는 매개 변수의 첫 번째 부분 만로드합니다.

모든 모델 매개 변수를로드하십시오. 한동안 훈련을 받고 모델을 저장 한 후이 기능을 통해 마지막 모델 교육 결과를로드하고 교육 또는 테스트를 계속할 수 있습니다.

다양한 기사를 읽으려면 내 웹 사이트 ~ http://www.blog.zhxing.online/#/시, 커플, NER 또는 뉴스 초록 텍스트 분류를 검색하여 해당 기사를 찾을 수 있습니다. 지원해 주셔서 감사합니다.

2021.11.12 : Roberta-Large 모델을 지원하는 최적화 된 코드.

2021.10.12 : NER의 디코딩 방법이 최적화되었습니다. 이전의 거친 입자 디코딩 방법에는 버그가있었습니다.

2021.08.18 : 많은 양의 코드가 최적화되었습니다. 프레임 워크 코드는 현재 더 명확 해 보이고 많은 양의 중복 코드가 삭제되었습니다.

2021.08.17 : 화웨이의 Nezha 모델을 지원합니다. 매우 간단합니다. Model_Name 매개 변수를 변경하십시오. 효과 테스트에 오신 것을 환영합니다.

2021.08.15 : 단어 세분화의 예를 추가하고 토큰 화기에 재 대결 코드를 추가했습니다.

2021.07.29 : 일부 코드 최적화가 더 간결합니다.

2021.07.20 : Simbert 모델이 재현되고 유사한 문장의 출력을 수행 할 수 있지만 소량의 데이터로 인해 테스트해야합니다.

2021.03.19 : 모델 확장을 지원하며 프레임 워크와 함께 제공되는 모델을 사용 할뿐만 아니라 교육 및 예측을 위해 포옹 얼굴에 모델을 직접로드 할 수 있습니다.

2021.03.12 : Zhou Gong의 꿈의 해석 인 GPT2 중국 훈련의 예를 추가했습니다.

2021.03.11 : GPT2 추가 예제, 기사를 계속 작성할 수 있습니다.

2021.03.11 : 무작위 생성 디코딩 방법이 추가되었으며 그 세대는 더욱 다양 해졌습니다.

2021.03.08 : 빔 검색은 N 결과를 무작위로 출력으로 반환합니다.

2021.02.25 : 시맨틱 매칭의 예를 추가했습니다.

2021.02.06 : 장치 설정 방법이 조정되었으며 이제 더 편리합니다.

2021.1.27 : 프레임 워크의 코드 구조가 조정되었으며 많은 변경 사항이 있습니다. 버그가 있으면 자유롭게 발행하십시오.

2021.1.21 : 새로운 예제 인 캐릭터 관계 추출 분류가 추가되었습니다.

2020.12.02 : 일부 코드가 조정되었고 여러 테스트 파일이 추가되어 훈련 된 모델을 쉽게로드하고 해당 작업을 테스트 할 수 있습니다.

2020.11.20 : 예제를 추가하여 트리플 추출 F1은 현재 0.7에 도달 할 수 있습니다. 뉴스 요약 텍스트 분류에 대한 테스트 코드가 추가되었습니다.

2020.11.04 : 일반적인 ner 작업을 수행하기 위해 BET-CRF를 실행하는 예, 효과가 좋습니다.

2020.10.24 : 많은 양의 코드가 조정되었으며 ThucNews 데이터 세트의 자동 요약 예가 추가되었습니다. 이제 훈련은 매우 효과적이었을 것입니다. 과거에는 사전 훈련 매개 변수가로드되지 않을 수 있으며 그 효과는 매우 열악 할 수 있습니다.

2020.10.23 : 일부 코드 구조가 조정되었고 각 예제의 일부 변수는 전역 변수로 기록되었으며 빔 검색 코드가 변경되어 더 간소화되었습니다. 그러나시를 쓰는 운율은 당분간 뒷받침되지 않습니다. 나중에 보충하십시오.

2020.09.29 : Tianchi Medical Ner 경쟁 (Medical NER_TRAIN.PY)의 새로운 교육 예가 추가됩니다. 자세한 내용은 경쟁 인터페이스 : https://tianchi.aliyun.com/competition/entrance/531824/information을 참조하십시오

2020.08.16 :시 커플 (Poetry Couplets_train.py)의 공동 훈련의 예를 추가하면시와 가사와 커플을 동시에 쓸 수 있습니다. 또한시를위한 새로운 테스트 코드가 추가되며 모델을 교육 한 후에는 테스트 할 수 있습니다.

2020.08.08 :이 업데이트에는 많은 내용이 있습니다. 1. 자동 요약의 예를 추가했습니다 (Auto_title.py) 2. 단순화 된 어휘 목록에 대한 코드를 추가했습니다. 원래의 3W 단어는 1W 이상으로 축소되었습니다 (일부 단어가 나타나지 않기 때문에) 3. 일부 빔 검색 코드를 수정했으며 그 효과가 더 좋았습니다. 4. 세분화 된 NER은 당분간 사용될 수 없으며 데이터는 약간 문제가 있으므로 테스트 폴더에 일시적으로 넣으십시오. 올바른 데이터를 찾으면 사용할 수 있습니다. 5. 새로운 테스트 폴더를 추가하십시오. 훈련 된 모델을 테스트하여 효과를 확인할 수 있습니다.

2020.06.22 : 조건부 계층 표준에 따라 기사를 보완했습니다. 코드 중 일부가 설명되었습니다. http://www.blog.zhxing.online/#/readblog?blogid=347

2020.06.21 : 많은 코드가 업데이트되었고 트리플 추출의 예가 재현되었습니다 (Triple Extraction_train.py) ~

2020.06.02 : 최근에 졸업으로 바빴지만 여전히 경쟁이 벌어졌습니다. 당분간 업데이트하지 않겠으며 앞으로도 계속 업데이트 할 것입니다.

2020.04.18 : Bert+CRF 모델을 훈련 한 후 CRF 계층의 학습 속도는 충분히 높지 않아 개선 될 필요가 있습니다 (CRF 계층 학습 속도는 이제 별도로 설정 될 수 있으며 일반적으로 0.01로 설정).

2020.04.13 : 교육 예제를 통해 실행되는 NER 작업 + CRF 계층 손실이 추가되었지만 Viterbi 알고리즘은 아직 추가되지 않았습니다.

2020.04.11 : NER 작업에 CRF 계층을 추가 할 계획입니다.

2020.04.07 : NER의 예를 추가했습니다.

2020.04.07 : PYPI를 업데이트하고 NER과 같은 시퀀스 주석 작업에 대한 모델을 추가했습니다.

2020.04.04 : PYPI 위의 코드가 업데이트되었습니다. 현재 최신 버전은 0.0.6입니다. 최신 버전을 사용하면 버그가 적습니다.

2020.04.04 : 뉴스 제목 텍스트 분류의 일부 버그 및 추가 된 예제를 수정했습니다.

2020.04.02 :시를 쓰는 빔 검색에서 반복적 인 단어와 운율에 대한 처벌의 정도가 더 나을 수 있습니다.

2020.04.02 : Zhou Gong의 꿈의 해석 과제가 추가되었습니다

2020.04.02 : 커플의 작업이 추가되었습니다

2020.04.01 :시를 쓰는 과제가 추가되었습니다

2020.04.01 : 코드를 리팩토링했으며 새로운 작업 훈련을 시작하는 데 시간이 걸렸습니다.

Python setup.py sdist 트윈 업로드 dist/bert_seq2seq-2.3.5.tar.gz