Repositori ini terinspirasi oleh artikel "Fine Tuning Large Language Model (LLMS)" dan berisi kode untuk melatih model klasifikasi teks menggunakan dataset Stanford sentimen Treebank (SST-2) dan fine-tuning Lora (adaptasi rendah model bahasa besar). Lora adalah cara untuk membuat model bahasa lebih mudah beradaptasi dan efisien. Alih-alih melatih seluruh model lagi untuk setiap tugas, Lora membekukan model pra-terlatih dan menambahkan matriks yang dapat dilatih lebih kecil untuk setiap lapisan model. Matriks ini membantu model beradaptasi dengan tugas yang berbeda tanpa mengubah semua parameter.

Sebelum menggunakan kode di repositori ini, Anda perlu menginstal pustaka yang diperlukan. Anda dapat melakukan ini dengan menjalankan perintah berikut:

! pip install datasets

! pip install transformers

! pip install peft

! pip install evaluatePerintah -perintah ini akan menginstal pustaka Python yang diperlukan untuk bekerja dengan dataset, transformator, LORA, dan metrik evaluasi.

Inilah cara menggunakan kode di repositori ini:

Muat dataset SST-2 :

Kode memuat dataset SST-2 menggunakan perpustakaan datasets Wajah Memeluk. SST-2 terdiri dari kalimat dari ulasan film, dijelaskan dengan label sentimen. Anda dapat menemukan informasi lebih lanjut tentang dataset SST-2 di sini.

Tentukan Arsitektur Model Lora :

Kode ini menggunakan teknik LORA untuk menyempurnakan model bahasa yang terlatih untuk klasifikasi teks. Lora secara efisien mengadaptasi model dengan tugas dengan memanfaatkan properti peringkat rendah dari perbedaan berat. Implementasi LORA dapat ditemukan dalam kode.

Tokenize dataset :

Dataset di -tokenized menggunakan tokenizer model, dan token khusus seperti [PAD] ditambahkan jika mereka belum ada.

Latih model Lora :

Kode ini mendefinisikan hyperparameter pelatihan dan melatih model yang diadaptasi Lora menggunakan dataset yang disediakan. Argumen pelatihan seperti tingkat pembelajaran, ukuran batch, dan jumlah zaman dapat disesuaikan dalam variabel training_args .

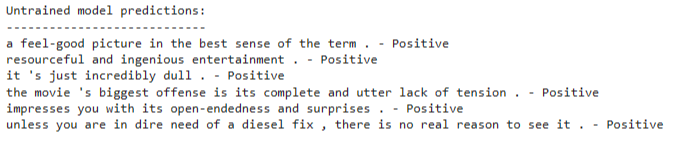

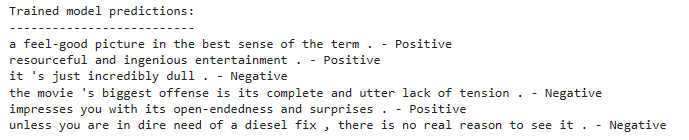

Menyimpulkan dengan model lora terlatih :

Setelah pelatihan, Anda dapat menggunakan model yang diadaptasi Lora terlatih untuk inferensi pada input teks baru. Kode menunjukkan cara memuat model dan membuat prediksi pada daftar contoh kalimat.

Kode ini menggunakan model klasifikasi teks berdasarkan arsitektur model bahasa pra-terlatih. Fine-tuning Lora diterapkan untuk mengadaptasi model pra-terlatih ini secara efisien. Teknik LORA memanfaatkan struktur peringkat rendah dari perbedaan berat untuk meningkatkan kinerja adaptasi.

Untuk informasi terperinci tentang teknik Lora, Anda dapat merujuk ke kertas Lora.

Untuk melatih model yang diadaptasi Lora, ikuti langkah-langkah ini:

Instal perpustakaan yang diperlukan seperti yang disebutkan di bagian instalasi.

Tentukan dataset pelatihan Anda atau gunakan dataset SST-2 yang disediakan.

Konfigurasikan arsitektur model dan hiperparameter dalam kode.

Jalankan kode pelatihan, dan model akan disesuaikan dengan menggunakan teknik LORA pada dataset Anda.

Setelah pelatihan, Anda dapat menggunakan model yang diadaptasi Lora terlatih untuk inferensi pada input teks baru. Untuk melakukan ini:

Muat model yang diadaptasi Lora yang terlatih seperti yang ditunjukkan dalam kode.

Tokenisasi teks input Anda menggunakan tokenizer model.

Lewati input tokenized ke model untuk klasifikasi sentimen.

Model akan memprediksi apakah teks input memiliki sentimen positif atau negatif.