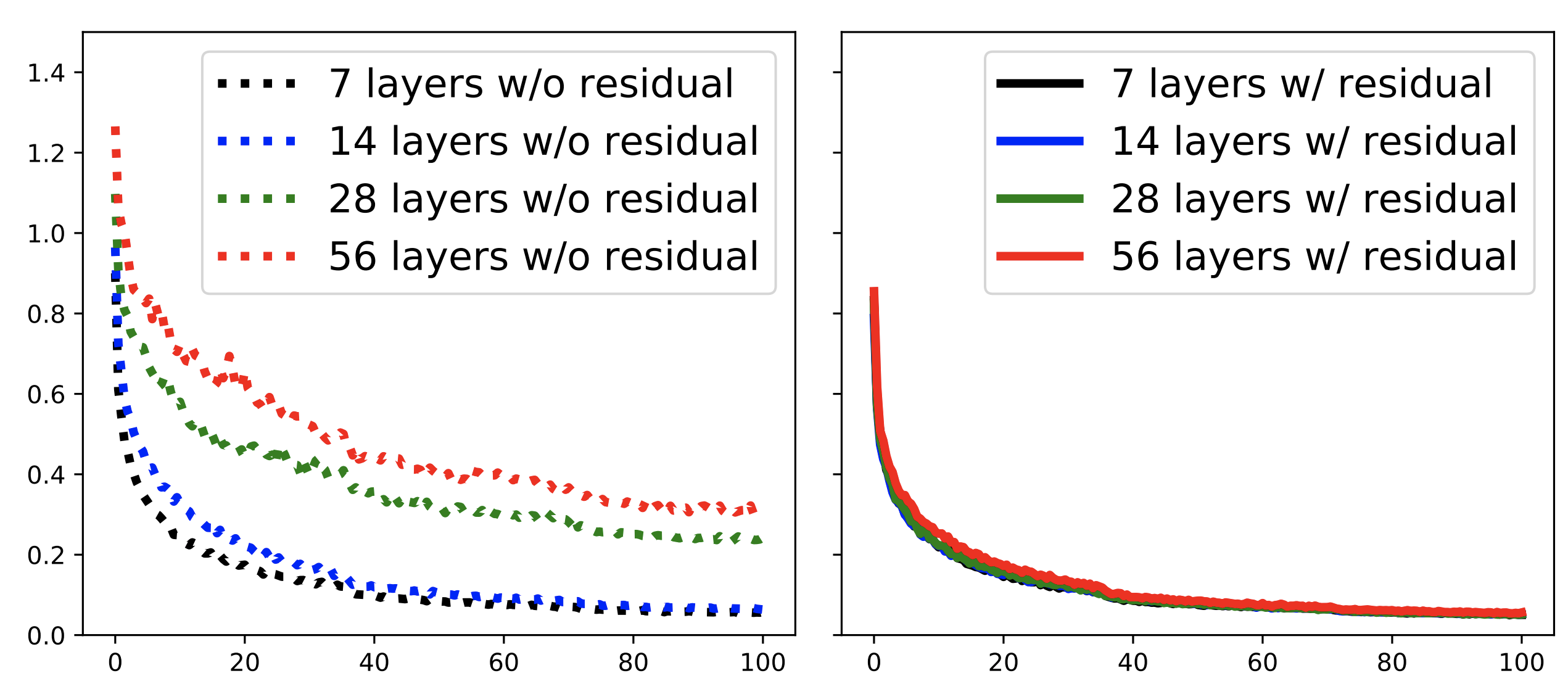

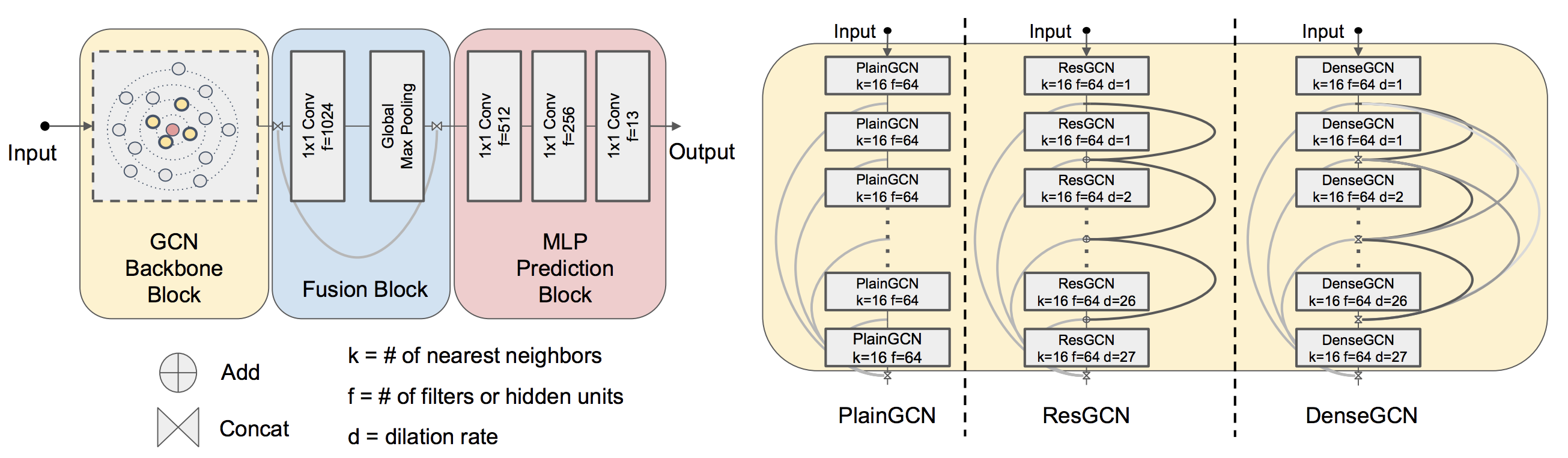

Dans ce travail, nous présentons de nouvelles façons de former avec succès des GCN très profonds. Nous empruntons des concepts à CNNS, principalement des connexions résiduelles / denses et des convolutions dilatées, et les adaptons aux architectures GCN. Grâce à de vastes expériences, nous montrons l'effet positif de ces cadres GCN profonds.

[Project] [Paper] [diapositives] [Code TensorFlow] [Code pytorch]

Nous faisons des expériences approfondies pour montrer comment différents composants (#layers, #filters, #-nearest voisins, dilatation, etc.) affectent DeepGCNs . Nous fournissons également des études d'ablation sur différents types de GCN profonds (MRGCN, EdgeConv, Graphsage et Gin).

Veuillez regarder les détails dans Readme.md de chaque tâche à l'intérieur du dossier examples . Toutes les informations sur le code, les données et les modèles pré-entraînés peuvent y être trouvés.

examples/ogb_eff/ogbn_arxiv_dglInstallez l'environnement en course:

source deepgcn_env_install.sh

.

├── misc # Misc images

├── utils # Common useful modules

├── gcn_lib # gcn library

│ ├── dense # gcn library for dense data (B x C x N x 1)

│ └── sparse # gcn library for sparse data (N x C)

├── eff_gcn_modules # modules for mem efficient gnns

├── examples

│ ├── modelnet_cls # code for point clouds classification on ModelNet40

│ ├── sem_seg_dense # code for point clouds semantic segmentation on S3DIS (data type: dense)

│ ├── sem_seg_sparse # code for point clouds semantic segmentation on S3DIS (data type: sparse)

│ ├── part_sem_seg # code for part segmentation on PartNet

│ ├── ppi # code for node classification on PPI dataset

│ └── ogb # code for node/graph property prediction on OGB datasets

│ └── ogb_eff # code for node/graph property prediction on OGB datasets with memory efficient GNNs

└── ...

Veuillez citer notre papier si vous trouvez quelque chose d'utile,

@InProceedings{li2019deepgcns,

title={DeepGCNs: Can GCNs Go as Deep as CNNs?},

author={Guohao Li and Matthias Müller and Ali Thabet and Bernard Ghanem},

booktitle={The IEEE International Conference on Computer Vision (ICCV)},

year={2019}

}

@article{li2021deepgcns_pami,

title={Deepgcns: Making gcns go as deep as cnns},

author={Li, Guohao and M{"u}ller, Matthias and Qian, Guocheng and Perez, Itzel Carolina Delgadillo and Abualshour, Abdulellah and Thabet, Ali Kassem and Ghanem, Bernard},

journal={IEEE Transactions on Pattern Analysis and Machine Intelligence},

year={2021},

publisher={IEEE}

}

@misc{li2020deepergcn,

title={DeeperGCN: All You Need to Train Deeper GCNs},

author={Guohao Li and Chenxin Xiong and Ali Thabet and Bernard Ghanem},

year={2020},

eprint={2006.07739},

archivePrefix={arXiv},

primaryClass={cs.LG}

}

@InProceedings{li2021gnn1000,

title={Training Graph Neural Networks with 1000 layers},

author={Guohao Li and Matthias Müller and Bernard Ghanem and Vladlen Koltun},

booktitle={International Conference on Machine Learning (ICML)},

year={2021}

}

Licence MIT

Pour plus d'informations, veuillez contacter Guohao Li, Matthias Muller, Guocheng Qian.