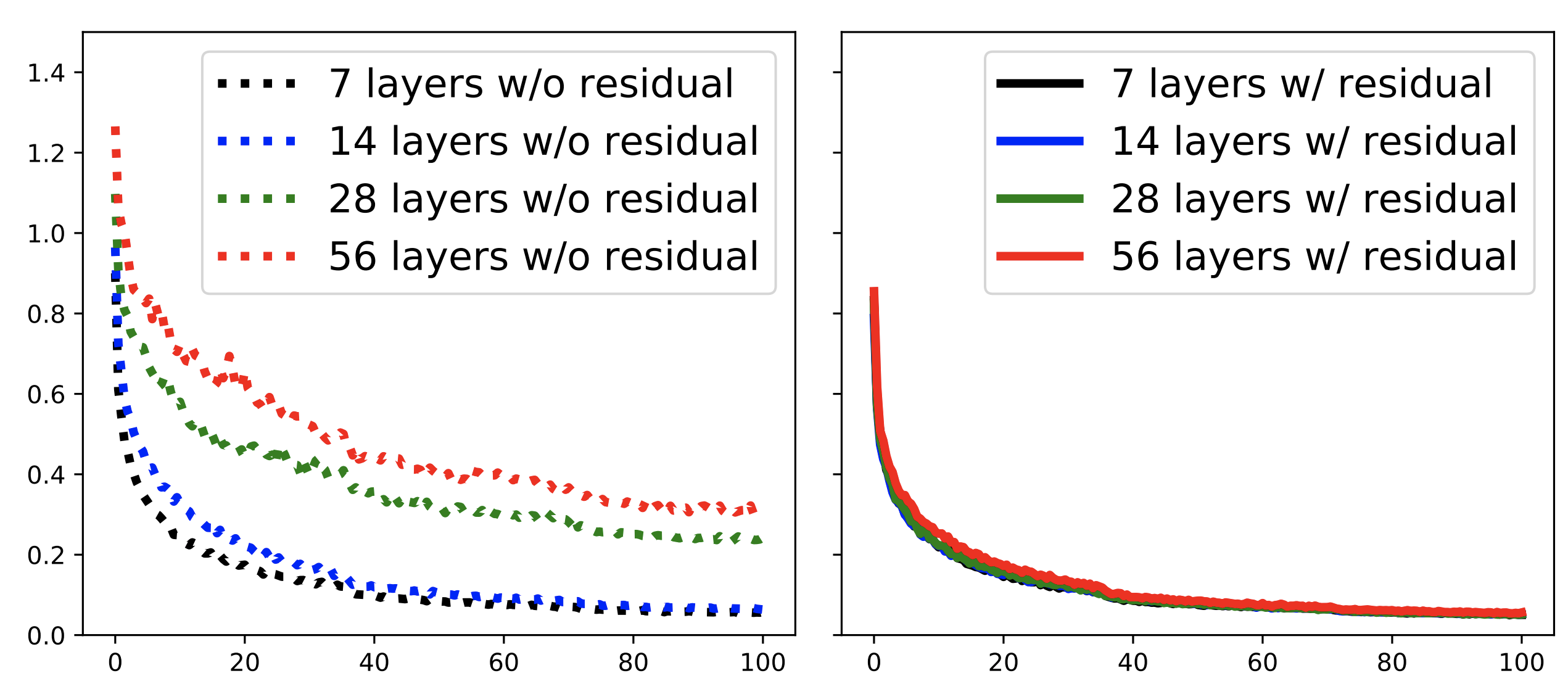

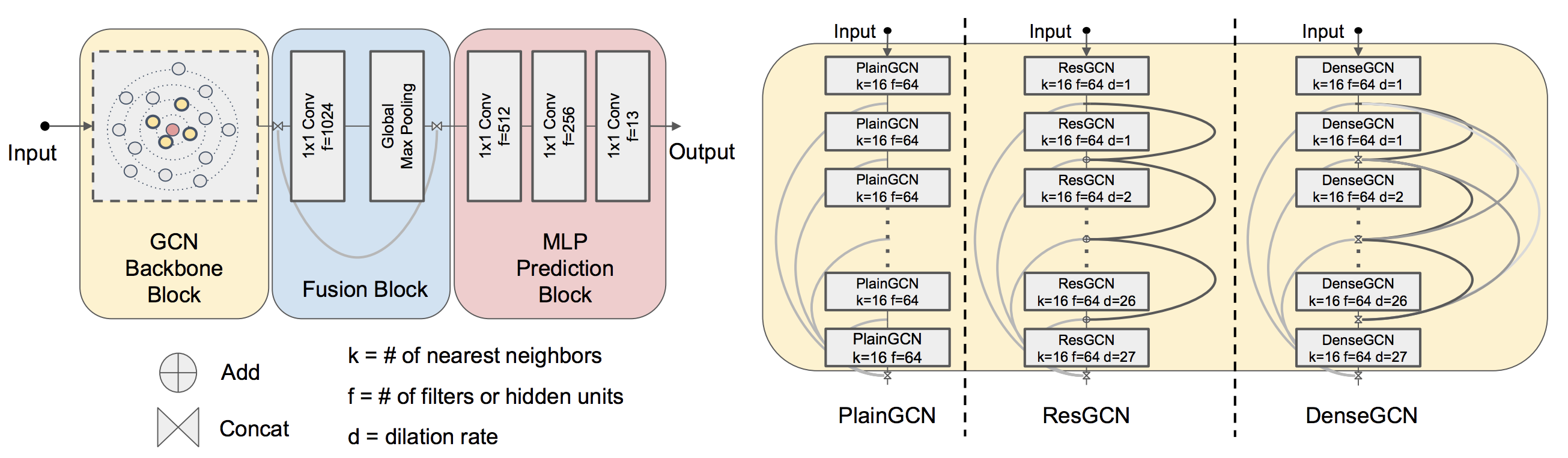

En este trabajo, presentamos nuevas formas de entrenar con éxito GCN muy profundos. Tomamos prestados conceptos de CNN, principalmente conexiones residuales/densas y convoluciones dilatadas, y los adaptamos a las arquitecturas GCN. A través de experimentos extensos, mostramos el efecto positivo de estos marcos GCN profundos.

[Proyecto] [Paper] [Slides] [Código TensorFlow] [Código PyTorch]

Hacemos experimentos extensos para mostrar cómo los diferentes componentes (#Lapas, #filters, #nearest vecinos, dilatación, etc.) afectan DeepGCNs . También proporcionamos estudios de ablación sobre diferentes tipos de GCN profundos (MRGCN, EDGECONV, Graphsage y Gin).

Mire los detalles en Readme.md de cada tarea dentro de la carpeta examples . Allí se puede encontrar toda la información del código, los datos y los modelos previos a la detención.

examples/ogb_eff/ogbn_arxiv_dglInstalar Enviroment corriendo:

source deepgcn_env_install.sh

.

├── misc # Misc images

├── utils # Common useful modules

├── gcn_lib # gcn library

│ ├── dense # gcn library for dense data (B x C x N x 1)

│ └── sparse # gcn library for sparse data (N x C)

├── eff_gcn_modules # modules for mem efficient gnns

├── examples

│ ├── modelnet_cls # code for point clouds classification on ModelNet40

│ ├── sem_seg_dense # code for point clouds semantic segmentation on S3DIS (data type: dense)

│ ├── sem_seg_sparse # code for point clouds semantic segmentation on S3DIS (data type: sparse)

│ ├── part_sem_seg # code for part segmentation on PartNet

│ ├── ppi # code for node classification on PPI dataset

│ └── ogb # code for node/graph property prediction on OGB datasets

│ └── ogb_eff # code for node/graph property prediction on OGB datasets with memory efficient GNNs

└── ...

Por favor cita nuestro documento si encuentra algo útil,

@InProceedings{li2019deepgcns,

title={DeepGCNs: Can GCNs Go as Deep as CNNs?},

author={Guohao Li and Matthias Müller and Ali Thabet and Bernard Ghanem},

booktitle={The IEEE International Conference on Computer Vision (ICCV)},

year={2019}

}

@article{li2021deepgcns_pami,

title={Deepgcns: Making gcns go as deep as cnns},

author={Li, Guohao and M{"u}ller, Matthias and Qian, Guocheng and Perez, Itzel Carolina Delgadillo and Abualshour, Abdulellah and Thabet, Ali Kassem and Ghanem, Bernard},

journal={IEEE Transactions on Pattern Analysis and Machine Intelligence},

year={2021},

publisher={IEEE}

}

@misc{li2020deepergcn,

title={DeeperGCN: All You Need to Train Deeper GCNs},

author={Guohao Li and Chenxin Xiong and Ali Thabet and Bernard Ghanem},

year={2020},

eprint={2006.07739},

archivePrefix={arXiv},

primaryClass={cs.LG}

}

@InProceedings{li2021gnn1000,

title={Training Graph Neural Networks with 1000 layers},

author={Guohao Li and Matthias Müller and Bernard Ghanem and Vladlen Koltun},

booktitle={International Conference on Machine Learning (ICML)},

year={2021}

}

Licencia de MIT

Para obtener más información, comuníquese con Guohao Li, Matthias Muller, Guocheng Qian.