El último modelo de síntesis de voz de Sesame "Modelo de discurso conversacional" (CSM) ha provocado recientemente una acalorada discusión en la plataforma X y se conoce como "un modelo de voz que es como una persona real que habla". Con su sorprendente naturaleza y capacidad de expresión emocional, este modelo no solo hace que los usuarios "ya no puedan distinguir" sus diferencias de los humanos, sino que también afirma haber cruzado con éxito el "efecto de valle extraño" en el campo de la voz. Con la difusión de videos de demostración y comentarios de los usuarios, CSM se está convirtiendo rápidamente en un nuevo punto de referencia para la tecnología de voz de IA.

Cruzando el "Valle del Underworld": el avance tecnológico de CSM

El "efecto del valle del inframundo" se refiere al inconveniente de la incomodidad humana cuando la voz o imagen sintetizada artificialmente está cerca de los humanos reales, pero todavía hay diferencias sutiles. Sesame trata este problema de frente a través de su modelo CSM. X usuario @imxiaohu publicado el 1 de marzo: "¡Hermanos, este nuevo modelo de voz es increíble y ya no se puede distinguir!" Señaló que CSM tiene un excelente rendimiento en la personalidad, la memoria, la capacidad de expresión y la idoneidad contextual, casi eliminando la sensación mecánica de los asistentes de voz tradicionales.

El equipo de sésamo declaró en un artículo de investigación oficial que el objetivo de CSM es lograr una "presencia de voz", lo que hace que las interacciones de voz no solo sean verdaderas y confiables, sino que también entiendan y valoren. Este avance se debe a sus componentes centrales: inteligencia emocional (interpretación y respuesta a las emociones), memoria de contexto (ajuste el resultado basado en el historial de diálogo) y la tecnología de generación de voz de alta fidelidad. Durante la demostración, CSM mostró un tono natural y un lado emocional en la conversación ultra larga, y los usuarios ni siquiera pudieron distinguirlo como AI sin saberlo.

Experiencia de usuario realista

Los comentarios de los usuarios en la plataforma X confirman aún más el sorprendente rendimiento de CSM. @imxiaohu compartió una demostración de diálogo súper larga en la publicación, cubriendo una variedad de escenas y escenarios, y lamentó: "El tono y la emoción están muy, muy cerca de los humanos en algunas expresiones, jajajaja". Mencionó que en ausencia de sugerencias, el resultado de este modelo ha dificultado la distinción entre verdadero y falso. Otro usuario @leeoxiang dijo el 1 de marzo que practicó hablar inglés con CSM durante media hora, y casi no se sintió demora. Dijo que su "costo se hace muy bien y que habrá algo de tono", y su capacidad para hablar activamente también es impresionante.

El entusiasmo de la comunidad no se limita a elogios. Muchos usuarios señalan que la fluidez y la expresión emocional de CSM han superado a los modelos principales existentes como el modo de voz CHATGPT de OpenAI. @OP7418 recomendó que los investigadores presten atención a los artículos técnicos de Sesame el 28 de febrero y enfaticen su sistema de evaluación de autenticidad de voz único, que muestra el rigor técnico del modelo.

Sigue margen de mejora: planes futuros de Sesame

A pesar del impactante desempeño de CSM, Sesame admitió oficialmente que este no es el final. @imxiaohu citó la declaración oficial y dijo: "¡Este no es lo más perfecto, todavía hay mucho margen de mejora!" En la actualidad, CSM admite múltiples idiomas como el inglés, pero como lo señaló @leeoxiang, el chino aún no es compatible. Además, algunos usuarios encontraron en la prueba que el rendimiento del modelo en contextos específicos (como el cambio de idioma extranjero o el canto de música) todavía tiene margen de mejora.

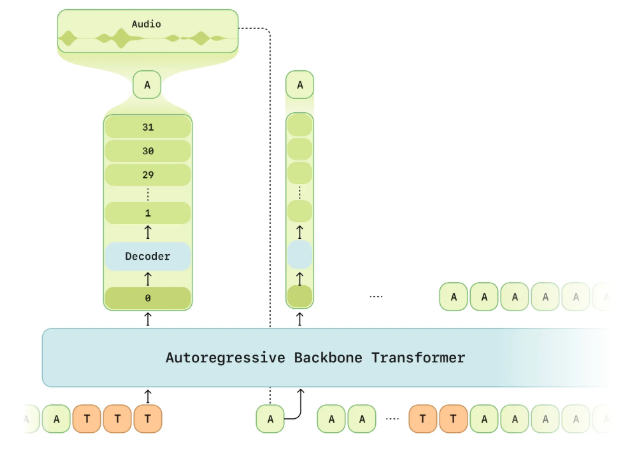

Sesame ha prometido abrir el código de algunos de sus resultados de investigación, y su página de GitHub (Sesameailabs/CSM) muestra que CSM tendrá licencia bajo Apache2.0. Este movimiento ha despertado las expectativas de la comunidad de desarrolladores, y muchas personas esperan promover aún más el desarrollo de la IA de voz a través de una investigación en profundidad sobre su arquitectura.

Impacto de la industria y perspectivas

El debut de CSM no es solo una respuesta técnica al "efecto del valle de Unortal", sino que también establece un nuevo estándar para la interacción de voz de IA. En comparación con Grok, Claude y otros modelos, CSM tiene ventajas particularmente sobresalientes en la expresión de baja latencia y baja latencia y emocional. X User @ablegpt dijo el 2 de marzo: "Si está estudiando AI Voice, se recomienda leer este artículo". Esto refleja el significado inspirador de CSM para el círculo tecnológico.

Con el sésamo planeando expandir el soporte del idioma y optimizar los modelos, se espera que CSM brille en áreas como educación, entretenimiento y compañeros virtuales. A juzgar por la respuesta entusiasta en X, este modelo de voz "Los hermanos creen que es increíble" es redefinir la forma en que las personas interactúan con la IA con un diálogo realista. En el futuro, ¿puede eliminar completamente el "Valle extraño" y convertirse en un verdadero "socio digital"? La respuesta puede estar en la próxima iteración del sésamo.

Dirección de prueba: https://www.sesame.com/research/crossing_the_uncanny_valley_of_voice#demo