Das neueste Sprachsynthese -Modell "Conversational Speech Model" (CSM) von Sesam hat kürzlich eine hitzige Diskussion auf der X -Plattform ausgelöst und ist als "ein Sprachmodell, das wie eine echte Person spricht" bezeichnet. Mit seiner erstaunlichen Natur- und emotionalen Ausdrucksfähigkeit kann dieses Modell nicht nur die Benutzer "ihre Unterschiede zu Menschen nicht mehr unterscheiden", sondern auch behauptet, im Bereich der Stimme den "unheimlichen Valley -Effekt" erfolgreich überschritten zu haben. Mit der Verbreitung von Demonstrationsvideos und dem Benutzerfeedback wird CSM schnell zu einem neuen Benchmark für die AI -Sprachtechnologie.

Überqueren des "Underworld Valley": CSMs technologischer Durchbruch

Der "Underworld Valley Effect" bezieht sich auf die Unannehmlichkeiten des menschlichen Beschwerdens, wenn künstlich synthetisierte Stimme oder Bild den echten Menschen nahe kommt, aber es gibt immer noch subtile Unterschiede. Sesam befasst sich direkt mit diesem Problem über sein CSM-Modell. X user @imxiaohu gepostet am 1. März: "Brüder, dieses brandneue Sprachmodell ist erstaunlich und kann nicht mehr unterschieden werden!" Er wies darauf hin, dass CSM eine hervorragende Leistung in Bezug auf Persönlichkeit, Gedächtnis, Expressionsfähigkeit und kontextbezogene Angemessenheit hat und das mechanische Gefühl traditioneller Sprachassistenten fast beseitigt.

Das Sesam -Team erklärte in einem offiziellen Forschungsartikel, dass das Ziel von CSM darin besteht, eine "Sprachpräsenz" zu erreichen - was Sprachinteraktionen nicht nur wahr und vertrauenswürdig, sondern auch verstehen und bewertet. Dieser Durchbruch ist auf seine Kernkomponenten zurückzuführen: emotionale Intelligenz (Interpretation und Reaktion auf Emotionen), Kontextgedächtnis (Anpassung der Ausgabe basierend auf der Dialoghistorie) und der Hochfidelitäts-Sprachgenerierungstechnologie. Während der Demonstration zeigte CSM im ultra-langen Gespräch einen natürlichen Ton und eine emotionale Seite, und die Benutzer konnten ihn nicht einmal als KI unterscheiden, ohne es zu wissen.

Realistische Benutzererfahrung

Das Feedback der Benutzer zur X -Plattform bestätigt die erstaunliche Leistung von CSM weiter. @imxiaohu teilte eine super lange Dialogdemonstration in der Post mit, die eine Vielzahl von Szenen und Szenarien abdeckte und beklagte: "Der Ton und die Emotionen sind in einigen Ausdrücken sehr, sehr nahe am Menschen, Hahahaha." Er erwähnte, dass die Ausgabe dieses Modells ohne Hinweise es schwierig gemacht hat, zwischen wahr und falsch zu unterscheiden. Ein anderer Benutzer @Leeoxiang sagte am 1. März, dass er eine halbe Stunde lang Englisch mit CSM spricht, und es sei fast keine Verzögerung gefühlt. Er sagte, dass seine "kostenintensive Kosten für sehr gut gearbeitet" und seine Fähigkeit, aktiv zu sprechen, auch ein gewisser Ton geben wird, ist auch beeindruckend.

Die Begeisterung der Gemeinschaft beschränkt sich nicht auf Lob. Viele Benutzer weisen darauf hin, dass die Flüssigkeit und der emotionale Ausdruck von CSM vorhandene Mainstream -Modelle wie den ChatGPT -Sprachmodus von OpenAI übertroffen haben. @OP7418 empfahl, dass Forscher am 28. Februar auf die technischen Artikel von Sesam achten und ihr einzigartiges Voice -Authentizitätsbewertungssystem hervorheben und die technische Genauigkeit des Modells zeigen.

Immer noch Verbesserungsraum: Sesames zukünftige Pläne

Trotz der schockierenden Leistung von CSM gab Sesam offiziell zu, dass dies nicht das Ende ist. @imxiaohu zitierte die offizielle Erklärung und sagte: "Dies ist nicht die perfekteste, es gibt immer noch viel Raum für Verbesserungen!" Gegenwärtig unterstützt CSM mehrere Sprachen wie Englisch, aber wie @leeoxiang betonte, wird Chinese noch nicht unterstützt. Darüber hinaus haben einige Benutzer im Test festgestellt, dass die Leistung des Modells in bestimmten Kontexten (z. B. Fremdsprachenwechsel oder Musiksingen) noch Verbesserungsraum hat.

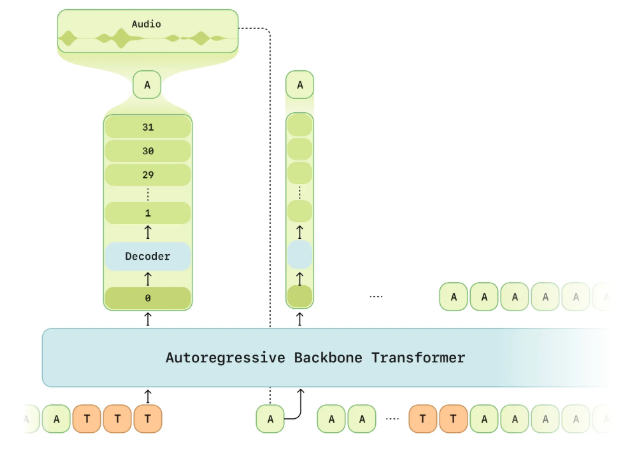

Sesame hat versprochen, einige seiner Forschungsergebnisse zu besiegen, und seine Github -Seite (seameAilabs/csm) zeigt, dass CSM unter der Apache2.0 lizenziert wird. Dieser Schritt hat die Erwartungen von der Entwicklergemeinschaft geweckt, und viele Menschen hoffen, die Entwicklung der Sprachki durch eingehende Forschungen zu ihrer Architektur weiter zu fördern.

Branchenauswirkungen und Aussichten

Das Debüt von CSM ist nicht nur eine technische Reaktion auf den „unortalen Valley -Effekt“, sondern legt auch einen neuen Standard für die AI -Sprachinteraktion fest. Im Vergleich zu Grok, Claude und anderen Modellen hat CSM besonders hervorragende Vorteile in Echtzeit, geringer Latenz und emotionalem Ausdruck. X User @ableGpt sagte am 2. März: "Wenn Sie AI -Stimme studieren, wird dringend empfohlen, diesen Artikel zu lesen." Dies spiegelt die inspirierende Bedeutung von CSM für den Technologiekreis wider.

Mit der Planung von Sesam zur Erweiterung der Sprachunterstützung und der Optimierung von Modellen wird CSM voraussichtlich in Bereichen wie Bildung, Unterhaltung und virtuellen Gefährten glänzen. Nach der enthusiastischen Reaktion auf X zu urteilen, definiert diese "Brüder es für erstaunliches" -Modell neu, wie Menschen mit KI mit realistischem Dialog interagieren. Kann es in Zukunft das "unheimliche Tal" vollständig beseitigen und ein wahrer "digitaler Partner" werden? Die Antwort kann in der nächsten Iteration des Sesams sein.

Testadresse: https://www.seame.com/research/crossing_the_uncanny_valley_of_voice#demo