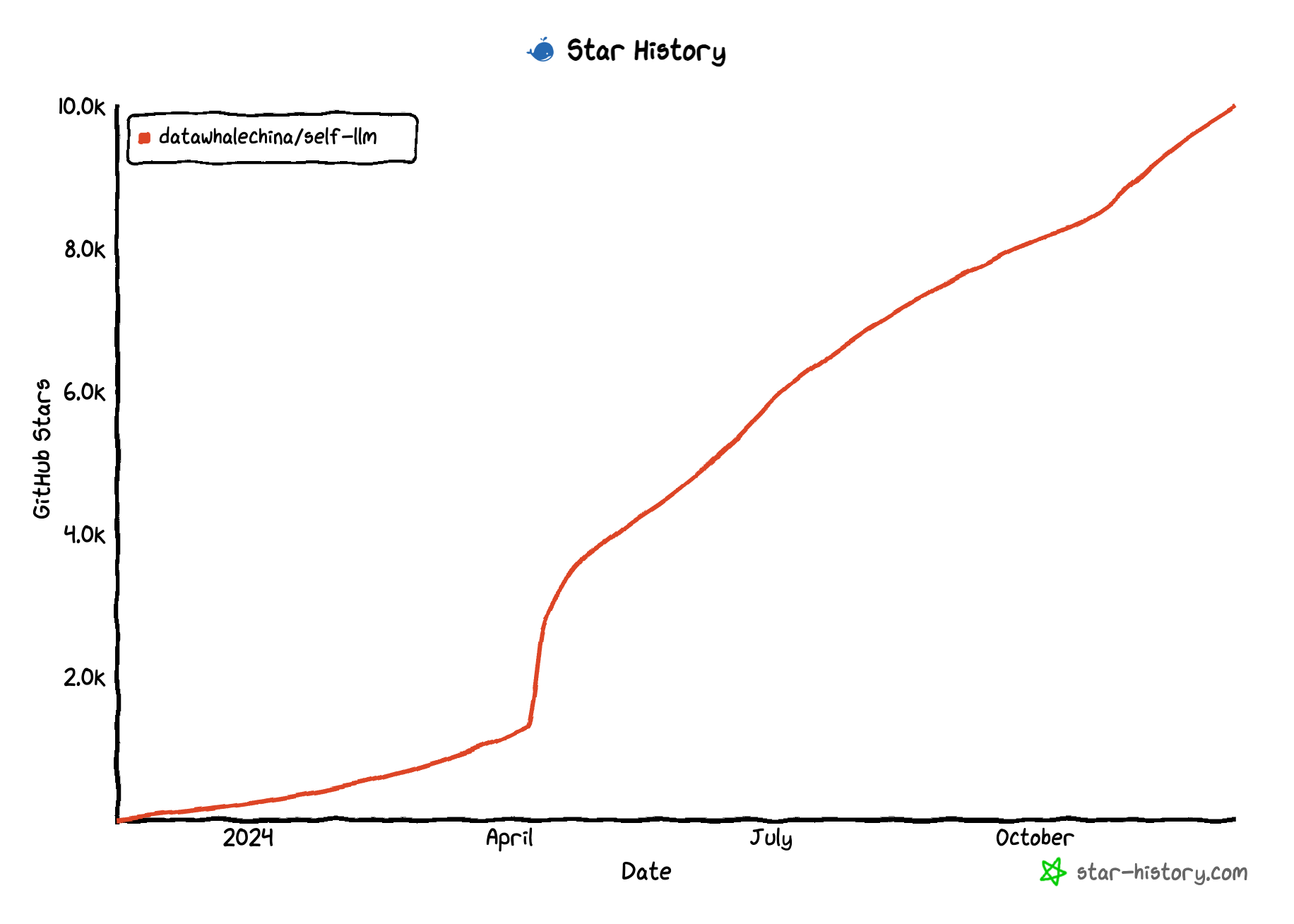

Este proyecto es un tutorial sobre modelos exclusivos de bebés chinos para modelos de código abierto, para principiantes nacionales y basado en plataformas de Linux. Proporciona una guía de procesamiento completo para varios modelos de código abierto, incluida la configuración ambiental, la implementación local, el ajuste eficiente y otras habilidades, simplificando el proceso de implementación, uso y aplicación de modelos de código abierto, lo que permite a los estudiantes e investigadores más comunes usar modelos de código abierto, ayudando a los modelos de código abierto y libres para integrar en la vida de los aprendices ordinarios más rápido.

El contenido principal de este proyecto incluye:

¡El contenido principal del proyecto son los tutoriales, para que más estudiantes y futuros profesionales puedan entenderse y familiarizarse con los métodos de comer grandes modelos de código abierto! Cualquiera puede proponer un problema o enviar un PR para construir y mantener conjuntamente este proyecto.

Los estudiantes que desean participar profundamente pueden contactarnos y lo agregaremos al mantenedor del proyecto.

Sugerencias de aprendizaje: Las sugerencias de aprendizaje para este proyecto son primero aprender la configuración del entorno, luego aprender la implementación y el uso del modelo, y finalmente aprender ajustes finos. Debido a que la configuración del entorno es la base, la implementación y el uso del modelo es la base, y el ajuste fino avanza. Los principiantes pueden elegir QWEN1.5, Internlm2, MinicPM y otros modelos para priorizar el aprendizaje.

Nota: Si los estudiantes desean comprender la composición del modelo del modelo grande y escribir tareas como RAG, Agent y Evs desde cero, pueden aprender otro proyecto de Datawhale. Big Model es un tema candente en el campo del aprendizaje profundo en la actualidad, pero la mayoría de los tutoriales de modelos grandes existentes son solo para enseñarle cómo llamar a las API para completar la aplicación de grandes modelos, y pocas personas pueden explicar la estructura del modelo, el trapo, el agente y la evaluación desde el nivel principal. Por lo tanto, el repositorio proporcionará toda la escritura a mano y no utilizará la forma de llamar a la API para completar las tareas de trapo, agente y evaluación del modelo grande.

Nota: Teniendo en cuenta que algunos estudiantes esperan aprender la parte teórica del modelo grande antes de estudiar este proyecto, si desean estudiar más a fondo la base teórica de LLM y comprender y aplicar más a LLM sobre la base de la teoría, pueden referirse al curso de Datawhale So-Large-LLM.

Nota: Si algún estudiante quiere desarrollar aplicaciones de modelos grandes por sí mismo después de estudiar este curso. Los estudiantes pueden consultar el curso práctico de desarrollo de aplicaciones de modelos de Big Model de Datawhale, que es un tutorial de desarrollo de aplicaciones de gran modelo para novatos. Su objetivo es presentar plenamente el proceso de desarrollo de aplicaciones de gran modelo a los estudiantes en función del servidor de la nube Alibaba y combinado con proyectos de asistente de base de conocimiento personal.

¿Qué es un gran modelo?

Gran Modelo (LLM) se refiere estrechamente a los modelos de procesamiento del lenguaje natural (PNL) entrenados según los algoritmos de aprendizaje profundo. Se usan principalmente en campos como la comprensión del lenguaje natural y la generación. En un sentido amplio, también incluyen modelos grandes de visión artificial (CV), modelos grandes multimodales y computación científica grandes modelos.

La batalla de cientos de modelos está en pleno apogeo, y los LLM de código abierto están emergiendo uno tras otro. Hoy en día, muchos excelentes LLM de código abierto han surgido en el hogar y en el extranjero, como Llama y Alpaca, y a nivel nacional, como Chatglm, Baichuan, Internlm (Scholar Puyu), etc. Open Source LLM admite el despliegue local de usuarios y ajuste de dominios privados. Todos pueden crear su propio gran modelo único basado en Open Source LLM.

Sin embargo, si los estudiantes y usuarios comunes desean usar estos grandes modelos, deben tener ciertas capacidades técnicas para completar la implementación y el uso de los modelos. Para los LLM de código abierto que están emergiendo uno tras otro, es una tarea relativamente desafiante dominar rápidamente los métodos de aplicación de Open Source LLM.

Este proyecto tiene como objetivo realizar primero la implementación, el uso y los tutoriales de ajuste de la LLM de código abierto convencionales en el hogar y en el extranjero en función de la experiencia de los contribuyentes centrales; Después de darnos cuenta de las partes relevantes de la LLM convencional, esperamos reunir a los cocreadores para enriquecer este mundo de LLM de código abierto y crear tutoriales más y más completos para LLM especiales. Chispas salpicadas, convergiendo en el mar.

Esperamos ser la escalera para LLM y el público en general, y abrazar el mundo LLM más magnífico y vasto con el espíritu de código abierto de libertad e igualdad.

Este proyecto es adecuado para los siguientes alumnos:

Este proyecto planea organizar todo el proceso de aplicación LLM de código abierto, incluida la configuración y el uso ambiental, la implementación y la aplicación, el ajuste, etc. Cada parte cubre la corriente principal y las características de código abierto LLM:

Chat-Huanhuan: Chat-Zhen Huan es un modelo de lenguaje de chat que imita el tono de Zhen Huan usando todas las líneas y oraciones sobre Zhen Huan en el guión "La leyenda de Zhen Huan" y el ajuste fino basado en LLM.

Tianji: Tianji es un escenario social basado en sentimientos humanos y estilos mundanos, que cubre todo el proceso de ingeniería de palabras rápida, producción inteligente del cuerpo, adquisición de datos y modelo ajustado, limpieza y uso de datos de trapo, etc.

QWEN2.5 codificador

Qwen2-vl

Qwen2.5

Apple Openelm

Llama3_1-8B-Instructo

GEMMA-2-9B-IT

Yuan2.0

Yuan2.0-m32

Deepseek-coder-v2

Índice de bilibili-1.9b

Qwen2

GLM-4

Qwen 1.5

Google - Gemma

Phi-3

Carácter-6b

LLAMA3-8B-INSTRUCTO

Xverse-7b-chat

Transnormerllm

Modelo de Heart Blue Blue de Bluelm Vivo

Interlm2

Search en profundidad de DeepSeek

Minicpm

Qwen-Audio

Qwen

Mil cosas

Baichuan inteligente

Prostituta

Atom (Llama2)

Chatglm3

Fuente de cambio de pip, conda @ no tiene cebolla, jengibre, ajo

Autodl Open Port @Don't Spicy Ginger y Ajo

Descargar modelo

Emisión && PR

Nota: Las clasificaciones se clasifican por nivel de contribución