liu,di huang,Yunhong Wang

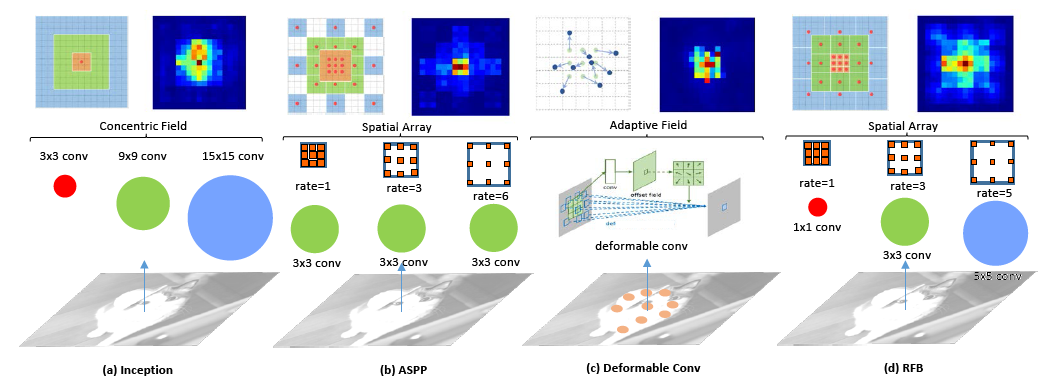

受到人類視覺系統的接收場(RF)結構的啟發,我們提出了一個新型的RF塊(RFB)模塊,該模塊考慮了RF的大小和偏心率之間的關係,以增強特徵的可區分性和魯棒性。我們通過輕巧的CNN模型將RFB模塊進一步將RFB模塊組裝到SSD的頂部,從而構建RFB NET檢測器。您可以使用代碼來訓練/評估RFB NET進行對象檢測。有關更多詳細信息,請參閱我們的ECCV論文。

| 系統 | 地圖 | FPS (Titan X Maxwell) |

|---|---|---|

| 更快的R-CNN(VGG16) | 73.2 | 7 |

| Yolov2(Darknet-19) | 78.6 | 40 |

| R-FCN(RESNET-101) | 80.5 | 9 |

| SSD300*(VGG16) | 77.2 | 46 |

| SSD512*(VGG16) | 79.8 | 19 |

| RFBNET300(VGG16) | 80.7 | 83 |

| RFBNET512(VGG16) | 82.2 | 38 |

| 系統 | 測試-DEV地圖 | 時間(Titan X Maxwell) |

|---|---|---|

| 更快的R-CNN ++(RESNET-101) | 34.9 | 3.36 |

| Yolov2(Darknet-19) | 21.6 | 25ms |

| SSD300*(VGG16) | 25.1 | 22ms |

| SSD512*(VGG16) | 28.8 | 53ms |

| 視網膜500(RESNET-101-FPN) | 34.4 | 90ms |

| RFBNET300(VGG16) | 30.3 | 15ms |

| RFBNET512(VGG16) | 33.8 | 30ms |

| RFBNET512-E(VGG16) | 34.4 | 33ms |

| 系統 | 可可寬道圖 | #參數 |

|---|---|---|

| SSD Mobilenet | 19.3 | 68m |

| RFB Mobilenet | 20.7 | 74m |

如果有助於您的研究,請在您的出版物中引用我們的論文:

@InProceedings{Liu_2018_ECCV,

author = {Liu, Songtao and Huang, Di and Wang, andYunhong},

title = {Receptive Field Block Net for Accurate and Fast Object Detection},

booktitle = {The European Conference on Computer Vision (ECCV)},

month = {September},

year = {2018}

}

./make.sh注意:檢查您在utils/build.py中的GPU架構支持,第131行。默認值為:

'nvcc': ['-arch=sm_52',

conda install opencv注意:對於培訓,我們目前支持VOC和可可。

為了使事情變得簡單,我們提供了簡單的VOC和可可數據集加載程序,該加載程序繼承了torch.utils.data.Dataset ,使其與torchvision.datasets API完全兼容。

# specify a directory for dataset to be downloaded into, else default is ~/data/

sh data/scripts/VOC2007.sh # <directory> # specify a directory for dataset to be downloaded into, else default is ~/data/

sh data/scripts/VOC2012.sh # <directory>從官方網站上安裝/路徑/to/coco的MS可可數據集,默認為〜/data/coco。按照準備小型2014和Valminusminival2014註釋的說明。所有標籤文件(.json)均應在可可/註釋/文件夾下。它應該具有這種基本結構

$COCO /

$COCO /cache/

$COCO /annotations/

$COCO /images/

$COCO /images/test2015/

$COCO /images/train2014/

$COCO /images/val2014/更新:當前的可可數據集已發布新的Train2017和Val2017集,它們只是相同圖像集的新拆分。

首先下載FC降低的VGG-16 Pytorch基本網絡權重:

Mobilenet預先培訓的Basenet從Mobilenet-Caffe移植,其準確率比論文中報導的原始文件略好,重量文件可在以下網址提供:https://drive.google.com/open?id=13azsapybbbdjzfgiDqn1Inblpsddxcck14或baiduyun verter。

默認情況下,我們假設您已在RFBNet/weights dir中下載了該文件:

mkdir weights

cd weights

wget https://s3.amazonaws.com/amdegroot-models/vgg16_reducedfc.pthtrain_RFB.py中列出的參數指定為標誌或手動更改它們即可。 python train_RFB.py -d VOC -v RFB_vgg -s 300 train_RFB.py了解選項),從檢查站獲取培訓。評估訓練有素的網絡:

python test_RFB.py -d VOC -v RFB_vgg -s 300 --trained_model /path/to/model/weights默認情況下,它將在VOC2007測試或可可Minival2014上直接輸出地圖結果。對於VOC2012測試和可可Test-DEV結果,您可以在test_RFB.py文件中手動更改數據集,然後保存檢測結果並提交給服務器。