Songtao Liu, Di Huang, Yunhong Wang

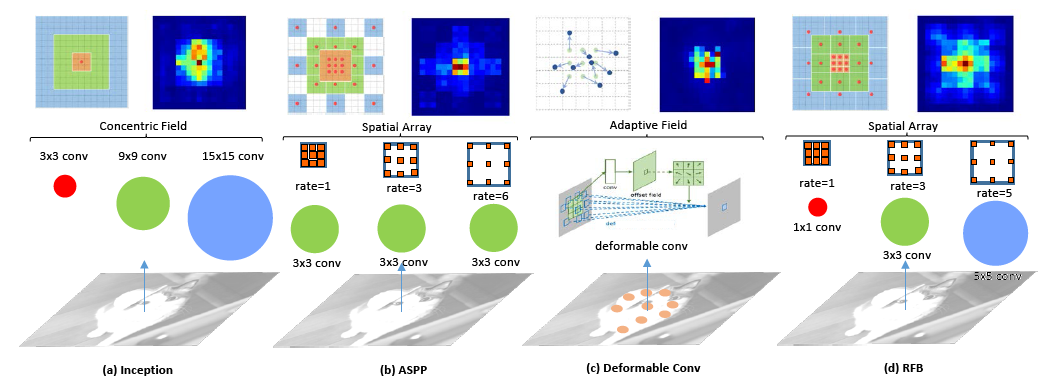

인간 시각 시스템에서 수용 필드 (RFS)의 구조에서 영감을 얻은 우리는 RFS의 크기와 편심 사이의 관계를 고려하여 기능의 판별 성과 견고성을 향상시키는 새로운 RF 블록 (RFB) 모듈을 제안합니다. RFB 순 검출기를 구성하여 경량 CNN 모델을 사용하여 RFB 모듈을 SSD 상단에 추가로 조립합니다. 코드를 사용하여 객체 감지를 위해 RFB NET을 교육/평가할 수 있습니다. 자세한 내용은 ECCV 용지를 참조하십시오.

| 체계 | 지도 | FPS (Titan X Maxwell) |

|---|---|---|

| 더 빠른 R-CNN (VGG16) | 73.2 | 7 |

| Yolov2 (DarkNet-19) | 78.6 | 40 |

| R-FCN (RESNET-101) | 80.5 | 9 |

| SSD300* (VGG16) | 77.2 | 46 |

| SSD512* (VGG16) | 79.8 | 19 |

| RFBNET300 (VGG16) | 80.7 | 83 |

| RFBNET512 (VGG16) | 82.2 | 38 |

| 체계 | 테스트 데브 맵 | 시간 (Titan X Maxwell) |

|---|---|---|

| 더 빠른 R-CNN ++ (RESNET-101) | 34.9 | 3.36S |

| Yolov2 (DarkNet-19) | 21.6 | 25ms |

| SSD300* (VGG16) | 25.1 | 22ms |

| SSD512* (VGG16) | 28.8 | 53ms |

| Retinanet500 (Resnet-101-FPN) | 34.4 | 90ms |

| RFBNET300 (VGG16) | 30.3 | 15ms |

| RFBNET512 (VGG16) | 33.8 | 30ms |

| RFBNET512-E (VGG16) | 34.4 | 33ms |

| 체계 | 코코 미니발 맵 | #parameters |

|---|---|---|

| SSD Mobilenet | 19.3 | 6.8m |

| RFB Mobilenet | 20.7 | 7.4m |

연구에 도움이된다면 간행물에서 본 논문을 인용하십시오.

@InProceedings{Liu_2018_ECCV,

author = {Liu, Songtao and Huang, Di and Wang, andYunhong},

title = {Receptive Field Block Net for Accurate and Fast Object Detection},

booktitle = {The European Conference on Computer Vision (ECCV)},

month = {September},

year = {2018}

}

./make.sh참고 : Utils/build.py, 131 행에서 GPU 아키텍처 지원을 확인하십시오. 기본값은 다음과 같습니다.

'nvcc': ['-arch=sm_52',

conda install opencv참고 : 훈련을 위해 현재 VOC와 Coco를 지원합니다.

일을 쉽게하기 위해 torchvision.datasets API와 완전히 호환되는 torch.utils.data.Dataset 을 상속하는 간단한 VOC 및 Coco 데이터 세트 로더를 제공합니다.

# specify a directory for dataset to be downloaded into, else default is ~/data/

sh data/scripts/VOC2007.sh # <directory> # specify a directory for dataset to be downloaded into, else default is ~/data/

sh data/scripts/VOC2012.sh # <directory>공식 웹 사이트에서/path/to/coco에 MS Coco 데이터 세트를 설치하십시오. 기본값은 ~/data/coco입니다. Minival2014 및 Valminusminival2014 주석을 준비하는 지침에 따라. 모든 레이블 파일 (.json)은 Coco/ Annotations/ Folder 아래에 있어야합니다. 이 기본 구조가 있어야합니다

$COCO /

$COCO /cache/

$COCO /annotations/

$COCO /images/

$COCO /images/test2015/

$COCO /images/train2014/

$COCO /images/val2014/업데이트 : 현재 Coco 데이터 세트는 동일한 이미지 세트의 새로운 스플릿 인 New Train2017 및 Val2017 세트를 출시했습니다.

먼저 FC- 감소 된 VGG-16 Pytorch Base Network weights at : https://s3.amazonaws.com/amdegroot-models/vgg16_reducedfc.pth 또는 Baiduyun 드라이버에서 다운로드하십시오.

Mobilenet 사전 훈련 된 Basenet은 Mobilenet-Caffe에서 포팅되며, 논문에보고 된 원래의 원본보다 약간 더 나은 정확도를 달성하면 https://drive.google.com/open?id=13azsapybbbdjzfgidqn1inblpsdxck14 또는 Baiduyun Driver에서 가중치 파일을 사용할 수 있습니다.

기본적으로 RFBNet/weights Dir에서 파일을 다운로드했다고 가정합니다.

mkdir weights

cd weights

wget https://s3.amazonaws.com/amdegroot-models/vgg16_reducedfc.pthtrain_RFB.py 에 나열된 매개 변수를 플래그로 지정하거나 수동으로 변경하십시오. python train_RFB.py -d VOC -v RFB_vgg -s 300 train_RFB.py 참조).훈련 된 네트워크를 평가하려면 :

python test_RFB.py -d VOC -v RFB_vgg -s 300 --trained_model /path/to/model/weights 기본적으로 VOC2007 Test 또는 Coco Minival2014 에서 맵 결과를 직접 출력합니다. VOC2012 Test 및 Coco Test-DEV 결과의 경우 test_RFB.py 파일에서 데이터 세트를 수동으로 변경 한 다음 감지 결과를 저장하고 서버에 제출할 수 있습니다.