Multiplex CoT

1.0.0

提示

您知道信息學奧運選手“ Pinkrabbit”?我們鼓勵您加入他的粉絲群。 QQ744648573

通過採用及時方法,LLM可以達到與LRM密切相似的效果,而無需進行其他培訓。

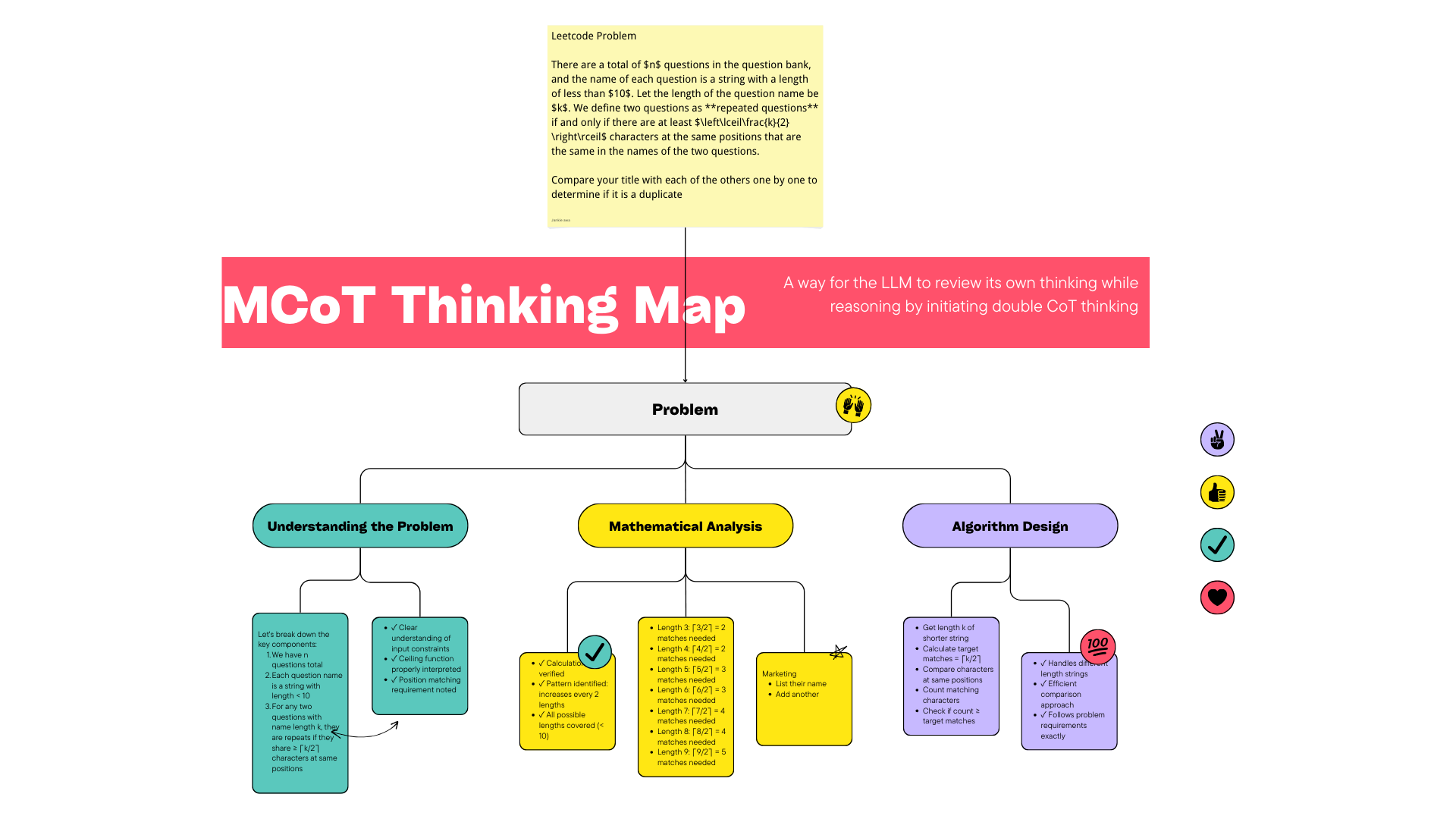

在推理和決策的背景下,多重COT(思想鏈)使該模型能夠模擬一種自我反省的形式,從而提高了其產生相干,邏輯答案的能力。該方法通過提示LLM首先生成推理鏈(COT),然後迭代地審查和完善它,從而啟動第二輪推理來起作用,這是對第一輪的批評或審查。

運行Multiplex_CoT.ipynb 。

請參閱example.py 。