Multiplex CoT

1.0.0

ヒント

情報提供者のオリンピックの「ピンクラビット」を知っていますか?彼のファン層に加わることをお勧めします。 QQ744648573

迅速な方法を使用することにより、LLMは追加のトレーニングを必要とせずにLRMの効果によく似た効果を達成できます。

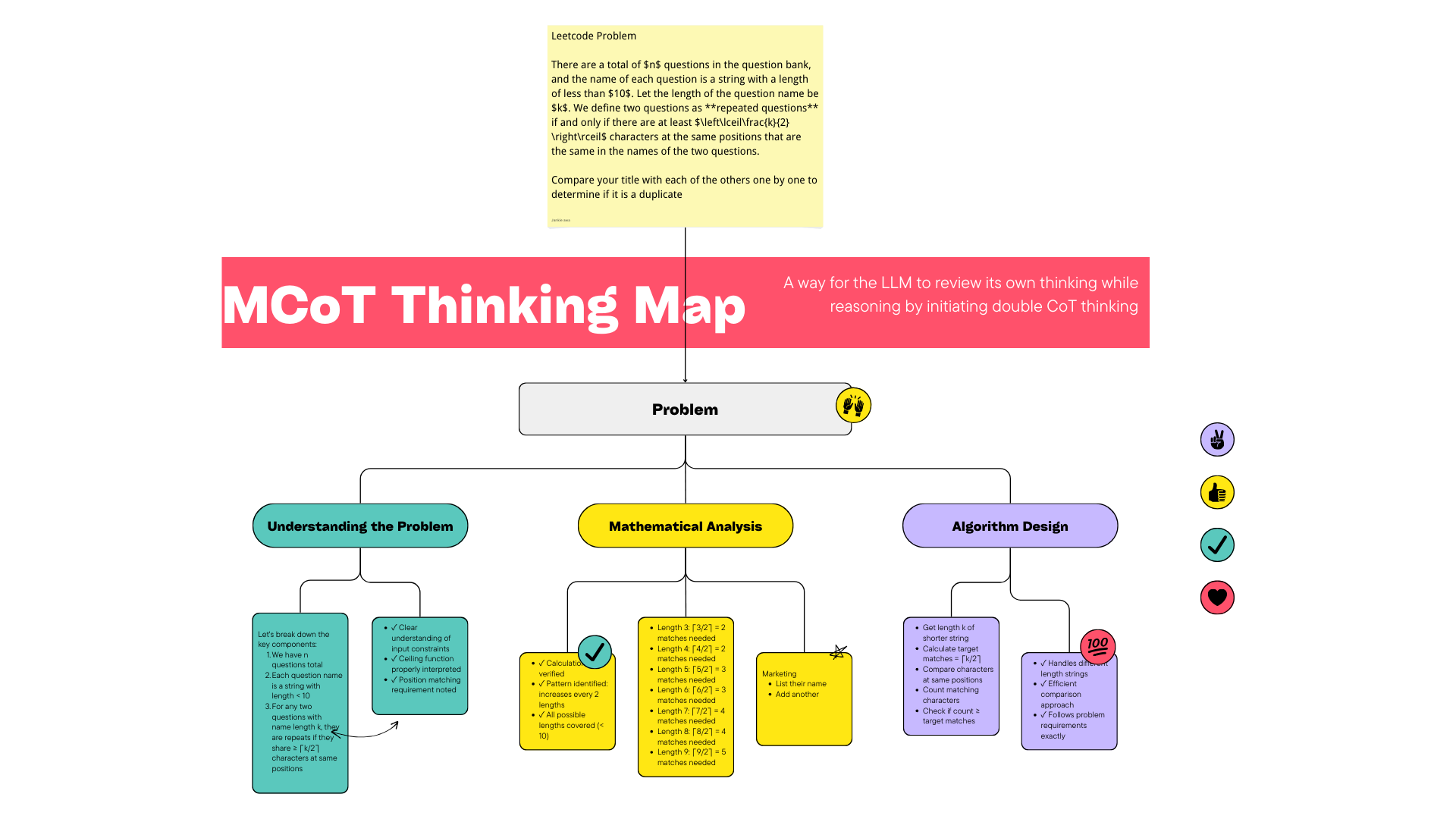

推論と意思決定の文脈では、Multiplex Cot(思考チェーン)により、モデルは自己反省の形式をシミュレートでき、コヒーレントで論理的な答えを生成する能力を向上させることができます。この方法は、LLMに最初に一連の推論(COT)を生成するように促すことで機能し、次に、最初の批評またはレビューとして機能する2回目の推論を開始することにより、それを繰り返しレビューおよび改良します。

Multiplex_CoT.ipynbを実行します。

example.pyを参照してください。