Компания ByteDance недавно выпустила модель глубины нового поколения Depth Anything V2, которая совершила значительный прорыв в области монокулярной оценки глубины. По сравнению с предыдущим поколением версия V2 была значительно улучшена с точки зрения точности детализации, надежности и эффективности, а ее скорость более чем в десять раз выше, чем у модели на основе Stable Diffusion. Прогресс этой технологии отражается не только в оптимизации самой модели, но и в ее инновационных методах обучения, которые открывают новые возможности в области компьютерного зрения. В статье подробно описаны ключевые особенности, методы обучения и широкий спектр сценариев применения Depth Anything V2, что позволяет нам получить более глубокое понимание развития этой технологии.

Новости с сайта ChinaZ.com от 14 июня: ByteDance выпустила новое поколение модели глубины Depth Anything V2, в которой достигнуты значительные улучшения производительности в области монокулярной оценки глубины. По сравнению с Depth Anything V1 предыдущего поколения, версия V2 имеет более мелкие детали и более высокую надежность, а также значительно повышает эффективность, более чем в 10 раз быстрее, чем модель на основе стабильной диффузии.

Ключевые особенности:

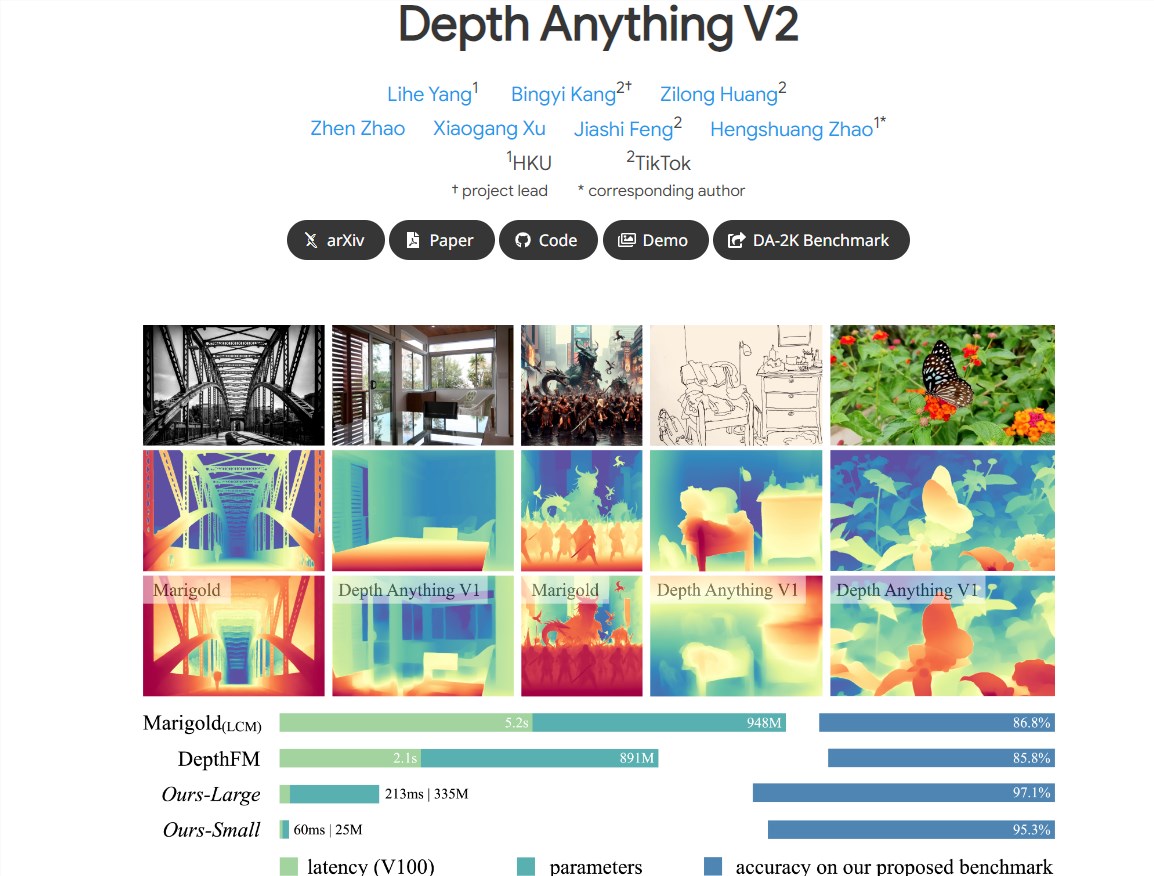

Более мелкие детали: модель V2 детально оптимизирована, обеспечивая более точные прогнозы глубины.

Высокая эффективность и точность: по сравнению с моделями, построенными на базе SD, V2 значительно улучшила эффективность и точность.

Поддержка многомасштабных моделей: предоставляет модели разных масштабов с параметрами от 25M до 1,3B для адаптации к различным сценариям применения.

Ключевые практики: повышение производительности моделей за счет замены реальных изображений синтетическими, расширения возможностей моделей учителей и использования крупномасштабных изображений с псевдоаннотациями для обучения моделям учащихся.

Три ключевых метода повышения производительности модели:

Использование синтетических изображений: все аннотированные реальные изображения заменяются синтетическими изображениями, что повышает эффективность обучения модели.

Расширенные возможности модели учителя. За счет расширения возможностей модели учителя улучшаются возможности модели по обобщению.

Применение псевдоаннотированных изображений. Используйте крупномасштабные псевдоаннотированные реальные изображения в качестве моста для обучения моделям учащихся и повышения надежности модели.

Поддержка широкого спектра сценариев применения:

Чтобы удовлетворить потребности широкого спектра приложений, исследователи предоставляют модели в разных масштабах и используют их возможности обобщения для точной настройки с помощью метрических меток глубины.

Разнообразный эталон оценки, содержащий редкие глубокие аннотации, создан для облегчения будущих исследований.

Методы обучения на основе синтетических и реальных изображений:

Исследователи сначала обучили самую большую модель учителя на синтетических изображениях, затем создали высококачественные псевдометки для крупномасштабных немаркированных реальных изображений и обучили модели учеников на этих псевдомаркированных реальных изображениях.

В процессе обучения используется 595 тысяч синтетических изображений и более 62 миллионов реальных псевдоразмеченных изображений.

Запуск модели Depth Anything V2 демонстрирует инновационные возможности ByteDance в области технологий глубокого обучения. Ее эффективные и точные рабочие характеристики указывают на то, что модель имеет широкий потенциал применения в области компьютерного зрения.

Адрес проекта: https://length-anything-v2.github.io/

В целом, появление модели Depth Anything V2 знаменует собой значительный шаг вперед в технологии монокулярной оценки глубины. Его высокая эффективность, точность и широкие перспективы применения дают ему огромный потенциал развития в области компьютерного зрения в будущем, и стоит с нетерпением ожидать его внедрения в большем количестве сценариев применения.