ByteDance baru-baru ini merilis model kedalaman generasi baru, Depth Anything V2, yang telah membuat terobosan signifikan dalam bidang estimasi kedalaman monokuler. Dibandingkan dengan generasi sebelumnya, versi V2 telah ditingkatkan secara signifikan dalam hal akurasi detail, ketahanan dan efisiensi, serta kecepatannya sepuluh kali lebih cepat dibandingkan model yang berbasis Stable Diffusion. Kemajuan teknologi ini tidak hanya tercermin dalam optimalisasi model itu sendiri, tetapi juga dalam metode pelatihan inovatifnya, yang membawa kemungkinan-kemungkinan baru di bidang visi komputer. Artikel ini merinci fitur-fitur utama, metode pelatihan, dan berbagai skenario penerapan Depth Anything V2, memungkinkan kita memperoleh pemahaman mendalam tentang kemajuan teknologi ini.

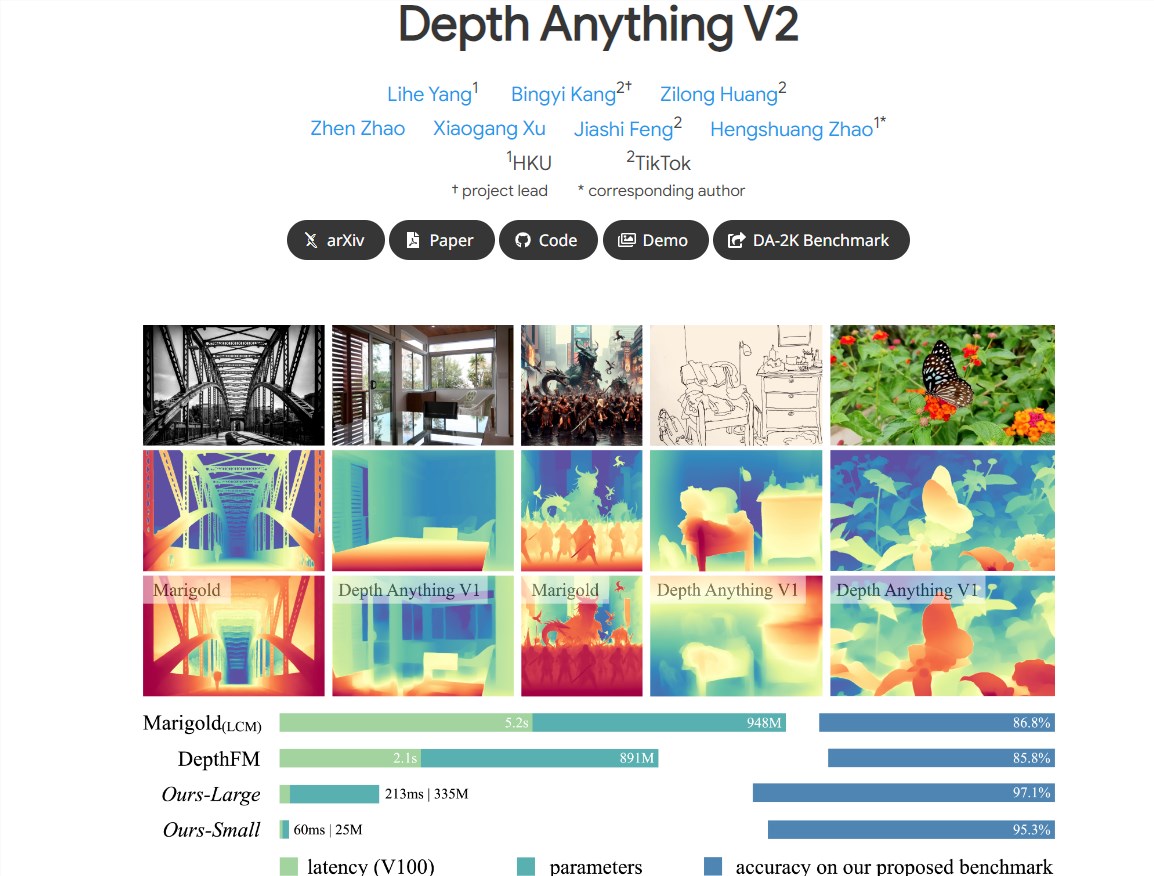

Berita dari ChinaZ.com pada 14 Juni: ByteDance telah merilis model kedalaman Depth Anything V2 generasi baru, yang telah mencapai peningkatan kinerja signifikan di bidang estimasi kedalaman monokuler. Dibandingkan dengan Depth Anything V1 generasi sebelumnya, versi V2 memiliki detail yang lebih halus dan ketahanan yang lebih kuat, sekaligus meningkatkan efisiensi secara signifikan, lebih dari 10 kali lebih cepat dibandingkan model berbasis Difusi Stabil.

Fitur utama:

Detail yang lebih baik: Model V2 dioptimalkan secara detail, memberikan prediksi kedalaman yang lebih baik.

Efisiensi dan akurasi tinggi: Dibandingkan dengan model yang dibuat berdasarkan SD, V2 telah meningkatkan efisiensi dan akurasi secara signifikan.

Dukungan model multi-skala: Menyediakan model skala berbeda dengan parameter mulai dari 25M hingga 1,3B untuk beradaptasi dengan skenario aplikasi yang berbeda.

Praktik utama: Meningkatkan performa model dengan mengganti gambar nyata dengan gambar sintetis, memperluas kapasitas model pengajar, dan menggunakan gambar beranotasi semu berskala besar untuk mengajarkan model siswa.

Tiga praktik utama untuk meningkatkan kinerja model:

Penggunaan gambar sintetis: Semua gambar nyata yang diberi anotasi diganti dengan gambar sintetis, sehingga meningkatkan efisiensi pelatihan model.

Kapasitas model guru yang diperluas: Dengan memperluas kapasitas model guru, kemampuan generalisasi model ditingkatkan.

Penerapan gambar beranotasi semu: Gunakan gambar nyata beranotasi semu berskala besar sebagai jembatan untuk mengajarkan model kepada siswa dan meningkatkan ketahanan model.

Dukungan untuk berbagai skenario aplikasi:

Untuk memenuhi kebutuhan berbagai aplikasi, peneliti menyediakan model pada skala berbeda dan memanfaatkan kemampuan generalisasinya untuk menyempurnakan label kedalaman metrik.

Tolok ukur evaluasi yang beragam yang berisi anotasi mendalam yang jarang dibuat untuk memfasilitasi penelitian di masa depan.

Metode pelatihan berdasarkan gambar sintetik dan nyata:

Para peneliti pertama-tama melatih model guru terbesar pada gambar sintetis, kemudian membuat label semu berkualitas tinggi untuk gambar nyata tak berlabel berskala besar, dan melatih model siswa pada gambar nyata berlabel semu tersebut.

Proses pelatihan menggunakan 595 ribu gambar sintetis dan 62 juta+ gambar berlabel semu asli.

Peluncuran model Depth Anything V2 menunjukkan kemampuan inovatif ByteDance di bidang teknologi pembelajaran mendalam. Karakteristik kinerjanya yang efisien dan akurat menunjukkan bahwa model tersebut memiliki potensi penerapan yang luas di bidang visi komputer.

Alamat proyek: https://kedalaman-anything-v2.github.io/

Secara keseluruhan, kemunculan model Depth Anything V2 menandai lompatan maju yang signifikan dalam teknologi estimasi kedalaman monokuler. Efisiensi tinggi, akurasi, dan prospek penerapannya yang luas memberikan potensi pengembangan yang besar di bidang visi komputer di masa depan, dan penerapannya dalam lebih banyak skenario aplikasi patut dinantikan.