OpenAI lançou seu mais recente modelo de revisão de conteúdo multimodal "omni-moderation-latest" em 26 de setembro. Este modelo é baseado na tecnologia GPT-4o e pode identificar com mais precisão conteúdo prejudicial de texto e imagem, especialmente na identificação de conteúdo que não seja em inglês. Excelente desempenho. Essa mudança melhorará significativamente a eficiência e a precisão do sistema de revisão de conteúdo, fornecerá aos desenvolvedores ferramentas mais poderosas e construirá um ambiente de usuário mais seguro. O editor de Downcodes lhe dará uma compreensão aprofundada das vantagens e características deste novo modelo.

Na era digital, os problemas de segurança de conteúdo estão se tornando cada vez mais graves. O modelo "omni-moderação mais recente" lançado pela OpenAI é, sem dúvida, um passo importante para enfrentar este desafio. Este modelo suporta revisão multimodal de texto e imagens, com precisão significativamente melhorada em comparação com modelos anteriores, e adicionou capacidades de detecção de conteúdo ilegal e violento. Para conteúdo que não seja o inglês, a sua taxa de precisão aumentou 42%, especialmente em idiomas com poucos recursos. A vantagem do modelo é que ele é gratuito e de fácil acesso, e os desenvolvedores podem integrá-lo facilmente em seus próprios aplicativos.

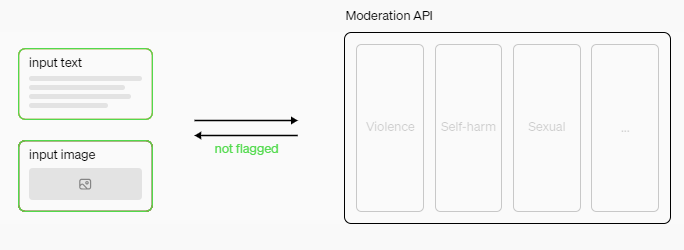

O destaque do novo modelo é que ele suporta moderação de entrada de texto e imagem, especialmente ao processar conteúdo em outro idioma .

Em comparação com o modelo de moderação anterior, “omni-moderation-latest” não só melhora a precisão da identificação, mas também aumenta a capacidade de detectar mais conteúdos nocivos. Ele pode avaliar diversas categorias, como violência, automutilação e conteúdo sexual, garantindo que os usuários possam se comunicar em um espaço mais seguro.

Desde que a OpenAI lançou a API de moderação de conteúdo (API de Moderação) em 2022, a quantidade e o tipo de conteúdo que o sistema de moderação automatizado precisa processar continuou a aumentar, especialmente à medida que mais e mais aplicações de inteligência artificial entram na fase de produção em massa. Hoje, muitas empresas, como Grammarly e ElevenLabs, estão usando esta API para proteger os usuários e evitar conteúdo impróprio.

As vantagens do novo modelo refletem-se em muitos aspectos:

Em primeiro lugar, permite a classificação multimodal de conteúdos nocivos, avaliando combinações de imagens e texto para identificar riscos relacionados com a violência e o abuso sexual.

Em segundo lugar, o modelo adiciona dois novos tipos de revisão de texto, nomeadamente conteúdos relacionados com ilegalidade e violência, o que aumenta ainda mais as capacidades de revisão.

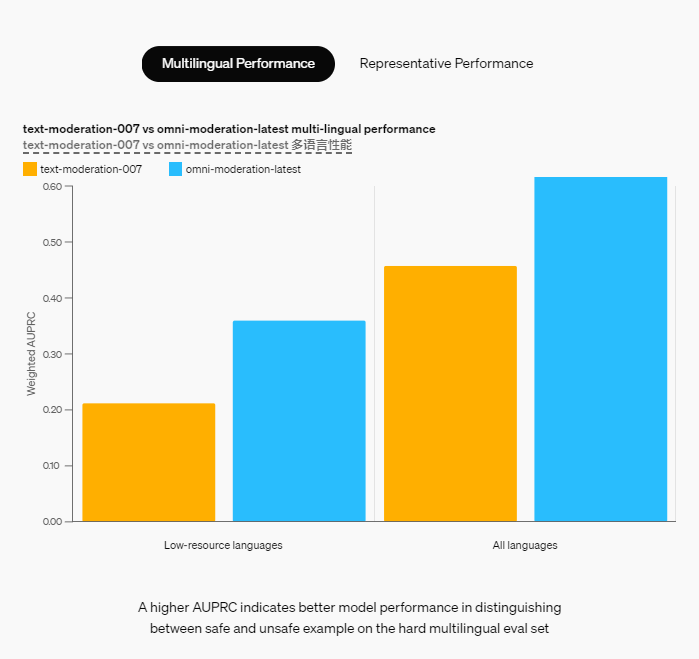

Além disso, para a detecção de conteúdo que não seja em inglês, a precisão foi bastante melhorada. O teste mostra que a taxa de precisão em 40 idiomas aumentou 42%, especialmente em idiomas de poucos recursos.

Para os desenvolvedores, esse novo modelo de revisão ainda é uma API gratuita de revisão de conteúdo que pode ser facilmente acessada. A OpenAI espera que esta atualização permita que mais desenvolvedores aproveitem os resultados de pesquisas e sistemas de segurança mais recentes para criar uma experiência online mais amigável.

Blog oficial: https://openai.com/index/upgrading-the-moderation-api-with-our-new-multimodal-moderation-model/

** Destaques: **

? O novo modelo “omni-moderation-latest” é baseado na tecnologia GPT-4o e suporta revisão multimodal de imagens.

?A precisão da detecção para 40 idiomas aumentou 42%, especialmente em idiomas com poucos recursos.

? Dois novos tipos de revisão de texto foram adicionados para melhorar a capacidade de identificar conteúdo ilegal e violento.

Em suma, o modelo “omni-moderação mais recente” da OpenAI trouxe um progresso significativo no campo da moderação de conteúdo. Suas capacidades multimodais, maior precisão e suporte para vários idiomas irão efetivamente melhorar o nível de segurança de conteúdo online. Esta é uma boa notícia para desenvolvedores e usuários. O editor do Downcodes espera que a OpenAI traga tecnologias mais inovadoras no futuro para construir conjuntamente um ambiente de Internet mais seguro, saudável e amigável.