OpenAI は、最新のマルチモーダル コンテンツ レビュー モデル「omni-moderation-latest」を 9 月 26 日にリリースしました。このモデルは GPT-4o テクノロジーに基づいており、特に英語以外のコンテンツの識別において、有害なテキストと画像コンテンツをより正確に識別できます。優れたパフォーマンス。この動きにより、コンテンツ レビュー システムの効率と精度が大幅に向上し、開発者により強力なツールが提供され、より安全なユーザー環境が構築されます。 Downcodes のエディターでは、この新しいモデルの利点と機能を詳しく理解できます。

デジタル時代において、コンテンツのセキュリティ問題はますます深刻になっています。OpenAI が開始した「オムニモデレーション最新」モデルは、この課題に対処するための重要なステップであることは間違いありません。このモデルは、テキストと画像のマルチモーダル レビューをサポートし、以前のモデルと比較して精度が大幅に向上し、違法および暴力的なコンテンツの検出機能が追加されました。英語以外のコンテンツについては、特にリソースの少ない言語で正確率が 42% 向上しました。このモデルの利点は、無料でアクセスしやすく、開発者がそれを独自のアプリケーションに簡単に統合できることです。

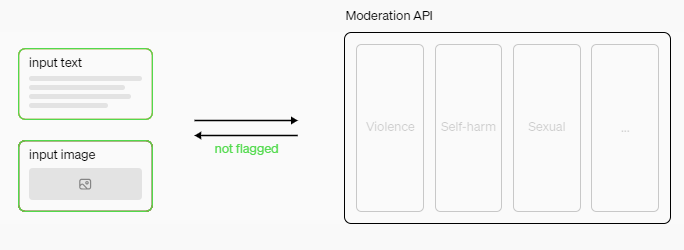

新しいモデルのハイライトは、特に英語以外のコンテンツを処理する場合に、テキストと画像入力のモデレーションをサポートしていることです。

以前のモデレーション モデルと比較して、「オムニモデレーション最新」では識別の精度が向上するだけでなく、より有害なコンテンツを検出する能力も向上します。暴力、自傷行為、性的コンテンツなどの複数のカテゴリを評価できるため、ユーザーがより安全な空間でコミュニケーションできるようになります。

OpenAI が 2022 年にコンテンツ モデレーション API (Moderation API) を発表して以来、特に多くの人工知能アプリケーションが量産段階に入るにつれて、自動モデレーション システムが処理する必要があるコンテンツの量と種類は増加し続けています。現在、Grammarly や Celebrities などの多くの企業がこの API を使用してユーザーを保護し、不適切なコンテンツを防止しています。

新しいモデルの利点はさまざまな面で反映されています。

まず、有害なコンテンツをマルチモーダルに分類し、画像とテキストの組み合わせを評価して暴力や性的虐待に関連するリスクを特定できます。

第 2 に、このモデルには 2 つの新しいタイプのテキスト レビュー (違法と暴力に関連するコンテンツ) が追加され、レビュー機能がさらに強化されます。

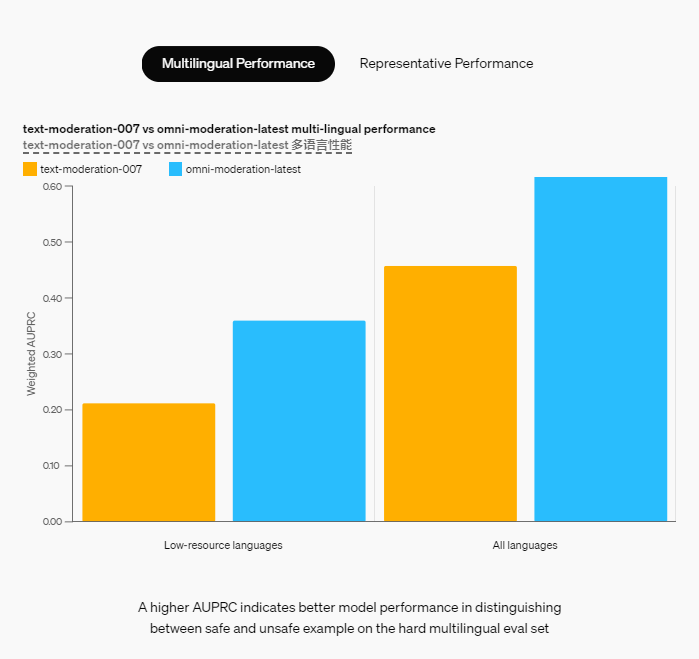

さらに、英語以外のコンテンツの検出の精度が大幅に向上しました。このテストでは、特にリソースの少ない言語で、40 言語の精度が 42% 向上したことがわかりました。

開発者にとって、この新しいレビュー モデルは引き続き無料のコンテンツ レビュー API であり、簡単にアクセスできます。 OpenAI は、このアップグレードにより、より多くの開発者が最新の研究結果とセキュリティ システムを利用して、よりユーザー フレンドリーなオンライン エクスペリエンスを作成できるようになることを期待しています。

公式ブログ:https://openai.com/index/upgrading-the-moderation-api-with-our-new-multimodal-moderation-model/

** ハイライト: **

? 新しいモデル「omni-moderation-latest」は GPT-4o テクノロジーに基づいており、画像のマルチモーダル レビューをサポートします。

? 40 言語の検出精度が 42% 向上し、特にリソースの少ない言語で顕著です。

? 違法で暴力的なコンテンツを識別する機能を向上させるために、2 つの新しいタイプのテキスト レビューが追加されました。

全体として、OpenAI の「オムニモデレーション最新」モデルは、そのマルチモーダル機能、より高い精度、および複数言語のサポートにより、オンライン コンテンツのセキュリティ レベルを効果的に向上させます。これは開発者とユーザーの両方にとって良いニュースです。 Downcodes の編集者は、OpenAI が将来、より革新的なテクノロジーをもたらし、より安全で、より健全で、よりフレンドリーなインターネット環境を共同で構築することを楽しみにしています。