Emu3, o mais recente modelo de IA multimodal desenvolvido pela equipe Meta AI, está agitando o campo da inteligência artificial com sua arquitetura simples e eficiente e funções poderosas. Ao contrário dos modelos multimodais complexos anteriores, o Emu3 consegue processamento unificado de texto, imagens e vídeos convertendo vários conteúdos em símbolos discretos e usando um único modelo Transformer para prever o próximo símbolo. O editor de Downcodes lhe dará uma compreensão profunda das inovações do Emu3 e como isso muda nossa compreensão da IA.

No vasto oceano da inteligência artificial, um navio inovador chamado Emu3 está a romper as ondas, mostrando-nos as infinitas possibilidades da IA multimodal. Este modelo revolucionário desenvolvido pela equipe de pesquisa Meta AI alcança o processamento unificado de texto, imagens e vídeos por meio de um mecanismo simples e inteligente de previsão da próxima etapa.

A ideia central do Emu3 é converter vários conteúdos em símbolos discretos e, em seguida, usar um único modelo Transformer para prever o próximo símbolo. Essa abordagem não apenas simplifica a arquitetura do modelo, mas também permite que o Emu3 demonstre capacidades incríveis em vários campos. Desde a geração de imagens de alta qualidade até a compreensão precisa de imagens e textos, desde respostas de diálogo coerentes até a criação suave de vídeos, o Emu3 pode lidar com isso com facilidade.

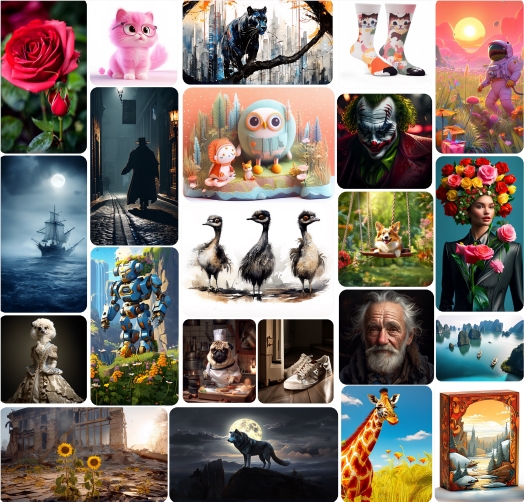

Em termos de geração de imagens, o Emu3 precisa apenas de uma descrição de texto para criar imagens de alta qualidade que atendam aos requisitos. Ele ainda supera o modelo especializado de geração de imagens SDXL. O que é ainda mais surpreendente é que o Emu3 não é inferior em capacidades de compreensão de imagem e linguagem, e pode descrever com precisão cenas do mundo real e fornecer respostas de texto apropriadas, tudo sem depender de CLIP ou modelos de linguagem pré-treinados.

O Emu3 também tem um bom desempenho na área de geração de vídeo. Ele é capaz de criar vídeos prevendo o próximo símbolo em uma sequência de vídeo, em vez de depender de técnicas complexas de difusão de vídeo, como outros modelos. Além disso, o Emu3 também tem a capacidade de continuar o conteúdo de vídeo existente e expandir naturalmente as cenas de vídeo, como se pudesse prever o futuro.

A equipe Meta AI planeja abrir os pesos do modelo, o código de inferência e o código de avaliação do Emu3 em um futuro próximo, para que mais pesquisadores e desenvolvedores possam experimentar o charme deste modelo poderoso. Para os interessados em experimentar o Emu3, o processo é bastante simples. Basta clonar a base de código e instalar os pacotes necessários, e você poderá executar facilmente o Emu3-Gen para geração de imagens por meio da biblioteca Transformers ou usar o Emu3-Chat para interação gráfica e de texto.

A Emu3 não é apenas um avanço tecnológico, representa uma grande inovação no campo da IA. Através do processamento unificado de informações de diferentes modalidades, o Emu3 aponta o caminho para futuros sistemas inteligentes. Mostra como obter maior funcionalidade de uma forma mais simples, revolucionando potencialmente a forma como projetamos e usamos sistemas de IA.

Endereço do projeto: https://github.com/baaivision/Emu3

O surgimento do Emu3 anuncia um novo capítulo no desenvolvimento da IA multimodal. Seu conceito de design simples e eficiente e funções poderosas fornecem novas direções e possibilidades para o desenvolvimento da futura tecnologia de IA. O editor do Downcodes espera que o Emu3 possa mostrar seu forte potencial em mais áreas e nos trazer uma experiência de vida mais inteligente e conveniente.