Emu3, das neueste multimodale KI-Modell, das vom Meta AI-Team entwickelt wurde, sorgt mit seiner einfachen und effizienten Architektur und leistungsstarken Funktionen für Aufsehen im Bereich der künstlichen Intelligenz. Im Gegensatz zu früheren komplexen multimodalen Modellen erreicht Emu3 eine einheitliche Verarbeitung von Text, Bildern und Videos, indem es verschiedene Inhalte in diskrete Symbole umwandelt und ein einziges Transformer-Modell verwendet, um das nächste Symbol vorherzusagen. Der Herausgeber von Downcodes wird Ihnen ein tiefgreifendes Verständnis der Innovationen von Emu3 vermitteln und wie es unser Verständnis von KI verändert.

Im riesigen Ozean der künstlichen Intelligenz bricht ein innovatives Schiff namens Emu3 durch die Wellen und zeigt uns die unendlichen Möglichkeiten multimodaler KI. Dieses vom Meta AI-Forschungsteam entwickelte revolutionäre Modell erreicht eine einheitliche Verarbeitung von Text, Bildern und Videos durch einen einfachen und cleveren Mechanismus zur Vorhersage des nächsten Schritts.

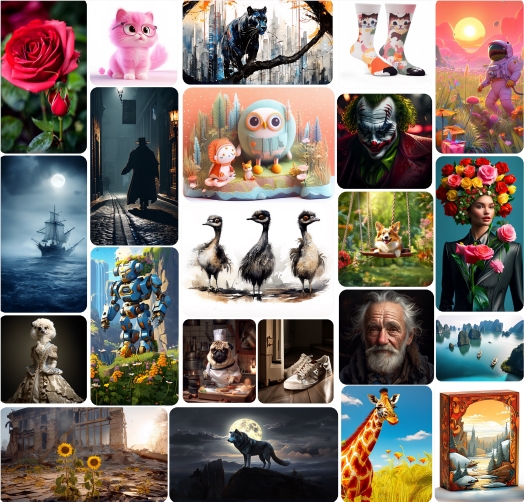

Die Kernidee von Emu3 besteht darin, verschiedene Inhalte in diskrete Symbole umzuwandeln und dann ein einzelnes Transformer-Modell zu verwenden, um das nächste Symbol vorherzusagen. Dieser Ansatz vereinfacht nicht nur die Modellarchitektur, sondern ermöglicht es Emu3 auch, erstaunliche Fähigkeiten in mehreren Bereichen zu demonstrieren. Von der Erzeugung hochwertiger Bilder bis hin zum genauen Bild- und Textverständnis, von kohärenten Dialogantworten bis hin zur reibungslosen Videoerstellung – Emu3 meistert alles mit Leichtigkeit.

Was die Bildgenerierung betrifft, benötigt Emu3 lediglich eine Textbeschreibung, um qualitativ hochwertige Bilder zu erstellen, die den Anforderungen entsprechen. Es übertrifft sogar das spezialisierte Bilderzeugungsmodell SDXL. Was noch erstaunlicher ist, ist, dass Emu3 in Bezug auf Bild- und Sprachverständnisfähigkeiten nicht nachsteht und reale Szenen genau beschreiben und entsprechende Textantworten geben kann, ohne auf CLIP oder vorab trainierte Sprachmodelle angewiesen zu sein.

Auch im Bereich der Videogenerierung schneidet Emu3 gut ab. Es ist in der Lage, Videos zu erstellen, indem es das nächste Symbol in einer Videosequenz vorhersagt, anstatt sich wie andere Modelle auf komplexe Videodiffusionstechniken zu verlassen. Darüber hinaus verfügt Emu3 auch über die Möglichkeit, bestehende Videoinhalte fortzuführen und Videoszenen auf natürliche Weise zu erweitern, als ob es die Zukunft vorhersehen könnte.

Das Meta AI-Team plant, die Modellgewichte, den Inferenzcode und den Bewertungscode von Emu3 in naher Zukunft zu öffnen, damit mehr Forscher und Entwickler den Charme dieses leistungsstarken Modells erleben können. Für diejenigen, die Emu3 ausprobieren möchten, ist der Vorgang recht einfach. Klonen Sie einfach die Codebasis und installieren Sie die erforderlichen Pakete, und schon können Sie Emu3-Gen zur Bildgenerierung über die Transformers-Bibliothek ausführen oder Emu3-Chat für die Grafik- und Textinteraktion verwenden.

Emu3 ist nicht nur ein technologischer Durchbruch, es stellt eine große Innovation im Bereich der KI dar. Durch die einheitliche Verarbeitung von Informationen unterschiedlicher Modalitäten weist Emu3 den Weg für zukünftige intelligente Systeme. Es zeigt, wie wir auf einfachere Weise eine größere Funktionalität erreichen und möglicherweise die Art und Weise, wie wir KI-Systeme entwerfen und verwenden, revolutionieren.

Projektadresse: https://github.com/baaivision/Emu3

Das Aufkommen von Emu3 läutet ein neues Kapitel in der Entwicklung multimodaler KI ein. Sein einfaches und effizientes Designkonzept und seine leistungsstarken Funktionen bieten neue Richtungen und Möglichkeiten für die Entwicklung zukünftiger KI-Technologie. Der Herausgeber von Downcodes hofft, dass Emu3 sein starkes Potenzial in mehr Bereichen zeigen und uns ein intelligenteres und bequemeres Lebenserlebnis bieten kann.