Um aplicativo móvel para traduzir hieroglyphics (2018)

? Um aplicativo móvel que detecta, classifica e translitera os hieróglifos.

Grande parte do modo de vida dos antigos egípcios foi perdida, pois ninguém foi capaz de decifrar o significado da maioria de seus símbolos, Sir Alan Gardiner classificou cada hierogloso com um código que pode ser usado para procurar mais sobre seu significado. Esse dicionário hieroglífico acabou tendo milhares de páginas e procurar qualquer coisa se tornou uma tarefa tediosa. Mesmo com o surgimento da Internet, ainda há o problema de não conhecer o código Gardiner de um hierogloso para procurá -lo.

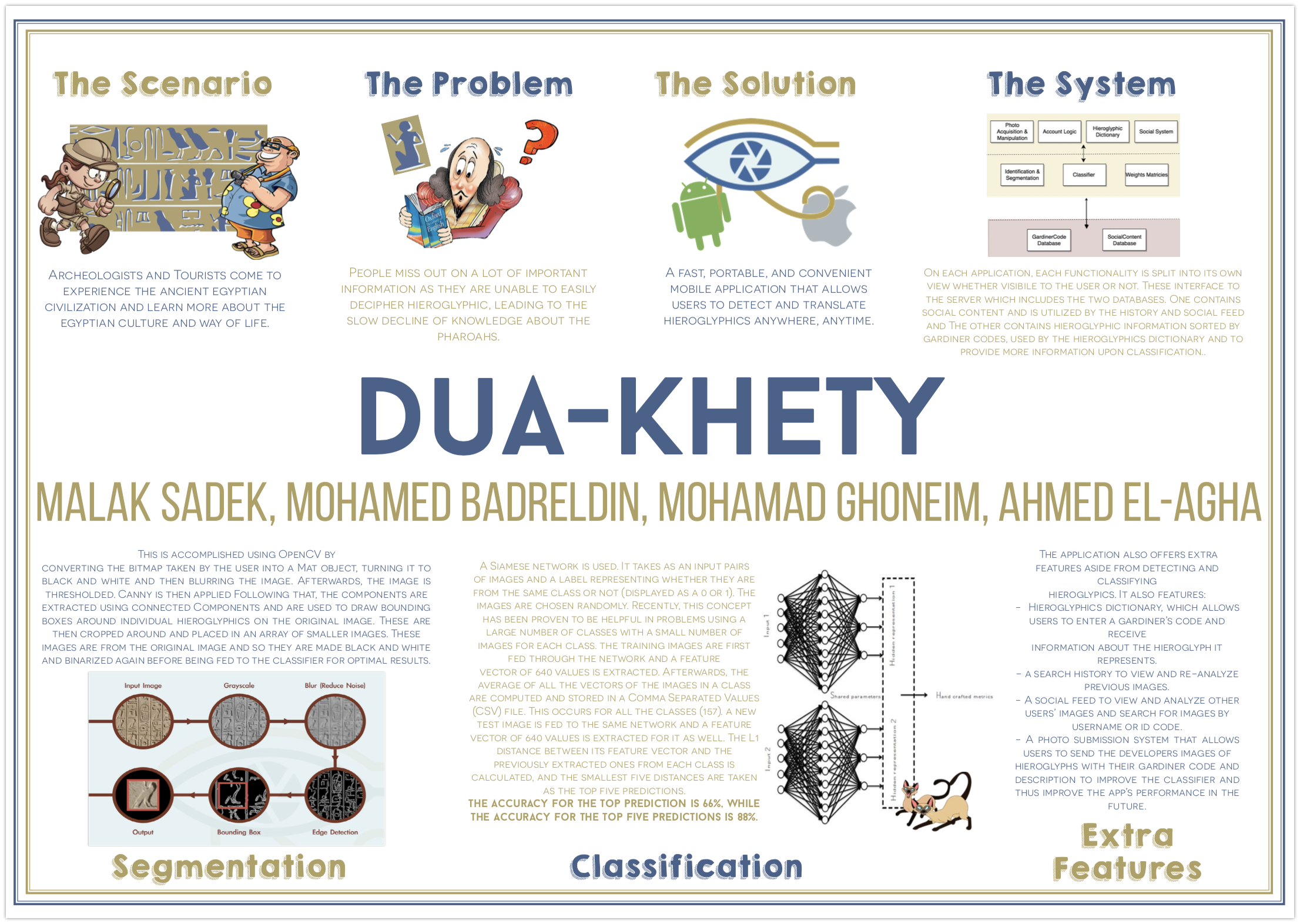

Para ajudar a resolver esse problema, o Dua-Khety foi criado como um aplicativo móvel, disponível nos dispositivos Android (implementado em Java ) e iOS (implementados em Swift & Objective C ), com o objetivo de detectar e classificar hieróglifos de uma imagem e fornecimento do usuário com seus códigos Gardiner, bem como informações sobre suas traduções de tradução. Todo o processo ocorre offline, o que significa que o serviço é conveniente, rápido, fácil de usar e pode ser acessado em qualquer lugar a qualquer momento.

There are many features to the application aside from detection and classification, It also includes A Hieroglyphics dictionary, which allows users to enter a Gardiner's code and receive information about the hieroglyph it represents, A search history to view and re-analyze previous images, A social feed to view and analyze other users' images and search for images by username or ID code, and A photo submission system that allows users to send the developers images of hieroglyphs with their Gardiner Código e descrição para melhorar o classificador e, assim, melhorar o desempenho do aplicativo no futuro. Esses recursos dependem Google's Firebase MySQL databases armazenados em um servidor remoto e manipulam usando scripts PHP.

Cada recurso é implementado em uma visualização separada e processos invisíveis para o usuário, como classificação, cada um também tem sua própria visão. O aplicativo móvel pode se comunicar com dois bancos de dados em um servidor remoto. Um possui conteúdo social usado pelos recursos de história e feed social e a outra possui informações sobre hieróglifos classificados pelos códigos Gardiner, usados pelo dicionário de hieróglifos e para fornecer mais informações sobre a classificação.

Para segmentação, isso é realizado usando OpenCV , convertendo o bitmap levado pelo usuário em um objeto MAT, transformando -o em preto e branco e depois embaçando a imagem com um raio de 3. A média é calculada. Posteriormente, a imagem é limitada com um min-val da média calculada e um maxval de 255. As Canny é então aplicado com os limiares da média * 0,66 e a média * 1,33 e um tamanho de abertura de 3 que foi considerado ideal. Posteriormente, os componentes são extraídos e são usados para desenhar caixas delimitadoras em torno de hieróglifos individuais na imagem original. Estes são então cortados e colocados em uma variedade de imagens menores. As imagens cortadas (da imagem original) são transformadas em preto e branco e thers seguradas da mesma maneira antes de serem alimentadas ao classificador para maximizar as precisões.

O classificador usa o conceito de redes siamesas . Essa rede difere dos normais, tomando como um pares de imagens de entrada e um rótulo representando se são da mesma classe ou não (exibidos como 0 ou 1). Em outras palavras, metade do que é alimentado na rede são pares de imagens das mesmas classes com o rótulo que 1 e a outra metade, duas imagens diferentes de duas classes diferentes, com o rótulo de 0. As imagens são escolhidas aleatoriamente. Recentemente, esse conceito provou ser útil em problemas usando um grande número de classes com um pequeno número de imagens para cada classe, como para classificar a imagem real do teste, as imagens de treinamento são alimentadas através da rede e um vetor de recursos de 640 valores é extraído. Posteriormente, a média de todos os vetores das imagens em uma classe é calculada e armazenada em um arquivo valores separados por vírgula (CSV). O mesmo é feito para todas as classes (157). Ao prever o número da classe para uma nova imagem de teste, ela é alimentada na mesma rede e um vetor de recursos de 640 valores também é extraído. Depois disso, a distância L1 entre seu vetor de recurso e os extraídos anteriormente de cada classe é comparada e as cinco distâncias menores são tomadas como as cinco principais previsões. O aplicativo iOS usa OpenML enquanto o aplicativo Android usa Tensorflow .

A precisão para a previsão principal é de 66%, enquanto a precisão das cinco principais previsões é de 88%.

Capturas de tela e vídeos podem ser encontrados aqui: https://malaksadek.wordpress.com/2019/10/15/teeet-the-egyptian-microbus-experience/

O aplicativo está disponível em: