Eine mobile Anwendung zur Übersetzung von Hieroglyphen (2018)

? Eine mobile Anwendung, die Hieroglyphen erfasst, klassifiziert und transliteratiert.

Ein Großteil der Lebensweise der alten Ägypter war verloren gegangen, da niemand in der Lage war, die Bedeutung der meisten ihrer Symbole zu entschlüsseln. Dieses hieroglyphische Wörterbuch war Tausende von Seiten lang, und alles wurde zu einer mühsamen Aufgabe. Trotz der Entstehung des Internets blieb das Problem, dass der Gardiner -Code eines Hieroglyphen nicht kennt, um danach zu suchen.

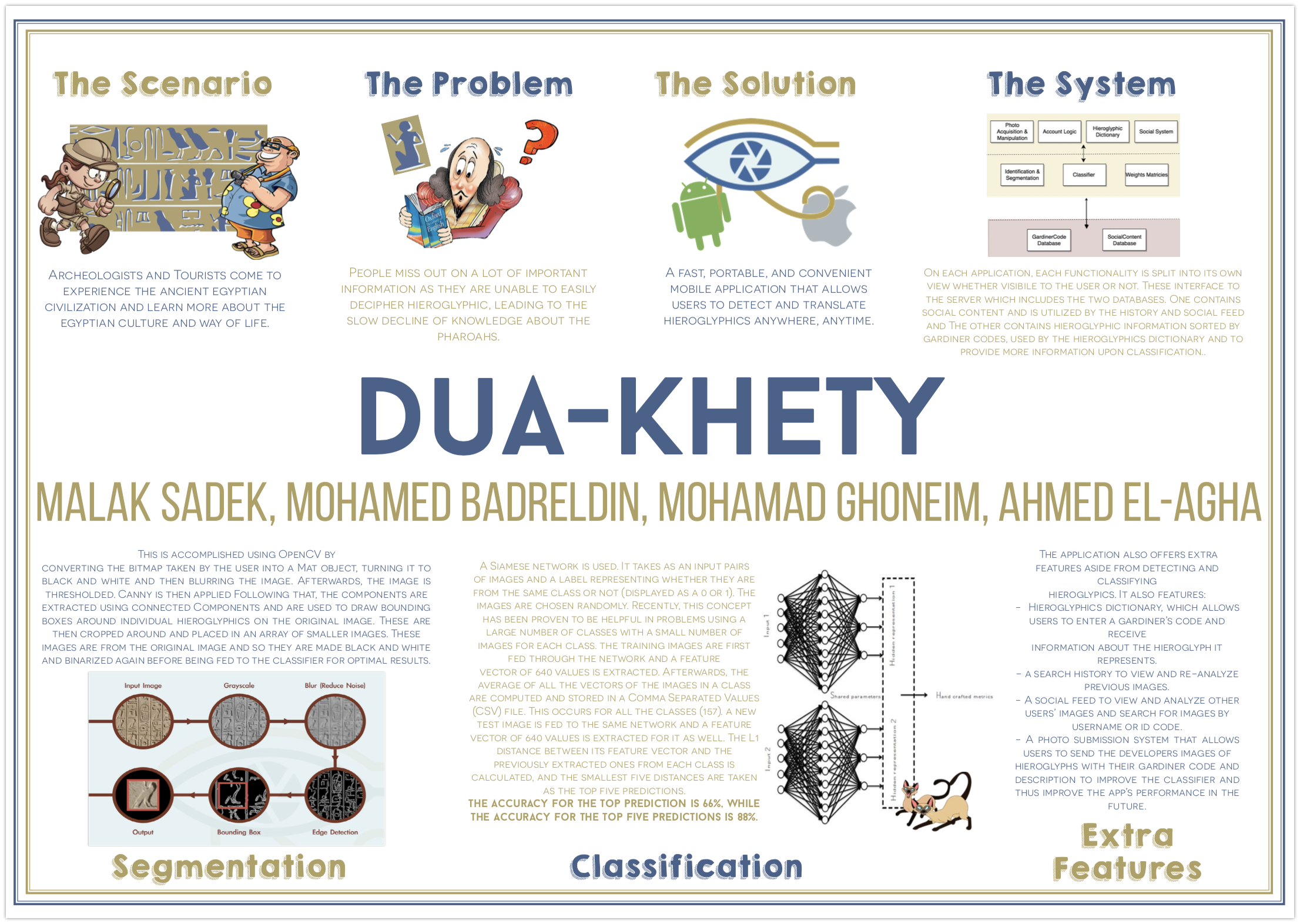

Um dieses Problem zu lösen, wurde Dua-Khety als mobile Anwendung erstellt, die sowohl auf Android (implementiert in Java ) als auch in iOS (implementiert in Swift & Objective C ) verfügbar ist, mit dem Ziel, Hieroglyphik aus einem aufgenommenen Bild und den Benutzer mit seinen Gardiner-Codes sowie Informationen zu ihren Übersetzungen und den Bedeutung zu erkennen und zu klassifizieren. Der gesamte Vorgang erfolgt offline, was bedeutet, dass der Service bequem, schnell und einfach zu bedienen ist und jederzeit überall zugreifen kann.

There are many features to the application aside from detection and classification, It also includes A Hieroglyphics dictionary, which allows users to enter a Gardiner's code and receive information about the hieroglyph it represents, A search history to view and re-analyze previous images, A social feed to view and analyze other users' images and search for images by username or ID code, and A photo submission system that allows users to send the developers images of hieroglyphs with their Gardiner code and Beschreibung zur Verbesserung des Klassifikators und somit die Leistung der App in Zukunft. Diese Funktionen beruhen auf MySQL databases , die auf einem Remote -Server gespeichert und mit PHP -Skripts manipluiert werden. Dies wurde später in den Google's Firebase für Speicher- und Datenbanklösungen migriert.

Jede Funktion ist in einer separaten Ansicht implementiert, und Prozesse, die für den Benutzer wie die Klassifizierung unsichtbar sind, haben jeweils auch ihre eigene Ansicht. Die mobile Anwendung kann mit zwei Datenbanken auf einem Remote -Server kommunizieren. Einer hält soziale Inhalte, die in den Funktionen der Geschichte und der sozialen Feeds verwendet werden, und der andere hält Informationen zu Hieroglyphen, die nach Gardiner -Codes sortiert, die vom Hieroglyphen -Wörterbuch verwendet werden und weitere Informationen zur Klassifizierung bereitgestellt werden.

Für die Segmentierung wird dies mithilfe von OpenCV erreicht, indem der vom Benutzer aufgenommene Bitmap in ein MAT -Objekt konvertiert, es in Schwarzweiß umdreht und das Bild mit einem Radius von 3 verwischt. Der Durchschnitt wird dann berechnet. Danach wird das Bild mit einem Min-Val des berechneten Durchschnitts und einem Maxval von 255 Schwellenwert. Canny wird dann mit Schwellenwerten des Durchschnitts * 0,66 und des durchschnittlichen * 1,33 und einer Aperturgröße von 3 angewendet, die sich als optimal befunden haben. Danach werden die Komponenten extrahiert und werden verwendet, um Begrenzungsboxen um einzelne Hieroglyphen auf dem Originalbild zu zeichnen. Diese werden dann herumgeschnitten und in eine Reihe kleinerer Bilder gelegt. Die verkürzten Bilder (aus dem Originalbild) werden dann in Schwarzweiß und weiß verwandelt und auf die gleiche Weise vorgegangen, bevor sie dem Klassifizierer gefüttert werden, um die Genauigkeiten zu maximieren.

Der Klassifikator verwendet das Konzept der siamesischen Netzwerke . Ein solches Netzwerk unterscheidet sich von den normalen, indem sie als Eingangspaar von Bildern und als Etikett darstellen, die darstellen, ob sie aus derselben Klasse stammen oder nicht (als 0 oder 1 angezeigt). Mit anderen Worten, die Hälfte dessen, was in das Netzwerk eingespeist wird, sind Paare von Bildern derselben Klassen mit ihrem Etikett als 1 und die andere Hälfte zwei verschiedene Bilder aus zwei verschiedenen Klassen, wobei deren Etikett als 0 verwendet wurde. Die Bilder werden zufällig ausgewählt. In jüngster Zeit hat sich dieses Konzept als hilfreich bei Problemen mit einer großen Anzahl von Klassen mit einer kleinen Anzahl von Bildern für jede Klasse erwiesen, da für die Klassifizierung des tatsächlichen Testbildes die Trainingsbilder über das Netzwerk gespeist werden und ein Merkmalsvektor von 640 Werten extrahiert wird. Anschließend wird der Durchschnitt aller Vektoren der Bilder in einer Klasse berechnet und in einer CSV -Datei (comma -getrennte Werte) gespeichert. Gleiches gilt für alle Klassen (157). Es wird auf die Vorhersage der Klassennummer für ein neues Testbild vorgesehen und wird in dasselbe Netzwerk eingespeist und ein Merkmalsvektor von 640 Werten wird ebenfalls extrahiert. Anschließend werden der L1 -Abstand zwischen seinem Merkmalsvektor und den zuvor extrahierten aus jeder Klasse verglichen und die kleinsten fünf Entfernungen werden als die fünf besten Vorhersagen angenommen. Die iOS -Anwendung verwendet OpenML , während die Android -Anwendung Tensorflow verwendet.

Die Genauigkeit für die Top -Vorhersage beträgt 66%, während die Genauigkeit für die fünf besten Vorhersagen 88%beträgt.

Screenshots und Videos finden Sie hier: https://malaksadek.wordpress.com/2019/10/15/teeet-the-egyptian-microbus-experience/

Die App ist verfügbar auf: