최근 Google은 이미지 및 텍스트 처리 분야에서 인공 지능 기술의 주요 획기적인 획기적인 혁신 인 Paligemma2Mix라는 새로운 비전 언어 모델 (VLM)을 발표했습니다. Paligemma2Mix는 시각 정보 및 텍스트 입력을 동시에 처리 할 수있을뿐만 아니라 요구 사항에 따라 해당 출력을 생성하여 멀티 태스킹에 대한 강력한 기술 지원을 제공합니다.

Paligemma2Mix는 이미지 설명, 광학 문자 인식 (OCR), 이미지 질문 및 답변, 객체 감지 및 이미지 분할과 같은 다양한 시각적 언어 작업을 다루는 매우 포괄적 인 기능을 가지고 있습니다. 개발자 또는 연구원이 사전 훈련 체크 포인트를 통해 직접 모델을 사용할 수 있는지 또는 특정 요구에 따라 미세 조정하여 다양한 응용 시나리오의 요구를 충족시킬 수 있는지 여부.

Paligemma2의 최적화 된 버전으로 Paligemma2Mix는 개발자에게보다 편리한 탐사 경험을 제공하기 위해 하이브리드 작업에 특별히 조정되었습니다. 이 모델은 3B (30 억 파라미터), 10B (100 억 파라미터) 및 28B (280 억 파라미터)를 포함한 3 가지 매개 변수 스케일을 제공하며 224px와 448px의 두 가지 해상도를 지원하며, 이는 다양한 컴퓨팅 리소스 및 작업 요구 사항에 적응할 수 있습니다.

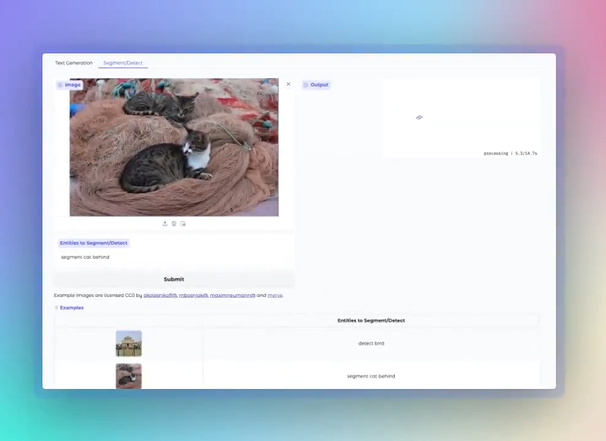

Paligemma2Mix의 핵심 기능 하이라이트에는 이미지 설명, OCR (Optical Charternal 인식), 이미지 질문 및 답변 및 객체 감지가 포함됩니다. 이미지 설명 측면에서,이 모델은 해변에 서있는 젖소 그림을 식별하고 풍부한 설명을 제공하는 것과 같은 세부적인 짧거나 긴 설명을 생성 할 수 있습니다. OCR과 관련하여 이미지에서 텍스트를 추출하고 로고, 레이블 및 문서 컨텐츠를 식별하여 정보 추출을위한 편의성을 제공 할 수 있습니다. 또한 사용자는 사진을 업로드하고 질문 할 수도 있습니다. 이 모델은 그림을 분석하고 정확한 답변을 제공하며 동물, 차량 등과 같은 이미지의 특정 객체를 식별 할 수도 있습니다.

개발자는 Kaggle과 포옹 페이스 플랫폼을 통해 Paligemma2Mix의 혼합 무게를 다운로드하여 추가 실험과 개발을 촉진 할 수 있다는 점은 언급 할 가치가 있습니다. 이 모델에 관심이 있다면 Hugging Face의 데모 플랫폼을 통해 탐구하여 강력한 기능과 응용 가능성에 대한 통찰력을 얻을 수 있습니다.

Paligemma2Mix가 출시되면서 Vision-Language 모델 분야에서 Google의 연구는 또 다른 중요한 단계를 밟았습니다. 이 모델은 인공 지능 기술의 큰 잠재력을 보여줄뿐만 아니라 미래의 실제 응용 프로그램에 더 많은 가능성을 제공합니다. 우리는이 기술이 더 많은 분야에서 가치를 보여줄 수 있기를 기대하고 인공 지능 기술의 추가 개발을 촉진합니다.

기술 보고서 : https://arxiv.org/abs/2412.03555