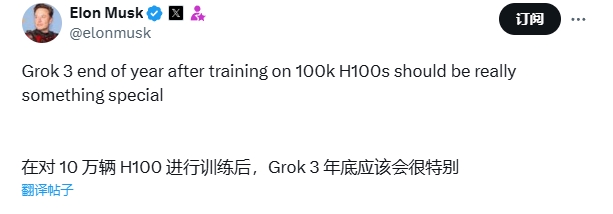

머스크의 인공지능 회사 xAI가 새로운 대형 언어 모델 Grok-2 출시를 앞두고 있으며, 후속 모델 Grok-3에 대한 예열에 착수했습니다. Grok-3의 훈련에는 놀라운 100,000개의 NVIDIA H100 칩이 사용되는데, 이는 그 성능이 전례 없는 수준에 도달할 것임을 나타냅니다. 이는 xAI의 강력한 연구개발 능력을 보여줄 뿐만 아니라, AI 기술의 미래 발전에 대한 사람들의 끝없는 상상력을 촉발시킵니다. 이 기사에서는 Grok-3의 교육 규모, 비용 및 잠재적인 기술 혁신에 대해 자세히 설명하고 xAI와 Tesla 간의 가능한 리소스 공유에 대해 논의합니다.

머스크는 AI 연구 및 개발에서 고품질 데이터 세트의 중요성을 강조하고 기존 모델의 데이터 처리 문제를 지적했습니다. Grok-3 프로젝트는 훈련에 사용되는 100,000개의 Nvidia H100 칩의 가치가 최대 30억~40억 달러에 달합니다. 이는 Tesla의 올해 Nvidia 칩 조달 예산과 유사하여 둘 사이의 자원 공유에 대한 추측을 촉발합니다. 회사. Grok-2와 Grok-3의 출시는 인공 지능 분야에서 xAI가 취한 대담한 발걸음을 의미하며, 새로운 AI 기술 변화의 도래를 예고합니다.

LLM(대형 언어 모델) 데이터 처리를 위해 설계된 이 최첨단 칩인 NVIDIA H100의 단일 칩 가격은 최대 30,000~40,000달러(약 219,000~292,000위안)에 달하며, xAI의 이번 투자액은 100,000위안입니다. 칩의 가치는 30억~40억 달러(현재 환율로 약 218억 6800만~291억 5700만 위안)에 이를 정도로 치솟았습니다.

머스크가 올해 테슬라의 엔비디아 칩 구매 예산도 이 범위 내에 있다는 사실을 이전에 밝힌 점은 주목할 만하다. 이로 인해 사람들은 xAI가 테슬라의 자원에 의존하고 있는지 추측하게 된다.

다가오는 Grok-2의 출시와 Grok-3의 집중적인 준비로 머스크가 이끄는 xAI는 인공지능 분야의 새로운 변화를 주도하고 있습니다.

xAI에 대한 막대한 투자와 데이터 품질에 대한 강조는 앞으로 인공 지능 분야에서 더 많은 혁신이 있을 것임을 나타냅니다. Grok-2와 Grok-3의 출시는 이들이 인공 지능 분야에서 진정으로 새로운 장을 이끌 수 있는지 지켜볼 가치가 있습니다. 이는 전체 기술 산업에 중대한 영향을 미칠 것입니다.