ゲーム開発の分野では、大型モデルがますます重要な役割を果たしています。しかし、既存のモデルでは、ゲームシーンの理解、画像認識、コンテンツの説明において依然として不十分な点があります。そんな悩みを解決すべく、ダウンコード編集者から朗報です!カナダ、アルバータ州の研究チームは、ゲーム用に特別に構築された大規模モデル VideoGameBunny (VGB) をオープンソース化しました。強力なテキスト生成機能、高いカスタマイズ性、多言語サポートを備え、複数の開発環境と互換性があるため、ゲーム開発者の使用が大幅に容易になります。

ゲーム開発の世界では、AI キャラクターの生成からシーンの構築まで、ほぼすべてをカバーする大型モデルが、かけがえのない「シンクタンク」となりつつあります。

ただし、その優れた機能にもかかわらず、ゲームシーンの理解、画像認識、およびコンテンツの説明はまだ改善の必要があります。これらの問題を解決するために、カナダ、アルバータ州の研究チームも負けじと、ゲーム専用に構築された大規模なオープンソース モデル、VideoGameBunny (略して「VGB」) を立ち上げました。

機能のハイライト

-複数の言語をサポート: 複数の言語を処理および生成できるため、国際的なアプリケーションに適しています。

- 高度にカスタマイズ可能: 特定のニーズに応じてモデル パラメーターと構成ファイルを調整できます。

- 強力なテキスト生成機能: 一貫性のある自然な会話を生成する機能により、ゲームやチャットボットに最適です。

- オープンソースで簡単にアクセス可能: Hugging Face プラットフォームで利用できるため、誰でも簡単に使用して貢献できます。

- 複数の開発環境との互換性: Python やその他の一般的なプログラミング言語により、さまざまなプロジェクトに簡単に統合できます。

- 豊富なモデル ファイル: さまざまなトレーニングやアプリケーションでユーザーをサポートするために、複数の形式でモデル ファイルを提供します。

- 積極的なコミュニティ サポート: ユーザーはコミュニティでの支援とコミュニケーションを求め、テクノロジーの共有と協力を促進します。

プロジェクトアドレス: https://huggingface.co/VideoGameBunny/VideoGameBunny-V1/tree/main

VGB には大きな可能性があります。ゲーム環境を理解し、即座にフィードバックを提供できるスマートなビジュアル AI アシスタントのようなものです。これらのオープンワールド 3A ゲームでは、プレイヤーが重要なアイテムをすばやく特定したり、さまざまな質問に答えたりするのに役立ち、ゲーム スキルをより早く習得できるようになり、ゲームのインタラクティブ性と没入感が大幅に向上します。

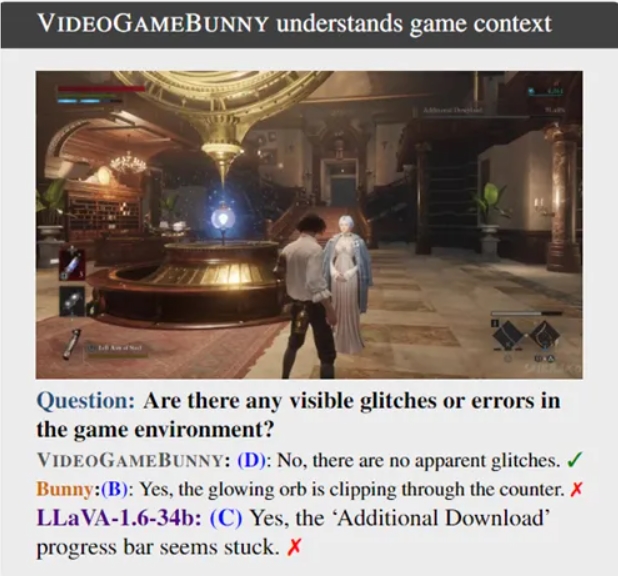

さらに強力なのは、VGB が大量のゲーム画像を分析し、グラフィック レンダリング エラーや物理エンジンの不一致を検出することもできるため、開発者がバグや異常をトラブルシューティングするための強力なアシスタントとなることです。

該当するシナリオ

- ゲーム対話システム: より自然でインテリジェントな NPC 対話を開発するために使用でき、プレイヤーの没入感が向上します。

- 教育アプリケーション: 教育ソフトウェア用のインタラクティブなコンテンツや演習を生成して、学習効率を向上させます。

- カスタマー サービス チャットボット: オンライン カスタマー サービス システムで使用され、リアルタイムのカスタマー サポートと回答を提供します。

VGB の基礎となっているのは、高効率かつ低消費電力の「良きパートナー」である Bunny モデルです。その設計インスピレーションは LLaVA に似ています。LLaVA は、言語モデルがデータを効率的に処理できるようにするために、多層パーセプトロン ネットワークを通じて強力な事前トレーニング済み視覚モデルからの視覚情報を画像タグに変換します。 Bunny モデルは最大 1152 × 1152 ピクセルの画像解像度をサポートします。これは、ゲーム画面には小さな UI アイコンから巨大なゲーム オブジェクトまでさまざまな視覚要素が含まれるため、ゲーム画像を処理する場合に特に重要です。マルチスケールの特徴抽出機能により、VGB はゲーム コンテンツをより深く理解できるようになります。

VGB がゲームのビジュアル コンテンツをよりよく理解できるようにするために、研究チームは Meta のオープンソース LLama-3-8B を言語モデルとして採用し、それを SigLIP ビジュアル エンコーダおよび S2 ラッパーと組み合わせました。この組み合わせにより、モデルは小さなインターフェイス アイコンから大きなゲーム オブジェクトに至るまで、ゲーム内のさまざまなスケールで視覚要素をキャプチャできるようになり、豊富なコンテキスト情報が提供されます。

さらに、ゲーム画像に合わせたコマンドデータを生成するために、研究者らは Gemini-1.0-Pro-Vision、GPT-4V、GPT-4o などのさまざまな先進モデルを使用しました。これらのモデルは、短く詳細なタイトル、画像から JSON への説明、画像ベースの Q&A など、複数の種類の指示を生成し、VGB がプレーヤーのクエリや指示をよりよく理解できるようにします。

全体として、VideoGameBunny の登場はゲーム開発に新たな可能性をもたらしました。これにより、ゲーム エクスペリエンスが向上するだけでなく、開発者がより効率的にゲームを開発し、バグを修正できるようになります。今後、VGB がさらに広く使用され、発展することを楽しみにしています。