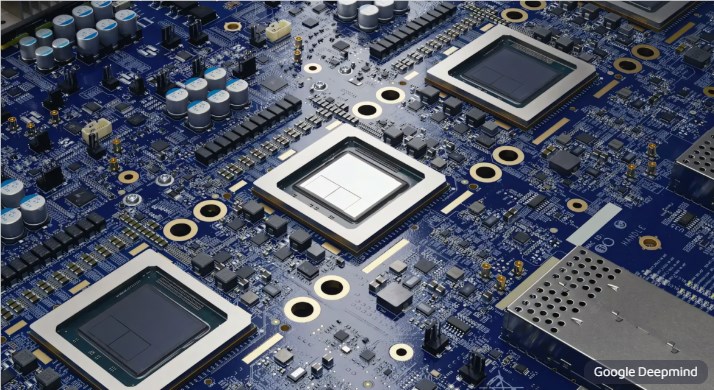

Google DeepMind がリリースした最新の AI システムである AlphaChip は、コンピュータ チップの開発プロセスを加速および最適化することで革命を起こすことを目指しています。以前の AI アプリケーションとは異なり、AlphaChip はハードウェア設計の分野に焦点を当てており、強化学習テクノロジーを使用して最適化されたチップ レイアウトを自動的に生成し、チップ設計の効率とパフォーマンスを大幅に向上させます。 Downcodes のエディターは、AlphaChip の動作メカニズム、アプリケーション ケース、オープン ソース リソースを深く理解し、それがチップ設計の未来をどのように変えるかを明らかにします。

最近、Google DeepMind は最新の AI システムである AlphaChip を発表しました。このシステムは、コンピューター チップの開発の加速と最適化を目的としており、AlphaChip によって設計されたチップ レイアウトは Google の AI アクセラレータで使用されています。

AlphaChip の動作原理は、これまでに聞いた AlphaGo や AlphaZero と似ており、強化学習テクノロジーを使用して最適化されたチップ レイアウトを迅速に生成します。

Google DeepMind によると、AlphaChip は過去 3 世代のテンソル プロセッシング ユニット (TPU) AI アクセラレータで使用されてきました。その中で、最新の第 6 世代 TPU - Trillium では、AlphaChip は 25 モジュールのレイアウト設計を実装し、人間の専門家と比較してワイヤの長さを 6.2% 削減しました。これは、AlphaChip がパフォーマンスの大幅な向上を達成したことを示しています。

AlphaChip の設計プロセスは、回路コンポーネントをグリッド上に次々と配置するようなシステムで、ゲームとして想像することができます。システムが接続されたコンポーネント間の関係を学習し、さまざまなチップ間で一般化できるようにするために、DeepMind はグラフ ニューラル ネットワークを開発しました。 Googleだけでなく、チップメーカーMediaTekなどの他の企業も、特にSamsungスマートフォン向けのDimensityフラッグシップ5Gチップなど、最先端のチップの開発にAlphaChipを使用していることは言及する価値があります。

Google DeepMind は、チップ設計の速度と効率の向上に加えて、チップ設計サイクル全体をさらに最適化できる可能性も見出しています。 AlphaChip の将来のバージョンでは、チップをより高速、より安価、よりエネルギー効率の高いものにすることを目標に、コンピュータ アーキテクチャから製造まであらゆる側面をカバーすることが期待されています。

この目的のために、 DeepMind はいくつかの AlphaChip リソースもオープンソース化しました。彼らは、元の研究で説明されている方法を完全に再現するソフトウェア ライブラリをリリースしました。外部の研究者は、このライブラリを使用してさまざまなチップ モジュールを事前トレーニングし、それを新しいモジュールに適用できます。

さらに、DeepMind は 20 個の TPU モジュールでトレーニングされた事前トレーニング済みモデル チェックポイントも提供します。最良の結果を達成するために、外部の研究者が特定のアプリケーション モジュールで事前トレーニングすることをお勧めします。これらのオープンソースリソースを事前トレーニングに使用する方法については、DeepMind が対応するチュートリアルも提供し、GitHub にアップロードします。

ハイライト:

AlphaChip は、Google DeepMind によって発売された AI システムで、チップ設計を高速化して最適化するように設計されています。

このシステムはGoogleの最新TPUシリーズに実装されており、大幅なレイアウトの最適化を実現しました。

DeepMind は AlphaChip リソースの一部をオープンソースにしており、外部研究者はこれらのリソースを事前トレーニングや応用に使用できます。

AlphaChip のオープンソースは、チップ設計分野における AI テクノロジーのさらなる進歩を示すものであり、将来のチップ設計がより効率的かつインテリジェントになることを示しています。 Downcodes の編集者は、AlphaChip が業界全体の進歩を促進し、より強力で省エネのチップ製品を提供できることを期待しています。