gated Transformer

1.0.0

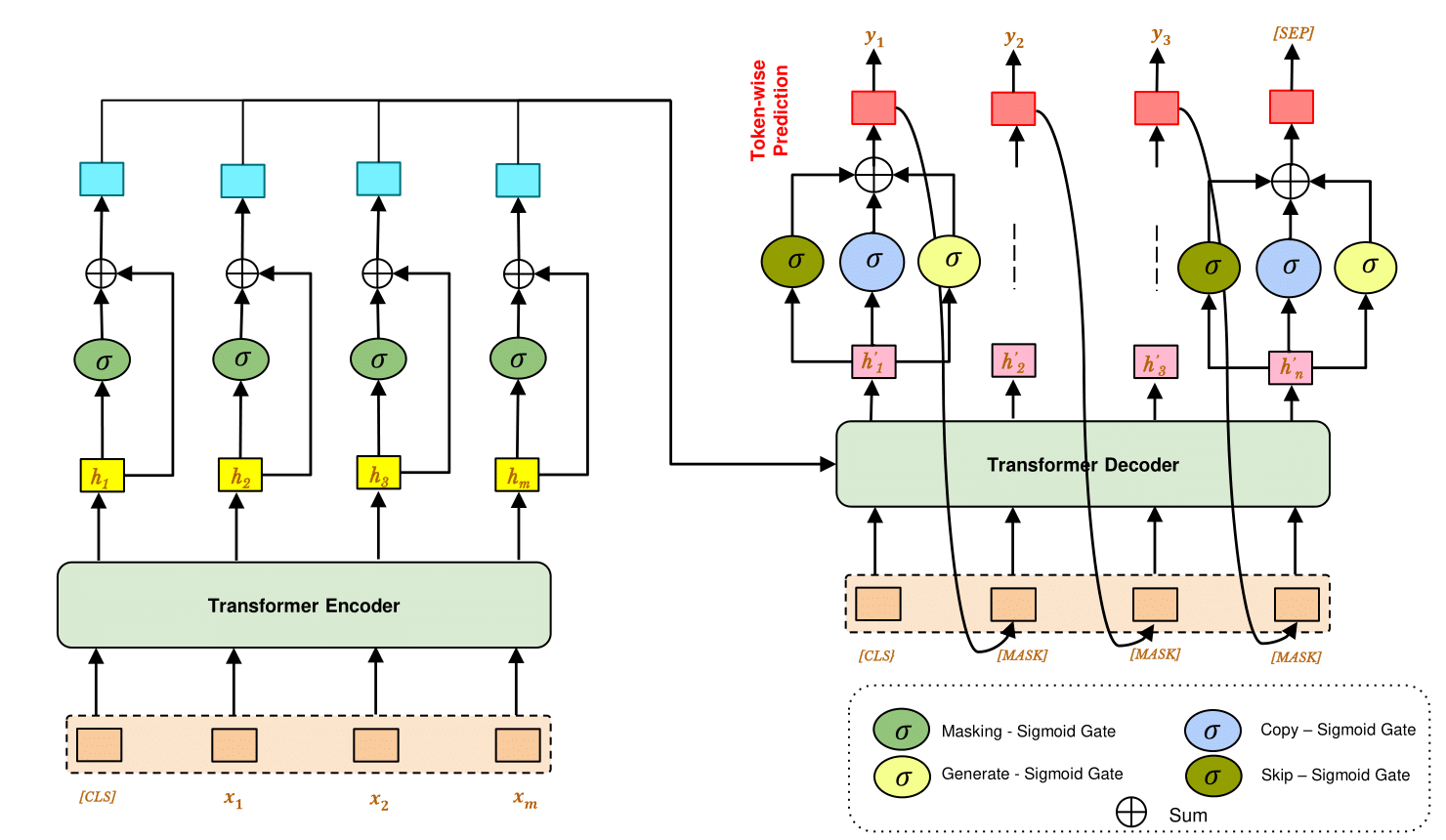

堅牢な除去されたシーケンスからシーケンスモデリングのためのゲートの前処理された変圧器モデル。ゲーティングユニットを使用して、テキストデータからノイズを検出および修正し、生成デコーダーから非ノイズ化されたターゲットを生成します。

この作業では、3つのタスクで実験を行います -

ゲートトランスフォーカーは、

$ pip install -r requirements.txt

前処理された変圧器シーケンスからシーケンスモデル(例:BART、T5)

$ cd ./drive/MyDrive/gated-denoise/ && python train.py --train_file ./data.csv

--model_path ./model/ --model_type bart --pretrained_encoder_path "facebook/bart-base"

--mask_gate --copy_gate --generate_gate --skip_gate

--epochs 15

トランスエンコーダーデコーダーモデル(例-BERT2BERT)

$ cd ./drive/MyDrive/gated-denoise/ && python train.py --train_file ./data.csv

--model_path ./model/ --model_type seq2seq

--pretrained_encoder_path "bert-base-uncased" --pretrained_decoder_path "bert-base-uncased"

--mask_gate --copy_gate --generate_gate --skip_gate

--epochs 15

$ cd ./drive/MyDrive/gated-denoise/ && python predict.py --data_file ./data.csv

--model_path ./model/ --model_type bart --pretrained_encoder_path "facebook/bart-base"

--mask_gate --copy_gate --generate_gate --skip_gate

このリポジトリが便利だと思う場合は、私たちの論文を引用してください。

@inproceedings {,

author = { Ayan Sengupta and

Amit Kumar and

Sourabh Kumar Bhattacharjee and

Suman Roy } ,

title = { Gated Transformer for Robust De-noised Sequence-to-Sequence Modelling } ,

booktitle = { } ,

publisher = { } ,

year = { } ,

url = { } ,

doi = { } ,

}